Introducción

La tecnología se ha convertido en una herramienta capacitadora que contribuye de forma relevante a universalizar la creación de contenido. Limitaciones propias de épocas anteriores, como la necesidad de licencias de emisión audiovisual, el requisito de grandes inversiones e infraestructuras o las limitaciones geográficas e idiomáticas, entre otras, han ido reduciéndose hasta casi desaparecer, con la importante salvedad de las brechas digitales de acceso, competencia y uso (Van Dijk, 2017) que se hicieron especialmente patentes durante la pandemia de COVID-19 en 2020. Pero la multiplicación del contenido tiene también efectos negativos; en primer lugar, porque el que existan más voces no significa que se dé una mayor pluralidad si estas solo sirven para repetir narrativas dominantes -más bien al contrario, como apuntó Cornellà (2000) al hablar por primera vez de “infoxicación”-. Además, esa multiplicación de emisores tampoco implica necesariamente disponer de una mejor información, en términos de completitud, fiabilidad o contextualización.

Junto a estos efectos negativos se da también un riesgo: la multiplicación de la velocidad y el alcance del contenido, no solo de la información veraz, sino también de las narrativas desinformadoras. Si bien es cierto que estas han existido siempre, es gracias a esa multiplicación de emisores y contenido que alcanza su apogeo. La desinformación se difunde ahora de forma masiva e instantánea, lo que cala no solo en entornos públicos de información -discursos políticos o contenidos en medios de comunicación-, sino también en esferas privadas, como las plataformas de mensajería.

Por todo ello, en los últimos años han emergido distintas plataformas de verificación independiente como nuevos actores del ecosistema informativo. No es casual que ese surgimiento coincida en el tiempo con un progresivo empeoramiento de la confianza de la ciudadanía en los medios de comunicación en general (Reuters Institute, 2024): si desconfianza y desinformación van de la mano, la verificación externa surge como posible tabla de salvación. Pero el dilema de la confianza ya no afecta solo a los medios, sino también a la comunicación en general, incluso en redes sociales y plataformas de mensajería.

Así, una función supuestamente implícita en las rutinas de los medios de comunicación ha acabado por externalizarse parcialmente a otras entidades que hacen las veces de “vigilantes” de la información, no solo de los medios, sino también de los discursos políticos, los rumores frecuentes o las tendencias emergentes. Y, como actores en ese ecosistema, también se comportan de forma competitiva, luchando por dar más alcance a su producción de cara a la consecución de una mayor audiencia. Esa lógica provoca que se comporten de una forma similar a los medios, por ejemplo, dando sus veredictos en un tono y estilo reconocibles que les distinga, o seleccionando qué contenidos publicar en función de determinados criterios y resultados de alcance.

Así, es pertinente plantearse si las decisiones y acciones de los verificadores pueden verse condicionadas y comprometidas por esas prácticas. Por ejemplo, si solo se desmienten desinformaciones, lo cual coincidiría con la tendencia mediática a tratar temas de conflicto para captar a la audiencia (Muddiman & Scacco, 2023), o si el matiz ideológico de los veredictos que se emiten se da de forma equilibrada a la izquierda o derecha y, en caso de no ser así, si sucede de forma natural -porque hay más desinformación de un espectro que del otro- o porque existe un sesgo en la selección de lo que se verifica.

Estado de la cuestión y marco teórico

El problema de la desinformación

Los trastornos informativos se han erigido como uno de los aspectos imposibles de esquivar a la hora de comprender y explicar la comunicación de masas moderna. Aunque el fenómeno de la desinformación dista de ser novedoso -hay ejemplos de trastornos informativos de gran calado con siglos de antigüedad-, no es menos cierto que Internet en general, y las redes sociales en particular, han puesto a disposición de los contenidos espurios una plataforma a través de la cual multiplicar su impacto y su velocidad de diseminación. No es, pues, tanto el fenómeno en sí, sino la velocidad -la instantaneidad a la que aspiraban los viejos medios de comunicación llegó con la era de Internet- y el alcance; el tradicional modelo de punto a masa ha sido sustituido por un modelo en el que los receptores son a su vez potenciales emisores masivos, lo que ha cambiado irreversiblemente su otrora pasividad (Rosen, 2012).

Así, no son pocos los autores que han puesto de relieve la pujanza del fenómeno desinformador en los últimos años (Borges do Nascimento et al., 2022; Chen et al., 2023; Navarro-Sierra et al., 2024). Con frecuencia se ha puesto especial énfasis, además, en dos hitos políticos como eventos clave para entender la proliferación posterior del fenómeno desinformativo y su impacto en la esfera pública: el referéndum para abandonar la Unión Europea que tuvo lugar en el Reino Unido en 2016, y las elecciones presidenciales estadounidenses de ese mismo año (Allcott & Gentzkow, 2017; Alonso-López et al., 2021; Paniagua et al., 2020).

Esto ha llevado a varios investigadores a expresar también su preocupación por los efectos de los trastornos informativos en audiencias millonarias, temor que se ha puesto especialmente de relieve tras el impacto posterior de la pandemia de COVID-19 (Salaverría et al., 2020). Tampoco son pocos los autores que han alertado de la coexistencia del fenómeno de la desinformación con otros fenómenos que hoy se asumen como relacionados, tal como el descrédito institucional (Roniger & Senkman, 2019) o la polarización (Ekström et al., 2020). El interés académico por los trastornos informativos ha estimulado igualmente un esfuerzo de conceptualización -en el que destacan autores como Wardle y Derakshan (2017) o Kapantai et al. (2020)- dirigido, entre otras cosas, a visibilizar el problema y clarificar posibles estrategias para combatir de forma específica y eficaz cada uno de sus aspectos.

El fact-checking como mecanismo para contrarrestar los trastornos informativos

Es en este contexto en el que las iniciativas profesionales, especialmente el fact-checking, se han desarrollado ampliamente y “han demostrado ser eficaces para disminuir la aceptación y la credibilidad de la misinformación y la desinformación” (Hameleers, 2023, p. 7). Para autores como Singer (2018), esta práctica requiere que los fact-checkers “se vean a sí mismos tanto como una extensión del periodismo tradicional como, en muchos aspectos, una corrección del mismo” (p. 1079). Existen, en efecto, defensas de la eficacia de estas instituciones, cimentadas sobre resultados que invitan a considerar su capacidad para contrarrestar la desinformación (Fridkin et al., 2015; Luengo & García Marín, 2020) e incluso disuadir a posibles fuentes futuras de seguir difundiéndola.

Sin embargo, parte de la investigación académica dirigida a esclarecer el fenómeno del fact-checking a través de la evaluación de su eficacia ha mostrado reticencias a admitir el poder modificador de la verificación debido a la influencia de fenómenos como la disonancia cognitiva (Chan et al., 2017). En relación con esto, se ha detectado que los entornos polarizados disuaden del poder de corrección de los mensajes desinformativos (Vraga & Bode, 2020).

Fenómenos como el sesgo de confirmación por parte de los receptores (Batista et al., 2022; Ecker et al., 2014; Kappes et al., 2020) han centrado, efectivamente, una parte notable de la atención académica para evaluar la posibilidad real de que herramientas como la verificación puedan contrarrestar los efectos de la desinformación. En menor medida, también ha habido investigaciones, como la de García-Marín et al. (2023), Baptista et al. (2022), Lowrey (2017) o Marietta et al. (2015), que han abordado la problemática de los sesgos ideológicos, no tanto de los receptores, sino de los propios fact-checkers. Es en este nicho de investigación menos abordado en el que se enmarca el presente estudio, con la intención de arrojar luz sobre la existencia o no de sesgos ideológicos en el material verificado por los fact-checkers de referencia de dos países, España y Portugal, que ya han sido investigados de manera comparativa en estudios precedentes, como los de Baldi y Ballesteros-Aguayo (2023) o Jerónimo y Sánchez (2023).

Objetivos y metodología

El objetivo principal de esta investigación es comprobar si existen posibles sesgos en las agencias de verificación y, en caso de ser así, cuantificarlos e identificarlos. En ese sentido, es interesante la contribución de Rodrigo-Ginés et al. (2024) al recoger los sesgos más frecuentes en los medios, que organizan en dos grandes grupos: el primero, en función del contexto, incluye sesgos de selección, cobertura y codificación; el segundo, en función de la intencionalidad del autor, agrupa los sesgos de ideología y de tratamiento. Las similitudes operativas entre medios y agencias de verificación hacen que la clasificación resulte igualmente pertinente.

Nuestra propuesta pretende confirmar si hay sesgos o no en función de la percepción previa de los actores y las verificaciones que finalmente publican. Ello servirá como punto de partida para que futuras investigaciones identifiquen en qué partes del proceso podrían estar esos hipotéticos sesgos. En concreto, y a modo de objetivos secundarios, se buscarán posibles sesgos de conflicto -si se desmiente más de lo que se confirma-, sesgos ideológicos -si se verifica más contenido de izquierda o de derecha-, y a qué posibles variables pueden responder ambos sesgos -si se da mayor o menor incidencia en cualquiera de ambos casos en función del verificador o del tipo de veredicto-.

La muestra de esta investigación se define por las agencias verificadoras de España y Portugal que articulan el hub Iberifier Plus, proyecto designado por la Comisión Europea contra la desinformación, y que están certificadas por la International Fact-Checking Network (IFCN), lo que garantiza estándares homologables en su práctica profesional. Se trata de las españolas EFE Verifica, Maldita.es, Newtral y Verificat, además de la portuguesa Polígrafo. Con el fin de responder a los objetivos planteados, y acotando a la muestra expuesta, el diseño de la investigación responde a una triangulación metodológica en escala -es decir, que cada una de ellas justifica la aplicación de la siguiente, destinada a su vez a clarificar la anterior-.

En primer lugar, entrevistas en profundidad a un responsable de cada uno de los fact-checkers ibéricos sometidos a estudio para medir la percepción de los posibles sesgos desde las verificadoras, a quienes se les planteó cuestiones referidas a su trabajo y, en concreto, a su propia percepción respecto a los sesgos que podrían tener. Las entrevistas se realizaron de forma telemática a través de la plataforma Microsoft Teams entre los días 27 de noviembre y 13 de diciembre de 2023 y tuvieron una duración aproximada de 15 minutos. Las cinco personas entrevistadas fueron seleccionadas por las propias agencias de verificación sometidas a estudio sobre la base de su experiencia profesional y los cargos ocupados.

En segundo lugar, se realizó una aproximación cuantitativa a los desmentidos publicados por cada una de las verificadoras seleccionadas y su análisis, con el objetivo de contar con datos objetivos para dar contraste y significado a las entrevistas. En ese sentido, se tomaron los registros del último año natural completo disponible, en este caso 2023. Para tal fin, se utilizó un repositorio de verificaciones contenido en una base de datos que es el resultado del proyecto Iberifier. El acceso a la misma se llevó a cabo a través de una API creada en colaboración con las verificadoras. La base de datos resultante comprendió un total de 2 323 verificaciones tabuladas con criterios consensuados por las verificadoras para unificar las variables recogidas -titular, fecha, fuente, tema, fuentes, formatos y veredicto, entre otras-, las categorías -“Alerta falsa”, “Cita falsa”, “Contenido manipulado”, “Contexto falso / Información falsa”, “Invent”, “Sátira”, “Timo”, “No especificado” u “Otros”- y los veredictos -“Verdadero”, “Engañoso”, “Manipulado”, “Falso”, “No verificable”, “Sin pruebas” o “Explainer”-.

Por último, se realizó un análisis del contenido para aportar contexto respecto a las verificaciones, con el objetivo de determinar, teniendo en cuenta el tema, el significante y el tono, qué tipo de narrativa se estaba desmintiendo. Para ello, se tabuló cada una de las verificaciones en función de si el sujeto o el contenido de la misma respondía a intereses o acciones identificables con la “izquierda”, con la “derecha”, o si tal distinción era “no aplicable” -por ejemplo, desmentidos referentes a timos genéricos que engloban varios desmentidos de distinto signo, o cuestiones de alcance difuso-.

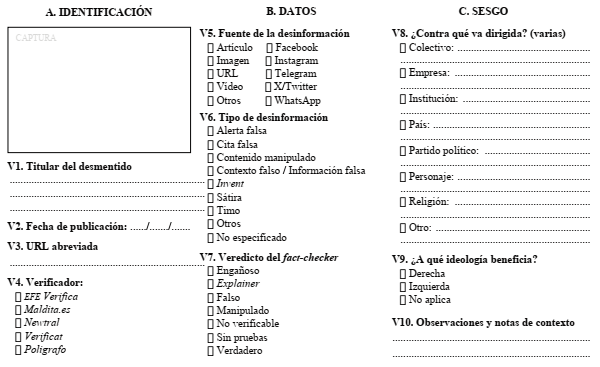

La aproximación cuantitativa y el análisis de contenido se llevaron a cabo utilizando una ficha de recogida de datos (ver Anexo) diseñada ad hoc que permitió tomar los datos identificativos -captura, titular, fecha, fact-checker y URL- y de contenido -fuente y tipo de la desinformación y veredicto del fact-checker- de cada uno de los desmentidos proporcionados por la API, a los que se añade un tercer bloque destinado a analizar los posibles sesgos -contra qué va dirigida la desinformación, a qué ideología beneficia y notas de contexto-. Los datos obtenidos fueron procesados posteriormente usando Google Forms para su incorporación conjunta en formato de hoja de cálculo digitalizada.

Los tres métodos aplicados cuentan con una amplia tradición en la investigación social. En el caso de las entrevistas, se buscaron respuestas concretas respecto al objeto de estudio (Lanuez & Fernández, 2014) que sirvieran para identificar hitos relevantes. La aproximación cuantitativa buscó objetivar la incidencia de dichos fenómenos a través de rasgos particulares encontrados en la muestra, que se aplica, en palabras de Guevara et al. (2020), “cuando se desea describir, en todos sus componentes principales, una realidad” (p. 165). Por último, el análisis del contenido es, según Krippendorff (2002), una técnica de investigación que pretende trazar, a partir de datos estructurados, “inferencias reproducibles y válidas que puedan aplicarse a su contexto” (p. 28), lo que ayudó a explicar las afirmaciones de las entrevistas y los datos cuantitativos.

Resultados

Entrevistas a los verificadores

Tal y como se adelantaba en el apartado metodológico, nuestra investigación hizo visible, en primer lugar, la autopercepción que los profesionales del fact-checking tenían de los posibles sesgos que podrían existir en las propias agencias de verificación. Sobre la base de estudios previos, como el de Baptista et al. (2022), se les formuló a los cinco verificadores una primera pregunta respecto a si observaban o no sesgos políticos en algunas plataformas de verificación. En el caso de que la respuesta fuera afirmativa, pero no argumentativa, se preveía ahondar con una segunda pregunta en la que se pudiera plasmar en qué veían esos sesgos; y, tanto si la respuesta era afirmativa como negativa, si no abordaba la intensificación del fenómeno alrededor de momentos de alta actividad informativa, como los procesos electorales, se les preguntaba a los verificadores específicamente por esta cuestión.

En líneas generales, se puede afirmar que los verificadores entrevistados niegan, de entrada, que los sesgos condicionen el trabajo en el gremio del que forman parte. Si bien también introdujeron matices interesantes que merece la pena tener en cuenta. Desde EFE Verifica plantean, por ejemplo, que los fact-checkers “somos sujetos, por tanto, simplemente el hecho de seleccionar está influyendo nuestra forma de pensar, pero creo que el trabajo de verificación en España es muy honesto”. En una línea similar, desde Verificat manifiestan creer:

Bastante en el trabajo que hacen las agencias de fact-checking. Y suelen ser bastantes rigurosos. Evidentemente algún sesgo puede haber, porque las verificaciones las hacen las personas; pero justamente el hecho de que tenga que haber tantas personas implicadas a la hora de emitir un veredicto hace también que los sesgos se puedan neutralizar.

En una línea parecida, desde Newtral afirman que “todos tenemos nuestra opinión sobre las cosas, [pero el trabajo de la coordinación de verificadores] es evitar que estos sesgos proliferen”. Alegan, además, que hay cuestiones que no son debatibles -cifras, fechas, etcétera- y aspiran a centrar las verificaciones en esto. “Luego puede haber otras cuestiones que son más debatibles, pero ahí tal vez hacemos una pieza explicativa o contando lo que se sabe … Creo que los sesgos existen, pero el trabajo que tenemos es intentar reducirlos al mínimo”.

En relación con esta prevención del sesgo, resulta también interesante el contrapeso de las redes de verificación al que aludía Maldita.es, ya que la pertenencia “a organismos internacionales [comporta] una metodología y una serie de compromisos. Ahí ya tienes una política de neutralidad”. Esto no quiere decir que la producción de verificaciones arroje un balance equilibrado entre desinformaciones de uno y otro signo, algo en lo que una mayoría de los verificadores entrevistados parecen estar de acuerdo. Continúan explicando, en este sentido,

Sí que es cierto que si te pones a verificar en Estados Unidos, siendo totalmente imparcial, seguramente desmientas más a la parte de Donald Trump que a la parte de Biden. O sea, no quiere decir que los demócratas no mientan … pero si el trumpismo está prácticamente potenciándose con desinformación, si te pones a desmentir, seguramente desmentirás bastante más a Trump.

Por ello, en Maldita.es creen que si se hace:

Un análisis puramente numérico de cuánto desmienten de uno y cuánto desmienten de otro los verificadores, pues entonces igual también estás partiendo de una base que no es correcta, que sería “hay la misma cantidad de desinformación en ambos lados del espectro político”.

En un sentido similar, EFE Verifica concuerda en que no es cabal tratar de generar una producción equilibrada en función de la orientación ideológica de los diseminadores de desinformación, “porque hay algunos que desinforman más que otros … hay pruebas de que algunos han preparado estrategias de desinformación”. Aplicando un paralelismo con la cita que decía que “la democracia no consiste en darle un minuto a los nazis para que se expliquen y darle un minuto a los judíos para que se expliquen”, continúan, el fact-checking no siempre puede ser neutral porque no todos desinforman por igual. “La neutralidad en esto”, concluyen, “no funciona, hay que ser honestos”.

Polígrafo rehúsa, en consonancia con otros verificadores que utilizan una aproximación similar, juzgar el trabajo de sus compañeros y compañeras; pero sí destaca una tendencia a la politización que trasciende a los fact-checkers y es extensible a todo el panorama mediático. “En ocasiones se va demasiado lejos; [los medios] tratan de ser militantes de una causa y esto conduce a errores … yo no diría sesgo, pero sí hay una tendencia”. Para este verificador, “los medios se están convirtiendo en algo parecido a la propaganda, e incluso [cuando lo que dices] es verdad, tenemos que mantener una cierta distancia y dudar”. Estos esquemas se ven durante periodos electorales, pero, en general:

Ocurre en momentos en que la sociedad está movilizada o centrada en algo. Pasó durante la pandemia, al principio de la guerra de Ucrania … es algo que impacta o que consigue atraer el interés de toda la sociedad y tiene un gran impacto sobre ella.

Aproximación cuantitativa

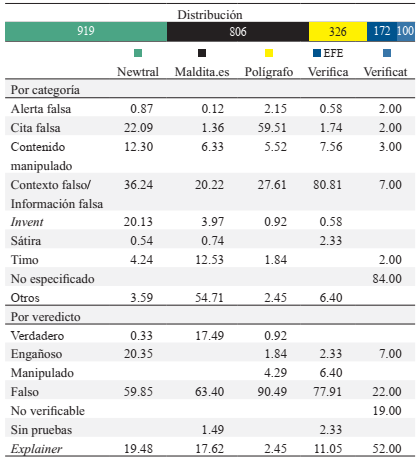

Tal y como se ha expuesto en el apartado metodológico, una vez recogidas las impresiones de los entrevistados representantes de cada una de las verificadoras, se procedió a crear una base de datos de su trabajo. Durante el año natural analizado, que comprende del 1 de enero al 31 de diciembre de 2023, ambos días incluidos, las cinco verificadoras analizadas publicaron un total de 2 323 verificaciones de diversa índole. En este punto, se llevó a cabo una aproximación cuantitativa al contenido verificado para poder hacer una descripción del mismo que permitiera dimensionarlo (Figura 1).

Fuente: Elaboración propia.

Figura 1 Anatomía de las verificaciones: distribución total y porcentaje por categoría y veredicto

Lo primero que se observa es que se otorga un reparto desigual entre las cinco verificadoras, ya que dos tercios de la muestra corresponden a las publicaciones de dos de ellas -Newtral, con 919, y Maldita.es, con 806, que suman el 39.56 % y 34.7 %, respectivamente-. Es menor la frecuencia de publicación, y por tanto la contribución de Polígrafo -con 326 verificaciones, el 14.03 % del total-, EFE Verifica -172, el 7.4 %- y Verificat -100, el 4.3 %-. Es pertinente, a través de esta aproximación cualitativa, abordar la incidencia de cada verificadora tanto en la categoría de contenido publicado como en el tipo de veredicto emitido, más allá de su peso en el total de la muestra.

De todas las categorías, la que se repite con una mayor incidencia es la de “Contexto falso / Información falsa”, que se corresponde, por orden, al 80.81 % del contenido de EFE Verifica, al 36.24 % del de Newtral, al 27.61 % de Polígrafo y al 20.22 % de Maldita.es. Solo se observa una incidencia menor en Verificat, con un 7 %. Tras ella, aparecen otras categorías destacadas como “Cita falsa”, que se da en el 59.51 % del contenido de Polígrafo y el 22.09 % del de Newtral.

Hay, además, otras categorías destacadas a tener en cuenta por los verificadores. Así, en el caso de Newtral destacan un 20.13 % de “Invent” y un 12.3 % de “Contenido manipulado”. Por su parte, en el de Maldita.es despunta la incidencia de “Timo” con un 12.43 % del contenido, aunque la mayoría -un 54.71 %- se va a “Otros”. Por último, es relevante que en Verificat un 84 % del total esté categorizado como “No especificado”.

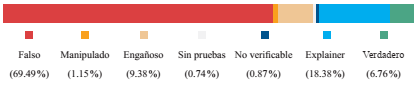

Por último, es de interés también abordar la distribución del contenido en función del veredicto emitido, aspecto contemplado en los objetivos descritos. En una aproximación general (Figura 2), y teniendo en cuenta que la muestra está fuertemente condicionada por la preeminencia de publicaciones de Newtral y Maldita.es, se observa un importante desequilibrio: el 69.49 % de los veredictos son de “Falso”, los cuales contrastan con apenas un 6.76 % de “Verdadero”.

El desequilibrio es aún mayor si se aglutinan los veredictos de negatividad -el propio “Falso”, junto a “Manipulado” y “Engañoso”-, que alcanzan un 80 %. El resto de la muestra comprendería veredictos que no son en esencia ni negativos ni positivos, en concreto “Explainer” -un 18.38 % del total-, “No verificable” -0.87 %- y “Sin pruebas” -un 0.74 %-.

Fuente: Elaboración propia.

Figura 2 Distribución total del contenido según los veredictos otorgados

Al analizar la distribución de los veredictos por cada verificadora, se observa que el mayoritario de “Falso” es casi monopolístico en Polígrafo, con un 90.49 % de sus publicaciones, así como mayoritario en EFE Verifica, con un 77.91 %; Maldita.es, con un 63.4 %, o en Newtral, con un 59.85 %, además de un 22 % en Verificat, el único en el que no es el veredicto mayoritario.

En contraposición, llama la atención que el veredicto “Verdadero” apenas se da en un 17.49 % del contenido de Maldita.es, el verificador que con mayor frecuencia lo usa, pasando al 0.92 % del contenido de Polígrafo y 0.33 % de Newtral, mientras que EFE Verifica y Verificat no han registrado casos.

A nivel individual de cada verificador, conviene destacar algunos casos de incidencia puntual, como el de Newtral, que consignó un 22 % de su contenido verificado como “Engañoso”, o Verificat, que consideró un 19 % del suyo “No verificable” -la única verificadora que usó dicho veredicto-.

Mención aparte merece el veredicto “Explainer”, que no responde a un veredicto en sí, sino a un tipo de contenido explicativo elaborado por las verificadoras para aportar contexto. Este recurso fue usado por Verificat en la mayoría de su contenido, un 52 %, y presentó incidencias importantes también en Newtral -19.48 % de su contenido-, Maldita.es -17.62 %- o EFE Verifica -11.05 %-.

Análisis del contenido

El análisis del contenido aplicado a las 2 323 verificaciones que componen la muestra evidencia distintos tipos de publicaciones por parte de las verificadoras. La mayoría son de índole política, social o económica, y están dedicadas a desmentir, matizar o, en menor medida, confirmar afirmaciones contenidas en discursos de políticos, titulares de medios de comunicación o mensajes en redes sociales y plataformas de mensajería. Otras, numerosas pero con menor incidencia, se centran en alertar sobre posibles bulos o estafas contra la ciudadanía. Esta investigación se enfoca en las primeras, pues son las que expresan un posicionamiento ideológico de forma más directa.

En este conjunto heterodoxo de publicaciones hay un número elevado de ellas que son desinformaciones referidas a argumentos amplios y complejos, en algunos casos recurrentes en el tiempo, y de carácter internacional. Más que bulos puntuales, son piezas de narrativas más elaboradas que muestran en su mayoría líneas de discurso coincidentes en puntos reconocibles: oposición a la inmigración, oposición al globalismo, negacionismo medioambiental, acientifismo y crítica a las minorías -sexuales, de género o de cualquier otro tipo-, entre otras cuestiones cercanas al discurso de la alt-right internacional.

Dichas narrativas se concretan en desinformaciones que, en conjunto, se engarzan para tejer discursos poliédricos e interconectados. Por ejemplo, se puede criticar el intervencionismo del Estado por su apoyo económico a las políticas de género, al tiempo que se denuncia un supuesto abuso de una persona transexual en una competición deportiva femenina. Hay ejemplos similares en muchos ámbitos: vincular inmigración con crimen, recepción de ayudas estatales y al Estado con dilapidación de recursos públicos para comprar votos de los inmigrantes. O, por citar un ejemplo más, señalar a los coches eléctricos como grandes contaminadores, negar el cambio climático por una ola de frío, y afirmar que gobiernos y organizaciones supranacionales quieren restringir el consumo de carne animal para impulsar el consumo de insectos.

La concreción de esas narrativas se adapta a distintos momentos informativos, así como a las especificidades locales. Así, por ejemplo, las críticas a la inmigración reflejadas en las verificaciones españolas tienden a hablar de magrebíes y latinos, mientras que las portuguesas se centran en subsaharianos; del mismo modo, en Portugal es frecuente encontrar narrativas críticas acerca de la imagen o el desarrollo del país, mientras que en España se centran en cuestiones más vinculadas a la polarización política.

Junto a esas narrativas amplias existen, sobre todo en el caso español, publicaciones “locales” reactivas, es decir, verificaciones dadas como respuesta a declaraciones o publicaciones recientes muy orientadas a la actualidad nacional. Hay, además, un volumen relevante de desinformaciones ubicadas en países extranjeros que varían en función de la actualidad del momento, por ejemplo, la invasión de Ucrania, los disturbios en Francia o la ofensiva israelí sobre Gaza.

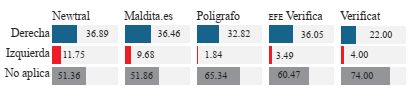

A través del análisis del contenido, se han clasificado las publicaciones registradas en función de si los argumentos verificados responden a una ideología de izquierda o de derecha, o si dicha clasificación no sería aplicable, algo que sucede en la mayoría de los casos. Dentro del contenido que sí refleja una tendencia ideológica, se observa ya un primer sesgo estructural: entre el 22 % y el 38 % del mismo es consistente con una tendencia de derecha, mientras el de izquierda se refleja apenas entre un 1.84 % y un 11.75 % de los casos (Figura 3).

Fuente: Elaboración propia.

Figura 3 Distribución general de la ideología de las verificaciones, por verificadora

De hecho, se da la circunstancia de que las dos verificadoras con mayor volumen de publicación son justo las que menor tasa de “no aplica” presentan, lo que marca incidencias que, pese a ser mayores, no desdibujan ese desequilibrio: en el caso de Newtral, un 36.89 % del contenido verificado es de derecha, contra un 11.75 % de izquierda, mientras que en Maldita.es la brecha escala al 38.46 % frente al 9.68 %. En ambos casos la diferencia es entre tres y cuatro veces mayor.

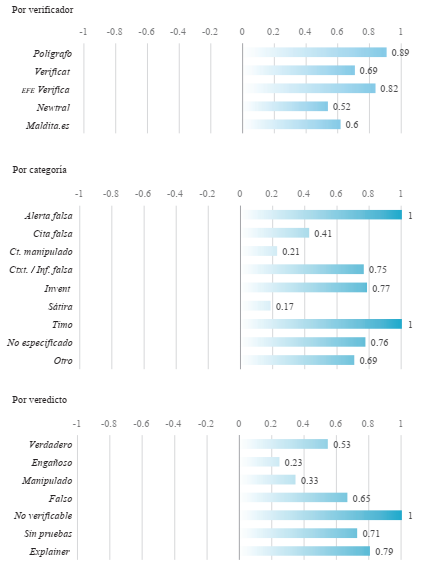

Para profundizar en el análisis, se procedió a hacer una segunda medición, para la cual se computó solo el contenido que manifiesta un sesgo ideológico claro -obviando las publicaciones tabuladas como “no aplica”-, y se cuantificó el sesgo restando el porcentaje resultante de contenido de izquierda al de derecha en una escala entre -1 a +1, siendo -1 un valor que correspondería al 100 % de contenido publicado con sesgo de izquierda, el +1 un valor que correspondería al 100 % de contenido publicado con sesgo de derecha y el 0 un reparto equilibrado.

La media general de todo el contenido se ubica en el 0.61, marcado como media de referencia para la distribución detallada de resultados. Una vez conocida la media general, se procedió a estimar el cálculo de forma individual para cada verificador, cada categoría del contenido publicado y tipología de veredicto (Figura 4). La primera lectura que ofrecen los datos es que todas las mediciones arrojan valores positivos, lo cual indica que en todas hay más verificaciones de contenidos con ideología de derecha que de izquierda.

Fuente: Elaboración propia.

Figura 4 Ubicación en rango izquierda-derecha de la incidencia de los desmentidos

Se observan ciertas diferencias entre las verificadoras. Sucede, por ejemplo, con Newtral y Maldita.es que, además de ser las que más contenido publican, son las que muestran un sesgo menos pronunciado dentro del desequilibrio, con valores de 0.52 y 0.6, respectivamente, quedando cerca Verificat, la de menor tasa de publicación, con un valor de 0.69. Las dos verificadoras con mayor sesgo de publicación son EFE Verifica, con valor de 0.82, y Polígrafo, con 0.89.

Mayores son las diferencias si se atiende a la categoría de las publicaciones, pero en este caso sí es conveniente tener en cuenta el número de elementos de cada una. Así, las categorías “Alerta falsa” y “Timo” muestran un valor 1 -el más a la derecha posible-, pero cabe tener en cuenta que en estos casos las muestras son apenas de tres y un elemento, respectivamente. Sucede lo mismo con las categorías “Sátira” -12 elementos- y “No especificado” -17 elementos-, que obtienen valores de 0.17 -el menor sesgo de todos- y 0.76, respectivamente.

Sí son más representativas el resto de categorías, desde la menos sesgada -”Contenido manipulado”, con valor de 0.21 para 73 casos-, “Invent” -0.77 para 113-, “Cita falsa” -valor de 0.41 para 239-, “Otros” -0.69 para 276- y “Contexto falso / Información falsa” -0.75 para 308-. Se da la circunstancia de que, con la excepción de “Invent”, a mayor número de elementos, mayor sesgo a la derecha.

En lo referente al análisis centrado en los veredictos, se observa de nuevo que hay algunos con una muestra demasiado reducida como para tener en cuenta los valores resultantes: se trata de “No verificable” -con un solo elemento-, “Manipulado” -con seis- y “Sin pruebas” -con siete-.

Al margen de ellos, y en orden de incidencia, aparecen “Verdadero” -con 47 elementos para un valor de 0.53-, “Engañoso” -con 142 y un valor de 0.23, cerca del equilibrio-, “Explainer” -con 182 y valor de 0.79- y “Falso” -con 657, casi dos tercios de la muestra resultante y valor de 0.65-.

Discusión

El auge de la desinformación y sus consecuencias en la salud de las democracias pone de relieve el peso de las agencias de verificación en el panorama comunicativo actual. Sin embargo, la participación de esas verificadoras responde, como sucede con los medios, a lógicas competitivas por la captación de audiencia. Eso lleva a que presenten importantes desequilibrios entre ellas, por ejemplo, en el número de contenidos que publican y el enfoque que dan a estas, así como los temas que tratan, que no son siempre coincidentes. Esas lógicas no menoscaban, sin embargo, la importancia crítica de su labor a la hora de poner de manifiesto las prácticas desinformativas que buscan influir en la generación de opinión de la ciudadanía a la que ya apuntaron autores como Luengo y García Marín (2020) o Fridkin et al. (2015).

En este punto surgen varias cuestiones fundamentales, una vez confirmados los desequilibrios de conflicto e ideológico, que podrían alumbrar futuras investigaciones. Por ejemplo, si el enfoque de conflicto, que denota una tendencia más reactiva a la desinformación que proactiva en la prevención, es la estrategia más adecuada de cara a combatir la desinformación. Cabe plantearse, en ese sentido, si una mayor incidencia de confirmaciones -expresadas en este caso como veredictos positivos de “verdadero” o, al menos, “verdadero con matices”- podrían suponer una aportación útil y constructiva o, por el contrario, no. Es muy posible que, en un contexto de desinformación masiva, el papel de las verificadoras deba centrarse en contrarrestar más que en proponer, y en desmentir más que en alfabetizar respecto a la fiabilidad de la información.

Sin embargo, la cuestión más acuciante a la luz de los resultados reside en clarificar cuál es el motivo detrás de los desequilibrios detectados, tal y como se apuntaba anteriormente: si se debe a que el alcance de la desinformación de derecha es mucho mayor que el de la desinformación de izquierda, y en ese caso la selección es correcta y el sesgo es estructural. O si, por el contrario, se debe al propio sesgo de selección de las verificadoras, que podrían estar poniendo el foco más en un lado del eje ideológico que en el otro. En las entrevistas, los propios verificadores apuntan a ese matiz para explicar que tal hecho podría no responder a un sesgo, sino a la consecuencia lógica de una realidad: que haya más desinformación de un signo que de otro hace inevitable el desequilibrio.

Autores como Baptista et al. (2022), Lowrey (2017) o Marietta et al. (2015) abordaron con anterioridad los sesgos en los propios fact-checkers, pero la cuestión debe ir más allá de su identificación para poner el foco en si responden o no a un motivo estructural y justificado.

En este sentido, cabría también proponer como limitación de este trabajo y posible línea para futuras investigaciones ahondar en las entrevistas en profundidad a verificadores y convertirlas en elemento central de la investigación y no solo en técnica exploratoria. La reciente investigación de García-Marín et al. (2023) analizaba el tratamiento a los partidos políticos españoles por parte de Newtral y concluía sin apreciar diferencias significativas, pero sí mayor incidencia de verificaciones al Partido Popular, lo que “podría indicar un sesgo de selección” (p. 220) al que también apunta nuestra investigación.

Por último, y dado el ámbito geográfico de la investigación propuesta, sería interesante llevar a cabo análisis similares en otras regiones europeas y de otros continentes para dilucidar si existen los mismos desequilibrios de forma global o no. En caso de que se reproduzcan con incidencia similar, cabría preguntarse si se puede deber a sesgos generalizados en el sector, aunque también podrían apuntar a la existencia de narrativas desinformadoras de derecha de gran alcance; lo anterior abriría interesantes líneas de investigación acerca de la posible existencia de un fenómeno desinformativo vinculado con una determinada ideología, ahondando en sus posibles conexiones y coordinación a escala global.

Conclusiones

La presente investigación tuvo el objetivo de determinar si existen sesgos en la labor de fact-checking de las verificadoras de referencia en España y Portugal. Para aportar contexto, se definieron tres objetivos secundarios: el primero de ellos fue dilucidar si existía un sesgo de conflicto, entendiendo como tal que en los veredictos emitidos hubiera una presencia notablemente superior de desmentidos que de confirmaciones. La aproximación cuantitativa al contenido demuestra que se da un reparto desigual de las verificaciones en varias dimensiones. Primero, desde las verificadoras, con Newtral y Maldita.es, ya que suman casi tres cuartas partes del total. Segundo, con categorías como “Contexto falso / cita falsa” y “Contenido manipulado”, que son las categorías mayoritarias de los veredictos. Tercero y último, en la línea de lo apuntado por Muddiman y Scacco (2023), se da una muy notable incidencia del contenido con veredicto “Falso” de hasta el 80 % del total, agregando los veredictos “Manipulado” y “Engañoso”, siendo que el “Verdadero” apenas llega al 6.76 % del total.

El segundo objetivo secundario consistía en analizar si existían sesgos ideológicos en la desinformación analizada, en este caso si se desmentían más desinformaciones de derecha que de izquierda. En ese sentido, las entrevistas confirman que existe, ya desde las propias verificadoras, la percepción de que se verifica mucho más contenido de derecha que de izquierda. La aproximación cuantitativa y el análisis del contenido posteriores confirman no solo que existe tal desequilibrio hacia la derecha, sino que además se da de forma generalizada, no solo en todas las verificadoras, sino también con independencia de la categorización de la desinformación o del veredicto emitido, en línea con lo detectado en otros países en los que la desinformación política operó de forma intensiva (Allcott & Gentzkow, 2017; Alonso-López et al., 2021).

El tercer objetivo secundario buscaba analizar a qué variables responden ambos desequilibrios -que haya más desmentidos que confirmaciones, y más narrativas desinformativas procesadas de derecha que de izquierda-, en concreto si se dan con mayor o menor incidencia en función del verificador o del tipo de veredicto. Se observan en este punto dos tendencias llamativas: por un lado suele cumplirse, aunque no siempre sea así, que a mayor número de elementos verificados, mayor sea la inclinación hacia la derecha; por otro lado, se observa que los veredictos de “Verdadero” presentan menor desequilibrio (0.53) que los “Falsos” (0.65), y mucho menor que los “Explainer” (0.79), lo que indicaría que los “verdaderos” son ligeramente más transversales hacia la izquierda, y que las agencias utilizan géneros más explicativos, sobre todo para aportar contexto acerca de narrativas amplias de derecha.

text in

text in