Introducción

La temática central que se intenta estudiar en este artículo gira en torno a la gestión ética y la seguridad en el uso de la inteligencia artificial por estudiantes universitarios. Se procede a examinar cómo la creciente adopción de herramientas de IA en la educación universitaria genera desafíos en materia de protección de datos, transparencia de algoritmos y responsabilidad en la toma de decisiones, con el objetivo principal de proponer estrategias que permitan garantizar (o al menos dar una opción asequible) un uso responsable de esta tecnología. Este análisis se concentra en el contexto actual donde la digitalización educativa y la necesidad de establecer (o actualizar) normativas internas que aseguren la integridad de los procesos de enseñanza y aprendizaje.

El problema de investigación que se identifica en este artículo está en la ausencia de marcos éticos y protocolos de seguridad específicos para el uso de inteligencia artificial en las instituciones de educación superior en muchos países de Latinoamérica (siendo Guatemala un ejemplo de esto). Moya y Fajardo (2023) también afirman que el análisis de la IA evidencia riesgos en la privacidad que requieren marcos éticos sólidos, por lo que, aunque existen directrices generales desarrolladas en Universidades de países europeos para el desarrollo responsable de la IA, hay un vacío en la implementación práctica de estas normativas en el ámbito universitario latinoamericano, lo que puede derivar en riesgos como la pérdida de privacidad, sesgos algorítmicos y una gestión inadecuada de la información real. Este problema es evidente en estudios recientes, como el de la UNESCO (2024), que ha resaltado la necesidad de adaptar y fortalecer las políticas de uso tecnológico para proteger tanto a los estudiantes como a las instituciones.

Estudiar y priorizar este tema es importante para la educación superior actual debido a la creciente integración de la IA en el entorno académico y su impacto en la calidad educativa y la protección de la información, tanto por docentes como por estudiantes. Es necesario investigar este problema para desarrollar un marco de referencia que combine estrategias de capacitación, normativas internas y buenas prácticas en seguridad, permitiendo con esto que el uso de las tecnología emergentes y futuras se realice de forma ética y segura. En el presente estudio, el marco teórico se fundamenta en la ética digital y la seguridad de la información, combinados con conceptos de análisis de riesgos en el uso de tecnologías emergentes. Se sustentan los postulados de autores que han tratado este tema en distintos aspectos y las directrices de la Declaración de Montreal para el Desarrollo Responsable de la IA, que definen principios de transparencia, responsabilidad y protección de datos. Además, se establecen las variables clave de análisis que incluyen la integridad de la información, el sesgo algorítmico y la percepción de seguridad en entornos educativos. Y para posicionar este artículo en un contexto de campo, se realiza un estudio cuantitativo que se enmarca en 60 estudiantes de diferentes facultades y de varias Universidades de Guatemala, esto no con la intención de ser una muestra representativa del país, sino como un ejemplo que refuerza la tesis de este estudio.

El objetivo general de esta investigación, por tanto, es desarrollar un marco integral que permita gestionar de forma ética y segura el uso de la inteligencia artificial por parte de estudiantes universitarios. Para ello, se plantea identificar los desafíos específicos que surgen en la adopción de estas herramientas en entornos académicos y proponer estrategias prácticas y normativas internas que mitiguen los riesgos asociados. Este enfoque busca no solo mejorar la protección de la información en el ámbito universitario, sino también promover una cultura de responsabilidad digital y ofrecer algunas alternativas viables que integren los avances tecnológicos con estándares éticos de educación superior que pueden servir de referente para distintas universidades de Latinoamérica.

Método

El enfoque de la presente investigación es cuantitativo, y se clasifica como un estudio descriptivo y relacional, ya que se busca analizar las percepciones y prácticas en torno al uso ético y seguro de la inteligencia artificial por parte de los estudiantes universitarios. Se utiliza un diseño transversal, dado que la información se recolecta en un único momento, lo que permite identificar tendencias y relaciones actuales entre las variables de interés.

La población de estudio estuvo conformada por 120 estudiantes universitarios de diversas disciplinas y de distintas casas de estudio. La muestra quedó integrada por 60 estudiantes seleccionados mediante muestreo no probabilístico por conveniencia, a partir de la participación voluntaria tras una invitación difundida por las coordinaciones académicas. Este procedimiento no permite afirmar representatividad estadística de la población; por ello, los resultados se interpretan como evidencia del grupo participante y no se generalizan al total de la población. La recolección de datos se realizó mediante una encuesta estructurada que evaluó prácticas y percepciones sobre la utilización de la inteligencia artificial y la ética que la rodea, complementadas con una revisión documental de fuentes académicas, normativas y estudios previos que aportaron información relevante sobre la ética en el uso de tecnologías digitales. Como instrumentos de apoyo se emplearon un cuestionario validado, y guías de análisis para la revisión documental.

Para la recolección de datos se utilizó un cuestionario estructurado diseñado con base en la literatura especializada sobre ética digital y seguridad en el uso de la inteligencia artificial. El instrumento estuvo conformado por 20 ítems distribuidos en dos dimensiones (gestión ética y seguridad en el uso de IA), con una escala de respuesta tipo Likert de 5 puntos (1 = totalmente en desacuerdo, 5 = totalmente de acuerdo). La validez de contenido fue establecida mediante revisión de expertos en didáctica universitaria y ética tecnológica, mientras que la validez de constructo se apoyó en la coherencia entre ítems y dimensiones teóricas. En cuanto a la confiabilidad, el cuestionario alcanzó un coeficiente α de Cronbach de 0.87, considerado estadísticamente aceptable para este tipo de estudios.

El estudio consideró cuatro variables principales: percepción de seguridad, conocimiento ético, frecuencia de uso de inteligencia artificial y sesgo percibido. La percepción de seguridad se midió mediante ítems tipo Likert (1 = muy inseguro a 5 = muy seguro) que evaluaban la confianza del participante en el uso de herramientas digitales. El conocimiento ético se operacionalizó a través de preguntas sobre principios de privacidad, transparencia y responsabilidad, con rangos de respuesta de 0 (desconoce) a 3 (domina plenamente). La frecuencia de uso de IA se evaluó con una escala ordinal de 1 (nunca) a 5 (uso diario). Finalmente, el sesgo percibido se midió mediante reactivos que indagaban la percepción de discriminación o parcialidad en el uso de algoritmos, también en escala Likert de cinco puntos.

Previo a su participación, los estudiantes recibieron una explicación clara sobre los objetivos del estudio y un consentimiento informado digital, que aseguraba su participación voluntaria. El protocolo de investigación contó con la aprobación de un comité de ética institucional, lo que garantizó la pertinencia metodológica y la protección de los participantes. Asimismo, se adoptaron medidas de anonimización de datos y resguardo seguro de la información, asegurando que los resultados solo se usaran con fines académicos y de investigación.

Entre las limitaciones del estudio se reconoce el tamaño reducido de la muestra y la posible presencia de sesgos debido al muestreo por conveniencia y a la integración de los participantes, lo cual podría influir en la generalización de los resultados. Asimismo, se contempla la posibilidad de que las respuestas de la encuesta reflejen percepciones subjetivas más que comportamientos observables, lo que puede indicar la importancia de complementar el análisis con la revisión documental o con un estudio cualitativo para obtener una visión más integral del fenómeno estudiado.

Resultados

A continuación se discuten los datos que se han obtenido a partir de la encuesta aplicada a 60 estudiantes universitarios de diferentes carreras y universidades, lo cual sirve como base para reflexionar acerca de la gestión ética y la seguridad en el uso de la inteligencia artificial en entornos académicos. Este análisis de resultados busca profundizar en cómo los alumnos perciben y utilizan las aplicaciones de IA, así como en los posibles riesgos y beneficios que dichas herramientas presentan para su desarrollo formativo. Cabe aclarar que, del total de dieciséis preguntas, solo se tomaron las que se consideraron más relevantes para el presente artículo.

Fuente: Resultado de investigación propia del autor

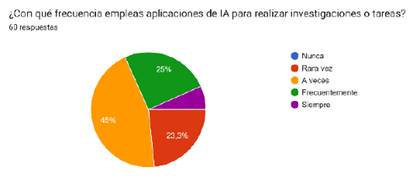

Figura 1 ¿Con qué frecuencia empleas aplicaciones de IA para realizar investigaciones o tareas?

Esta pregunta se centró en la frecuencia con la que los estudiantes utilizan aplicaciones de IA para realizar investigaciones o tareas en su formación universitaria. De acuerdo con los resultados, la mayoría emplea estas herramientas de manera ocasional o frecuente, mientras un porcentaje menor las usa de forma constante. Estas respuestas nos indican que la IA ha permeado (en tan poco tiempo) la dinámica académica de los estudiantes, y no siempre de forma sistemática. Simbaña, Jimenez, Quiliguan, García, y Ortíz (2024) refuerzan la idea que, desde la gestión ética y la seguridad, es muy importante hacer notar que, a mayor uso de herramientas de IA, surge una necesidad más apremiante de pautas y lineamientos claros para garantizar la integridad académica y la protección de datos, y que la educación actual exige la adopción de códigos y normativas claras para garantizar un uso responsable de la tecnología. También es importante notar que el uso ocasional o moderado podría ser por la cautela de los alumnos al no tener una plena certeza de la confiabilidad de las aplicaciones de IA o al no contar con una formación suficiente en este ámbito.

Fuente: Resultado de investigación propia del autor

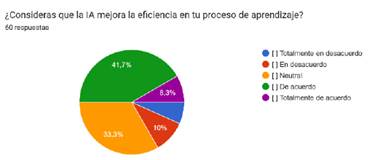

Figura 2 ¿Consideras que la Ia mejora la eficiencia en tu proceso de aprendizaje?

La segunda pregunta se dirigió hacia la pregunta de si los estudiantes consideran que la inteligencia artificial mejora la eficiencia en su proceso de aprendizaje, y los resultados indican que la mayoría (entre “De acuerdo” (33.3%) y “totalmente de acuerdo” (41.7%)) percibe un impacto positivo en su aprendizaje. Un grupo menor (“Neutral” 10%) refleja cierta indecisión o desconocimiento de las posibilidades que la IA ofrece, mientras un reducido porcentaje que marcó “En desacuerdo” (8.3%) muestra escepticismo ante su utilidad. Estos hallazgos evidencian que, si bien la mayoría reconoce ventajas en cuanto a rapidez, accesibilidad y personalización de recursos, persisten dudas sobre la fiabilidad o la ética de su implementación. Dentro del marco de la gestión ética y la seguridad, esta inclinación favorable hacia la IA sugiere la necesidad de reforzar la formación de los estudiantes para que, además de aprovechar las mejoras en eficiencia, comprendan los posibles riesgos en términos de privacidad de datos y honestidad académica. Cabe mencionar también que, el respaldo mayoritario a la IA como un factor de eficiencia plantea el reto de establecer lineamientos claros que promuevan un uso responsable de la tecnología, de modo que su integración en el aprendizaje sea sostenible y segura para la comunidad universitaria.

Fuente: Resultado de investigación propia del autor

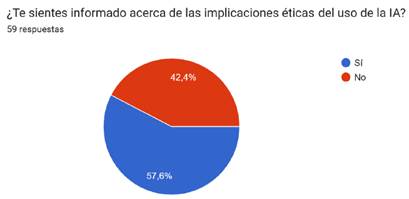

Figura 3 ¿Te sientes informado acerca de las implicaciones éticas del uso de la IA?

Fuente: Resultado de investigación propia del autor

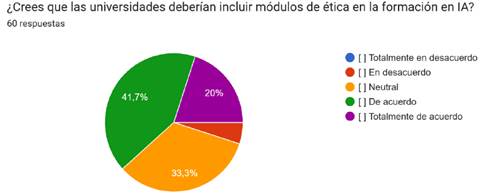

Figura 4 ¿Crees que las universidades deberían incluir módulos de ética en la formación en IA?

Las respuestas sobre la inclusión de módulos de ética en la formación en IA muestran que un gran sector de los estudiantes (41.7% “Totalmente de acuerdo” y 33.3% “De acuerdo”) respalda la necesidad de integrar estos contenidos en el currículo universitario, mientras un 20% se mantiene en posición “Neutral” y no se registran respuestas de desacuerdo; este panorama confirma que existe una alta sensibilización hacia los aspectos éticos y de seguridad en el uso de la inteligencia artificial, coherente con los hallazgos previos del estudio que señalan preocupaciones significativas en torno a la protección de datos y la transparencia algorítmica. Al no observarse un porcentaje de rechazo, puede inferirse que los estudiantes reconocen la relevancia de contar con una formación ética sólida para afrontar los riesgos asociados al uso de tecnologías emergentes; sin embargo, la presencia de un segmento neutral sugiere la necesidad de reforzar la difusión de lineamientos y de formación especializada, a fin de lograr que todos los alumnos asuman un rol proactivo en la adopción de buenas prácticas, contribuyendo así a la construcción de un entorno académico seguro y ético.

Fuente: Resultado de investigación propia del autor

Figura 5 ¿Confías en que las universidades implementen protocolos adecuados de seguridad para el uso de la IA?

Los datos muestran que la mayoría de los estudiantes (48.3%) se mantienen neutrales respecto a la confianza en que las universidades implementen protocolos de seguridad adecuados para el uso de la IA, mientras que un 30% está de acuerdo y un 13.3% totalmente de acuerdo; por otro lado, un 8.3% se manifiesta en desacuerdo, lo cual sugiere que, si bien no existe un fuerte rechazo a la capacidad institucional para regular y proteger el uso de la IA, la mitad de la muestra aún no expresa una postura definida o sólida al respecto. Este resultado podría interpretarse como un indicador de que, aunque hay una aceptación razonable de la labor universitaria en la implementación de protocolos, sigue siendo necesario reforzar la comunicación y transparencia de dichas medidas, así como generar una mayor sensibilización sobre la importancia de la seguridad en el uso de herramientas de IA; de esta forma, las instituciones de educación superior podrían consolidar la confianza de sus estudiantes, promoviendo a la vez una cultura de responsabilidad y protección de datos que atienda los retos éticos inherentes al empleo de tecnologías emergentes.

Fuente: Resultado de investigación propia del autor

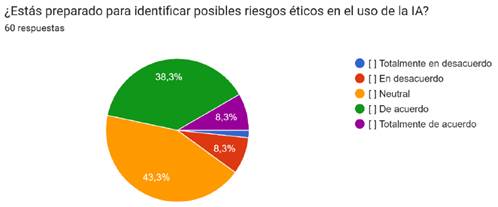

Figura 6 ¿Estás preparado para identificar posibles riesgos éticos en el uso de la IA?

Los resultados evidencian que un 43.3% de los estudiantes se ubica en una posición neutral frente a su preparación para identificar riesgos éticos en el uso de la IA, seguido de un 38.3% que considera estar de acuerdo y un 8.3% que se muestra totalmente de acuerdo, mientras otro 8.3% se declara en desacuerdo y no se registran respuestas de “Totalmente en desacuerdo”; esta distribución sugiere que, aunque existe un grupo significativo que percibe contar con ciertas habilidades o conocimientos para reconocer potenciales problemas éticos, predomina una actitud de incertidumbre que podría deberse a la falta de formación específica o la escasa difusión de directrices institucionales claras. Por esta razón, se refuerza la importancia de diseñar programas de capacitación y difusión más efectivos en el ámbito universitario, de modo que se promueva una conciencia colectiva y una preparación sólida para trata los desafíos éticos que surgen en la adopción de tecnologías de inteligencia artificial.

Fuente: Resultado de investigación propia del autor

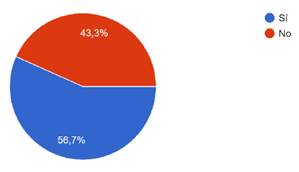

Figura 7 ¿Estás preparado para identificar posibles riesgos éticos en el uso de la IA?

Los datos de esta pregunta indican que el 56.7% de los participantes considera que la adopción de IA en la educación afecta la calidad del aprendizaje, mientras que un 43.3% opina lo contrario, lo que revela una ligera mayoría que percibe un impacto significativo (positivo o negativo) en la experiencia formativa al incorporar tecnologías de inteligencia artificial. Esta división de opiniones puede atribuirse tanto a la percepción o sesgo de beneficios, como la personalización y el acceso más rápido a la información, como a posibles riesgos relacionados con la ética y la seguridad de los datos, que podrían generar recelo sobre la fiabilidad de las herramientas o la autenticidad de los procesos de aprendizaje. En este sentido, se refuerza la importancia de un tratamiento integral que no solo promueva la adopción de la IA para optimizar resultados académicos, sino que también establezca lineamientos claros de formación ética y protocolos de seguridad, de manera que la implementación tecnológica contribuya positivamente al desarrollo educativo sin comprometer la calidad ni la integridad de los procesos de enseñanza-aprendizaje.

Fuente: Resultado de investigación propia del autor

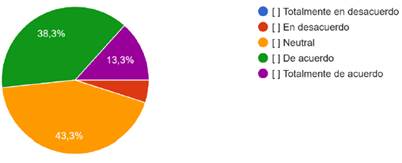

Figura 8 ¿Consideras que la implementación de medidas de seguridad reduce el riesgo de mal uso de la IA?

Los resultados reflejan un amplio consenso respecto a la efectividad de las medidas de seguridad para reducir el riesgo de mal uso de la IA, puesto que un 43.3% de los participantes se declara de acuerdo y un 38.3% totalmente de acuerdo, mientras un 13.3% se mantiene neutral y solo un 5% está en desacuerdo; esta distribución indica que, si bien la mayoría reconoce la importancia de protocolos y normativas que garanticen un empleo responsable de la tecnología, persisten algunos niveles de escepticismo y de falta de información entre quienes no respaldan o no se posicionan claramente al respecto. Con base en las respuestas previas sobre la necesidad de incorporar formación ética y supervisión institucional, es posible inferir que reforzar la concienciación sobre los riesgos y las buenas prácticas contribuiría a una mayor adhesión a las políticas de seguridad, lo cual resulta esencial para mitigar potenciales brechas y promover un entorno académico que integre la IA de manera ética y confiable.

Fuente: Resultado de investigación propia del autor

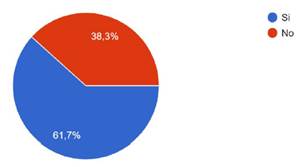

Figura 9 ¿La seguridad de los datos es una prioridad en tu experiencia con la IA?

Los datos de esta pregunta nos muestran que el 61.7% de los encuestados considera la seguridad de los datos como una prioridad en su experiencia con la IA, mientras que un 38.3% no la percibe como tal; esta brecha refleja que, si bien una mayoría de estudiantes está consciente de la relevancia de proteger la información personal y académica, aún existe un grupo significativo que podría subestimar los riesgos asociados a la manipulación de datos o a la vulnerabilidad de los sistemas. Siguiendo la línea con los hallazgos anteriores sobre la necesidad de incorporar módulos de formación ética y protocolos de seguridad, resulta importante reforzar la sensibilización sobre la importancia de la privacidad y la protección de datos, ya que esto no solo reduce la probabilidad de malas prácticas, sino que también contribuye a un entorno educativo donde la adopción de la IA se realice de manera ética y responsable.

investigación

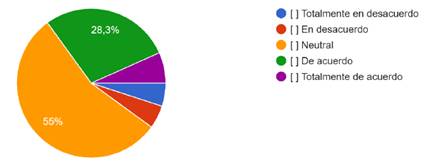

Figura 10 ¿Confías en las políticas de seguridad informática establecidas en tu universidad?

Los resultados nos muestran que la mayoría de los encuestados (55%) se mantiene en una posición neutral respecto a su confianza en las políticas de seguridad informática de su universidad, seguido de un 28.3% que está de acuerdo y un 5% que se muestra totalmente de acuerdo, mientras que un 8.3% y un 3.3% se expresan en desacuerdo y totalmente en desacuerdo, respectivamente; este panorama sugiere que, si bien existe un segmento que valora positivamente las medidas de seguridad institucionales, prevalece la incertidumbre entre la mayoría de los estudiantes, lo cual coincide con hallazgos previos que destacan la necesidad de fortalecer la comunicación y la transparencia en la implementación de protocolos de seguridad.

Tabla 1 Describe alguna experiencia personal en la que el uso de la IA haya generado inquietudes éticas o de seguridad, y cómo crees que se podría haber manejado la situación

| Hasta el momento no he tenido una experiencia como esa, tienen un buen protocolo para peticiones fuera de lo normal y eso está bien. Bueno en mi sintonía la he usado algunas veces pero como no se confía tanto en información ya que ahora de todo se roban la información personal! Ayuda algunos problemas pero no ayuda a ejercer al estudiante como debe de ser así como ir personal! Hace poco se me instaló en automático una IA en messenger de FB, y empezó a salir publicidad de determinados artículos de hogar que había ojeado en una página de FB. Se podría manejar mejor si grupo META preguntara antes de autoinstalar en las app's este tipo de IA. Al abrir la aplicación y que se redirija a otra aplicación o página Web, o que pida datos personales o incluso monetarios. En un momento no estaba seguro de la información y investigando me di cuenta que la información era inventada por la IA Por ahora ninguna y he utilizado mucho la ia, también pago chat Gtp premium En busquedas ya que aveces no genera el link de donde saco la información para verificar si esta es real o no No me ha pasado La IA es una herramienta estupenda pero es como un arma se dos filos, soy sincera yo la utilizo pero la mayoría del tiempo solo verificar mis resultados Le pedí que interpretará un sueño que tuve y sin saber tanto detalle de mi vida solo con el sueño logro interpretar cosas que me han pasado Anuncios en base a las busquedas realizadas en IA, se comparte información a empresas como Meta. Yo la eh tomado como una guía por lo tanto pienso que no debemos creer 100% en lo que sale ya que pueden fallar. Pues debe de manejar adecuadamente, para que nos ayude a poder a realizar o darnos la idea como poder trabajar durante la universidad |

Fuente: Resultado de investigación propia del autor

Las respuestas cualitativas a esta última pregunta evidencian una variedad de experiencias que oscilan entre la ausencia de incidentes relevantes y la detección de prácticas cuestionables relacionadas con la protección de datos o la fiabilidad de la información; algunos participantes señalan que no han enfrentado problemas serios gracias a “buenos protocolos” o a un uso moderado de la IA, mientras otros expresan inquietud por la falta de transparencia, como la instalación automática de herramientas en redes sociales, la recolección de datos sin consentimiento y la aparición de anuncios publicitarios basados en sus búsquedas. Asimismo, se observa desconfianza ante la posibilidad de que la IA genere información inventada o imprecisa, lo cual pone de relieve la necesidad de verificar las fuentes y cuestionar la fiabilidad de los resultados. Por otro lado, varios participantes enfatizan la conveniencia de concebir la IA como un recurso útil, pero de “doble filo”, que requiere lineamientos claros para evitar la vulneración de la privacidad y el mal uso de la información. En conjunto, estos relatos indican la importancia de fortalecer la formación ética y establecer protocolos de seguridad robustos, tanto para proteger la integridad de los datos como para promover un uso responsable y transparente de la tecnología.

Discusión

Ahora, se procede a realizar un análisis crítico comparativo que contrasta los hallazgos empíricos obtenidos a partir de la encuesta aplicada a estudiantes universitarios con las bases teóricas que sustentan el estudio, en particular los postulados de la ética digital, la seguridad de la información y las directrices internacionales para un uso responsable de la inteligencia artificial.

En cuanto a la percepción de los estudiantes y sus implicaciones respecto a la ética y la seguridad en el uso de la IA, se observa una notable convergencia con las bases teóricas presentadas en el estudio, como los postulados de la ética digital y las directrices de la Declaración de Montreal. Los datos empíricos evidencian que una amplia mayoría respalda la incorporación de módulos de formación ética en el currículo universitario y la implementación de protocolos de seguridad robustos, lo que refuerza la premisa teórica de que el uso responsable de tecnologías emergentes requiere marcos normativos sólidos que aseguren la integridad de los procesos académicos y la protección de datos. Este alineamiento sugiere que, al adoptar estas medidas, se puede promover una cultura de responsabilidad digital que cumpla con los estándares internacionales de transparencia y protección de la información.

Sin embargo, la comparación también nos muestra discrepancias importantes entre la teoría y la práctica, ya que una parte significativa de los estudiantes se muestra neutral o indecisa respecto a la confianza en las políticas de seguridad institucionales y su preparación para identificar riesgos éticos. Esta divergencia sugiere que, pese a la existencia de lineamientos teóricos, la aplicación práctica de estos protocolos y la comunicación institucional sobre los mismos aún presenta deficiencias. Por lo tanto, resulta imprescindible reforzar la capacitación y la difusión de las normativas, cerrando la brecha entre las expectativas teóricas y la realidad percibida por los estudiantes, para garantizar que la adopción de la IA en entornos educativos se lleve a cabo de manera realmente ética y segura.

La evaluación de la efectividad de los protocolos y medidas de seguridad, a la luz de los postulados teóricos de la ética digital y las directrices internacionales, indica que existe un marco conceptual sólido que enfatiza la necesidad de proteger la integridad de la información y garantizar la transparencia en el uso de la IA; sin embargo, la aplicación práctica de estas normativas en el entorno universitario revela limitaciones, especialmente en lo que respecta a la comunicación institucional y la capacitación especializada, lo cual impide que las medidas teóricas se traduzcan de manera efectiva en prácticas cotidianas. Esta contraposición sugiere que, si bien los lineamientos éticos propuestos son pertinentes y necesarios, la implementación de estos protocolos se ve afectada por deficiencias en la difusión y en la formación, lo que debilita el impacto esperado en la seguridad y en la gestión ética del uso de la inteligencia artificial.

Por otro lado, la evaluación crítica de las percepciones estudiantiles pone de manifiesto que, a pesar del reconocimiento general de la importancia de adoptar medidas de seguridad y capacitación en ética, persiste una marcada incertidumbre y neutralidad en torno a la eficacia de las políticas institucionales actuales. Esta ambivalencia indica la necesidad de reforzar y actualizar los programas de formación y los mecanismos de supervisión interna, para que los estudiantes no solo conozcan las directrices teóricas, sino que también experimenten de manera tangible su aplicación en el ámbito académico. Así, se podría cerrar la brecha entre la teoría y la práctica, garantizando un entorno educativo en el que la integración de la IA se realice de forma ética, segura y coherente con los estándares internacionales.

En consonancia con los resultados obtenidos en este estudio, algunos autores han señalado la urgencia de establecer mecanismos de formación ética y seguridad digital en la educación superior. Por ejemplo, Mendoza (2024) identifica, en un estudio con estudiantes universitarios ecuatorianos, una percepción general positiva sobre el uso de IA, pero acompañada de dudas importantes sobre los límites éticos y la transparencia de las plataformas utilizadas, lo cual coincide con el alto porcentaje de estudiantes en este trabajo que expresan neutralidad o escepticismo en torno a su preparación ética. Asimismo, Ríos (2024) destaca que, aunque los estudiantes reconocen la utilidad de la IA para fines académicos, la confianza en las políticas institucionales de seguridad informática sigue siendo baja, en clara correspondencia con los hallazgos aquí presentados, donde más del 50% de los participantes manifestaron posturas neutrales frente a estas medidas.

Sin embargo, otros estudios como el de Vera (2023) han subrayado avances significativos en universidades que han adoptado modelos integrales de gobernanza tecnológica y marcos normativos adaptativos, lo que contrasta con los hallazgos de este estudio, donde se evidencia una brecha entre las normativas y su aplicación efectiva. Esta diferencia resalta la necesidad contextual: mientras ciertas universidades han comenzado a consolidar estructuras claras de regulación del uso de IA, muchas otras (como en el caso guatemalteco) aún se encuentran en fases incipientes de implementación o carecen de mecanismos efectivos de comunicación institucional.

Por otro lado, estudios como el de Guaña-Moya y Chipuxi-Fajardo (2023) remarcan que uno de los principales desafíos es la falta de alfabetización digital crítica en los usuarios, lo cual se alinea con la neutralidad o falta de preparación declarada por los estudiantes en esta investigación. Esta convergencia subraya la importancia de programas formativos sostenibles, no solo para conocer herramientas de IA, sino para evaluar sus implicaciones éticas y riesgos de seguridad de forma informada y consciente.

A partir de esta revisión comparativa, se puede concluir que los resultados de este estudio no solo confirman hallazgos previos, sino que aportan evidencia empírica actualizada desde un contexto subrepresentado como Guatemala, fortaleciendo el argumento de que es urgente regionalizar las políticas de gobernanza ética en IA, atendiendo a realidades institucionales concretas y promoviendo una cultura de responsabilidad digital acorde con los desafíos contemporáneos.

Tabla 2 Tabla comparativa de hallazgos

| Estudio | Coincidencias con el presente estudio | Diferencias destacables |

|---|---|---|

| Mendoza (2024) | Reconocen utilidad de la IA, pero evidencian dudas sobre ética y transparencia. | En su estudio, hay mayor claridad normativa institucional frente a lo observado en Guatemala. |

| Ríos Hernández (2024) | Baja confianza en políticas institucionales de seguridad digital. | Su muestra incluye más acciones proactivas estudiantiles frente a la ciberseguridad. |

| Vera (2023) | Destaca la importancia de gobernanza ética en IA. | Muestra universidades con marcos normativos más consolidados. |

| Guaña-Moya y Chipuxi-Fajardo | Coinciden en la falta de alfabetización digital crítica y formación ética en estudiantes universitarios. | Ellos proponen intervenciones didácticas institucionales ya en ejecución, aún ausentes en el presente estudio. |

Fuente: Creación propia del autor

Conclusiones

El estudio cumple su objetivo al demostrar que es factible desarrollar un marco integral para gestionar de forma ética y segura el uso de la inteligencia artificial en entornos académicos, evidenciando que mediante estrategias de capacitación y la implementación de normativas internas específicas se pueden mitigar los riesgos asociados y fomentar un ambiente educativo más responsable.

Los datos revelan que la percepción estudiantil sobre la IA es heterogénea, lo que hace énfasis en la necesidad de protocolos claros que no solo aseguren la protección de datos, sino que también fortalezcan la transparencia en el uso de estas herramientas, contribuyendo a una mayor confianza en las medidas institucionales.

El artículo a través de su contenido teórico y práctico destaca que, a pesar de reconocer los beneficios en términos de eficiencia y accesibilidad, persisten inquietudes sobre la integridad académica y la privacidad, lo que indica que la integración de la IA debe ir acompañada de una revisión y actualización constante de las políticas y prácticas de seguridad.

También se evidencia la importancia de un enfoque colaborativo que involucre a académicos universitarios, estudiantes y expertos en tecnología, permitiendo diseñar estrategias formativas y reguladoras adaptadas a los rápidos avances tecnológicos y a las necesidades emergentes del entorno educativo superior.

Futuras líneas de investigación

Los resultados obtenidos han permitido identificar varias líneas que merecen una profundización académica más allá del alcance original de este estudio. En primer lugar, se destaca la necesidad de explorar con mayor detalle la relación entre el perfil académico del estudiante (carrera, nivel de formación, experiencia previa con herramientas digitales) y su percepción de la ética en el uso de la inteligencia artificial. Esta variable podría aportar información clave para el diseño de estrategias formativas diferenciadas por disciplinas.

Asimismo, se propone como línea futura el estudio del rol de las políticas institucionales de IA en universidades de Latinoamérica, particularmente aquellas que ya han implementado códigos de ética, protocolos de uso y capacitaciones sistemáticas. La comparación entre instituciones con y sin marcos normativos consolidados podría contribuir a la construcción de estándares de gobernanza adaptados a contextos regionales.

Otra dimensión de interés radica en el análisis de las competencias docentes en relación con la alfabetización ética digital y su influencia en la formación del estudiante. La visión de los docentes, actualmente ausente en este trabajo, se considera esencial para comprender las tensiones, resistencias y oportunidades en el proceso formativo en torno al uso de IA.

Por último, se sugiere abordar mediante metodologías cualitativas la dimensión subjetiva y cultural de la percepción ética del uso de IA, lo cual podría revelar creencias, actitudes y narrativas que no emergen plenamente en instrumentos cerrados. Esta exploración permitiría enriquecer los marcos de análisis desde una perspectiva más holística e interdisciplinaria.

nova página do texto(beta)

nova página do texto(beta)