Predicción de lecturas de aforos de filtraciones de presas bóveda mediante redes neuronales artificiales

Prediction of Gauge Readings of Filtration in Arch Dams using Artificial Neural Networks

David Santillán*, Jesús Fraile-Ardanuy, Miguel Ángel Toledo

Universidad Politécnica de Madrid, España

*Autor de correspondencia

Dirección institucional de los autores

David Santillán

Miguel Ángel Toledo

Departamento de Ingeniería Civil: Hidráulica y Energética

Escuela Técnica Superior de Ingenieros de Caminos,

Canales y Puertos

Universidad Politécnica de Madrid

28040, Madrid, España

david.santillan@upm.es

Departamento de Tecnologías Especiales Aplicadas a la

Telecomunicación

Escuela Técnica Superior de Ingenieros de

Telecomunicación,

Universidad Politécnica de Madrid

28040, Madrid, España

Recibido: 25/04/13

Aceptado: 09/09/13

Resumen

Las redes neuronales artificiales son estructuras matemáticas inspiradas en el cerebro de los seres vivos, capaces de generar modelos numéricos no lineales de calibración relativamente sencilla. En el presente trabajo se modela el caudal de agua filtrado a través del cimiento rocoso de una presa bóveda piloto con una red neuronal tipo perceptrón multicapa. La filtración a través de un macizo rocoso es un fenómeno difícil de modelar debido a la imposibilidad de caracterizar con detalle el medio en el que discurre y por la complejidad del propio fenómeno. El resultado final es un modelo compuesto por tres neuronas ocultas agrupadas en una capa y cuyas variables de entrada son el nivel de agua en el embalse y tres velocidades de la misma en periodos anteriores. La estructura de la red neuronal se determina teniendo en cuenta la influencia de cada una de las variables de entrada sobre las variables de salida. Para ello, se parte de un conjunto extenso de posibles variables de entrada extraídas de los modelos analíticos o conceptuales del fenómeno físico a modelar.

Palabras clave: auscultación presas, filtraciones, presa bóveda, redes neuronales artificiales.

Abstract

Artificial neural networks are mathematical structures inspired by the brain of live beings which can generate relatively simple non-linear numerical calibration models. The present work models the flow of water filtered through the rocky base of a pilot arch dam using a multi-layer perceptron neural network. Seepage through a rock mass is difficult to model because it is impossible to obtain a detailed characterization of the medium through which it passes and because of the complexity of the process. The final result is a model composed of three hidden neurons grouped in a layer, using as input variables the water level in the reservoir and their three velocities from prior periods. The structure of the neural network is determined considering the influence of each of the input variables on the output variables. This is based on an extensive set of possible input variables extracted from analytical or conceptual models of the physical phenomenon to be modeled.

Keywords: Arch dams, seepage, artificial neural networks, dam monitoring.

Introducción

]]> La filtración de agua a través de macizos rocosos es un fenómeno difícil de modelar numéricamente. El medio donde tiene lugar, el macizo rocoso, es difícil de caracterizar debido a la presencia de diaclasas ocultas en su interior, por la heterogeneidad de las características de la masa rocosa que lo compone y por los variados grados de fractura del macizo (Li et al., 2008). A esto se le suma la propia complejidad del fenómeno de la filtración en sí. Sin embargo, en determinadas situaciones es necesario disponer de un modelo que sea capaz de predecir la filtración que se debería producir en un determinado macizo.Una de esas situaciones más interesantes son los embalses generados por la presencia de una presa, debido a que estas infraestructuras son singulares por sus dimensiones, su vida útil, su impacto territorial y especialmente por el riesgo que supone su presencia. Debido a ello existe una preocupación que impulsa a investigar tanto los posibles problemas existentes en las presas como nuevos métodos para supervisar su comportamiento. Así, por ejemplo, un problema presente en algunas de ellas construidas hace ya décadas es la reacción álcali-árido, la cual deteriora las características mecánicas del hormigón. La forma de controlar dicho problema es, por una parte, desarrollando métodos de cálculo para estudiar la evolución de las consecuencias de dicha reacción sobre la respuesta de la presa frente a las acciones a las que se encuentra sometida (Comi et al., 2009), y por otra parte, con experimentos para evaluar la reactividad potencial de los áridos (Martín et al., 2010; Campos et al., 2010).

Las lecturas de los caudales de agua filtrados a través del cimiento de la presa son uno de los datos más útiles para conocer si existe alguna alteración en el mismo, la cual incidirá de manera directa sobre el comportamiento de la infraestructura (ASCE, 2000). La estrategia habitual a seguir para supervisar el comportamiento estructural comienza con la recopilación de las lecturas de ciertos aparatos instalados en la misma y que controlan determinadas variables representativas de su comportamiento —como los caudales filtrados a través del cimiento o los movimientos de determinados puntos de la estructura—, al igual que obteniendo información cualitativa procedente de las inspecciones visuales. El proceso continúa con la interpretación y evaluación de los datos recopilados y la información, para lo que se dispone de modelos de predicción de la lectura de dichos aparatos bajo las condiciones en las que se encontraba la presa en el momento de la lectura de los mismos. Finalmente se toman decisiones sobre las actuaciones a realizar si se detecta o se sospecha de alguna anomalía.

Frente a la necesidad de modelar numéricamente fenómenos cuya complejidad puede tener diversas causas, como el desconocimiento parcial o total de las leyes que los rigen o la dificultad de caracterizar el medio en que se desarrollan, las redes neuronales artificiales se perfilan como una herramienta útil (Rafiq et al., 2001). Sus aplicaciones se extienden a muchas ramas de la ingeniería, entre ellas: ingeniería de software (Singh et al., 2009), ingeniería química (Jamal et al., 2006) o ingeniería civil (Flood, 2001).

En este artículo se describe la aplicación de las redes neuronales tipo perceptrón multicapa a la modelación numérica del caudal de agua filtrado a través del cimiento de una presa bóveda medido en uno de sus aforadores. Las redes neuronales se perfilan como una herramienta adecuada para ello. Así, el objetivo del presente trabajo es aplicar y evaluar la capacidad de los modelos neuronales para reproducir el fenómeno planteado.

Antecedentes y marco de referencia

Modelos típicos de predicción del comportamiento de presas

Los modelos de predicción del comportamiento de presas se clasifican en modelos no deterministas, deterministas e híbridos. Todos ellos requieren de dos tipos de datos o variables: las variables respuesta y las variables exteriores. Las variables respuesta son magnitudes físicas representativas de un aspecto del comportamiento de la estructura, y se miden con un aparato o sensor de auscultación instalado en dicha estructura o en el exterior, como es el caso de las lecturas de movimientos mediante DGPS (Galán-Martín et al., 2011). Algunas de las variables más importantes son el caudal de agua filtrado, el movimiento de ciertos puntos de la estructura o las presiones piezométricas registradas en determinadas ubicaciones del cimiento (Marengo-Mogollón, 1996). Las variables exteriores son aquellas magnitudes físicas cuya variación induce un cambio significativo de una o varias variables respuesta, como el nivel de agua en el embalse.

Los modelos no deterministas relacionan las variables respuesta con las exteriores a través de un conjunto de funciones que dependen de las variables exteriores. Un ejemplo de modelo no determinista es el modelo estadístico, en el cual las variables respuesta se relacionan con las exteriores a través de un conjunto de funciones denominadas de forma, dependientes de estas últimas. Las funciones de forma están multiplicadas por unos coeficientes que se estiman generalmente por el método de mínimos cuadrados a partir de los registros de lecturas de ambas. Desde un punto de vista estadístico, los valores de las funciones de forma son los regresores o variables explicativas de un modelo de regresión lineal múltiple y los coeficientes, los estimadores. Es de destacar que estos modelos estadísticos se emplean fundamentalmente para la predicción de las variables respuesta de movimientos (ICOLD, 2003).

]]> Los modelos deterministas relacionan las variables respuesta con las exteriores a través de leyes físicas. El medio geométrico y los procesos mecánicos, térmicos y químicos son reproducidos por medio de modelos matemáticos. Típicamente requieren discretizar el medio en elementos finitos a los que se les asocia unas leyes de comportamiento del cuerpo estructural y del cimiento. Este tipo de modelos se emplea fundamentalmente para estimar movimientos (ICOLD, 2003), aunque también se ha modelado con ellos filtraciones a través de macizos rocosos fracturados (Li et al., 2008; Yanqing, 2005) o de materiales tipo aluvial (Tayfur et al., 2005).Los modelos híbridos son una combinación entre los modelos estadísticos y los deterministas. Las funciones son determinadas con modelos deterministas de la estructura, con ensayos de laboratorio o se adoptan las propuestas en los modelos estadísticos. Ambos tipos de funciones se encuentran multiplicadas por coeficientes a calcular con técnicas estadísticas a partir de lecturas de las diversas variables tomadas en las tareas de auscultación.

Las redes neuronales artificiales

Las redes neuronales artificiales son modelos simplificados del sistema nervioso central. Constan de un número elevado de elementos de procesamiento simple (neuronas) altamente interconectados entre sí que trabajan en paralelo y son capaces de aprender, adaptarse y generar soluciones a partir de patrones o datos de entrenamiento (Martín del Brío y Sanz-Molina, 1997), resultando así modelos no lineales.

Las redes neuronales artificiales y los modelos de predicción del comportamiento de presas

En los últimos años se han elaborado modelos de comportamiento de presas con redes neuronales tipo perceptrón multicapa. Estos nuevos modelos se incluyen dentro del tipo no determinista. Ahmadi-Nedushan y Chouinard (2003) desarrollaron tres redes neuronales para modelar con cada una de ellas los movimientos de un péndulo de una presa de gravedad en una dirección del espacio. La arquitectura de la red consistía en una capa oculta con dos o tres neuronas ocultas, según la red. El procedimiento para determinar el número de neuronas fue por prueba y error. Mata (2011) modela los movimientos radiales de dos péndulos de la presa de Alto Rabagao, localizada en Vila Real (Portugal) con una red neuronal compuesta por 12 neuronas ocultas en una sola capa.

Otras variables respuesta modeladas con redes neuronales son las lecturas de piezómetros en presas de materiales sueltos (Tayfur et al., 2005) o la predicción de sus asientos (Kim y Kim, 2008). Otras investigaciones estudian las posibilidades de las redes neuronales para prever la respuesta de las presas de gravedad frente a acciones sísmicas (Joghataie y Dizaji, 2009).

Otras técnicas recientemente empleadas en la auscultación de presas son la lógica borrosa, los algoritmos genéticos o la teoría de la cointegración. Rankovic et al. (2012) emplearon con éxito la lógica borrosa para predecir los movimientos radiales de dos péndulos de la presa arco de Bocac, situada en el río Vrbas, en la República de Srpska. Los movimientos radiales de uno de los péndulos de la anterior presa también se modelaron con éxito con una técnica que combina los modelos estadísticos de predicción del comportamiento con los algoritmos genéticos (Stojanovic et al., 2013). Inicialmente, se dispone de un número elevado de regresores vacantes y se seleccionan los más adecuados por medio de la técnica de los algoritmos genéticos, siendo el modelo estadístico resultante una solución de compromiso entre calidad de predicción y complejidad del mismo. Los regresores de los modelos estadísticos tradicionalmente empleados en la auscultación de presas únicamente pueden ser usados en series temporales estacionarias. No obstante, esta condición no se suele cumplir en los casos reales. Para solucionar este problema, Li et al. (2013) proponen emplear un nuevo modelo estadístico basado en la teoría de la cointegración (Artis-Ortuño et al., 2009). El modelo se valida aplicándolo a la predicción de la lectura de los péndulos de la presa bóveda de Wanfu, situada al sur de la provincia china de Zhejiang. Las predicciones obtenidas con la nueva técnica son más exactas que las de los modelos tradicionales.

Las redes neuronales también se han aplicado exitosamente a numerosas facetas del campo de la geología y la geotecnia. Así, por ejemplo, con ellas se ha determinado la permeabilidad de suelos de grano fino, con mejores resultados que los obtenidos con modelos de regresión múltiple (Yusuf-Erzin et al., 2009). También se han empleado para estimar la carga última de cimentaciones superficiales realizadas sobre suelos sin cohesión de forma más satisfactoria que los modelos teóricos (Kalinli et al., 2011; Padmini et al., 2008), para evaluar los cambios de la evolución temporal de la presión intersticial en laderas debido a las lluvias (Mustafa et al., 2012) o la susceptibilidad de las mismas a los deslizamientos (Pradhan y Lee, 2010), o para predecir los movimientos de muros pantalla causados por la posterior excavación del recinto generado por los mismos en suelos arcillosos (Kung et al., 2007).

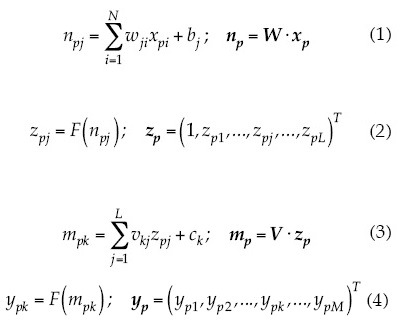

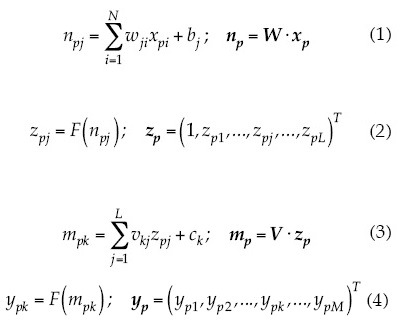

El perceptrón multicapa

]]> El perceptrón multicapa (MLP) es un modelo neuronal unidireccional compuesto por un mínimo de tres capas de neuronas: una capa de entrada, una capa de salida, y una o varias capas ocultas. Es un tipo de red neuronal muy utilizada en ingeniería (Rafiq et al., 2001; Meireles et al., 2003). Un patrón de entrada p formado por un conjunto de valores de las variables de entrada xi está representado por el vector xp = [1,xp1,...,xpN]T, donde la primera componente del vector tiene el valor 1 para incluir el sesgo b. Por su parte, wij es el peso de la conexión de la neurona de entrada i con la neurona oculta j, y vkj el de la conexión entre la neurona oculta j y la de salida k. Por otra parte, npj y mpk son los argumentos de las funciones de activación de las neuronas de la capa oculta y de salida para un patrón p dado, respectivamente; zpj e ypk son los valores de salida de la neurona j de la capa oculta y k de la de salida, respectivamente, para un patrón p dado, como resultado de aplicar la función de activación F sobre la entrada neta a la neurona.Sea una red neuronal compuesta por tres capas, con N neuronas en la capa de entrada, L neuronas en la oculta, M neuronas en la capa de salida, una matriz de pesos y sesgos entre las neuronas de la capa de entrada y la oculta W, y una matriz de pesos y sesgos entre las neuronas de la capa oculta y de salida V. Para un patrón de entrada xp, los argumentos npj de las neuronas de la capa oculta vendrán dados por la ecuación (1), los valores de salida zpj de la capa oculta por la ecuación (2), los argumentos mpk de las neuronas de la capa de salida por la ecuación (3) y la salida yp de la red neuronal por la ecuación (4):

El entrenamiento de las redes neuronales es un proceso por el cual se determina el valor de los pesos y sesgos con un algoritmo. Las topologías de las redes de tipo perceptrón multicapa se entrenan con el algoritmo de retropropagación (Haykin, 1998). Existen multitud de variaciones de este algoritmo basadas en distintas técnicas de optimización, como el gradiente conjugado o los métodos de Newton. En este trabajo se utiliza la variante propuesta por Levenberg-Marquardt debido a su rapidez de ejecución (Beale y Hagan, 2012).

Inicialmente los valores de los pesos y sesgos se toman de pequeño valor y se eligen aleatoriamente. El algoritmo proporcionará a la red un conjunto de datos de entrada, xp, y ésta calculará sus correspondientes salidas, yp. El algoritmo computará las diferencias entre yp y el valor objetivo que debería haber proporcionado la red, y*p, tratando de minimizarlas, modificando el valor de los pesos y los sesgos. Será necesario, por lo tanto, un conjunto de pares de entrada-salida (xp, y*p), denominado datos de entrenamiento, con el que la red pueda aprender.

Si se vuelve a entrenar la red de nuevo, con otros pesos y sesgos iniciales diferentes, la solución alcanzada será en general diferente de la anterior. Esto ocurre debido a que la hipersuperficie de error dispone de distintos mínimos locales y dependiendo del valor de los pesos iniciales se alcanzarán unos valores finales u otros. En la práctica se pretende una red que proporcione unas salidas con el grado de exactitud deseado, no buscando tanto el mínimo global sino uno local con la precisión necesaria (Meireles et al., 2003).

En conclusión, para unas variables de entrada dadas, diseñar la arquitectura de red es equivalente a determinar el número de capas ocultas y neuronas en cada una de ellas. Pero, además, es necesario entrenar un número suficiente de veces, partiendo de pesos iniciales distintos, hasta obtener una red que produzca soluciones con la suficiente precisión.

Selección de las variables de entrada

Una ventaja de las redes neuronales es la ausencia de necesidad de seleccionar las variables independientes más importantes. La sinapsis asociada con las variables irrelevantes tendrá pesos despreciables. En cambio, las variables relevantes poseerán pesos significativos (Meireles et al., 2003). Dicha característica se emplea en este estudio para seleccionar las variables de entrada que mejor caracterizan al fenómeno.

A partir de esta idea, diversos autores han planteado procedimientos para determinar la importancia de cada una de las variables de entrada a la red neuronal en relación con cada una de las variables de salida. Una de ellas se realiza mediante el estudio de la magnitud de los pesos propuesto por Garson (1991). Posteriormente surgió el análisis de sensibilidad basado en la matriz de sensibilidad Jacobiana. Gedeon (1997) realizó un estudio de comparación de ambos métodos, desprendiéndose que el procedimiento de la matriz Jacobiana proporciona un mejor acuerdo con la técnica expuesta en el párrafo anterior. En consecuencia, el análisis de sensibilidad basado en el cálculo de la matriz de sensibilidad Jacobiana es más fiable que el basado en la magnitud de los pesos.

]]> Los elementos que componen la matriz Jacobiana S proporcionan una medida de la sensibilidad de las salidas a cambios que se producen en cada una de las variables de entrada. En la matriz Jacobiana S de orden ixk, cada fila representa una entrada a la red y cada columna una salida, de modo que el elemento Sik de la matriz es un índice de la sensibilidad de la salida k con respecto a la entrada i. Cada elemento Sik se calcula aplicando la regla de la cadena, con la expresión siguiente:

Por tanto, cuanto mayor sea el valor absoluto de Sik, mayor es el efecto de la variable xi sobre yk. La sensibilidad ha de ser evaluada para todos los patrones de datos. Considerando la sensibilidad entre i y k para el patrón xp como Sik(p), se puede definir la sensibilidad a partir de la media muestral, E(Sik(p)), estimada mediante la ecuación (6):

Número de capas ocultas y de neuronas

El número óptimo de capas ocultas y de neuronas en cada una de ellas es una cuestión pendiente de resolver. Actualmente, la forma más común de determinarlo es aplicando el método de prueba y error (Ahmadi-Nedushan y Chouinard, 2003), aunque existen algunos consejos generales y métodos de optimización de la estructura neuronal.

Meireles et al. (2003) recomiendan incrementar el número de capas ocultas hasta alcanzar los resultados deseados del entrenamiento o bien emplear tres capas (existirá entonces una sola capa oculta) y aumentar el número de neuronas en la oculta hasta que los resultados tengan la precisión deseada. Rafiq et al. (2001) indican que una sola capa oculta con un número adecuado de neuronas es suficiente para modelar la mayoría de los problemas prácticos.

En cuanto a las neuronas ocultas, Hecht-Nielsen (1990) propone, a partir del teorema de Kolmogorov (Hassoun, 1995), que su número debe ser menor o igual a dos veces el número de variables de entrada a la red más uno.

Los métodos de optimización de la estructura de la red neuronal se pueden clasificar en dos grupos: algoritmos neuronales de poda y algoritmos neuronales de crecimiento. Ambos tienen el inconveniente de no ser computacionalmente eficientes y de no poder garantizar que el resultado sea el óptimo (Ren y Zhao, 2002). En la misma referencia se propone un nuevo algoritmo con un enfoque diferente que combina la técnica de búsqueda de la sección dorada (golden-section search technique) (Gutiérrez, 2003) y el criterio de información de Akaike (AIC). Los autores lo aplican a redes neuronales tipo perceptrón multicapa con una capa oculta y una única salida. Este criterio de información ha sido aplicado por otros autores a las redes neuronales. Así, por ejemplo, Kalin et al. (2010) seleccionan con él la red neuronal más adecuada para predecir la calidad del agua en cuencas hidrográficas o Zhao et al. (2008) diseñan la arquitectura de las redes neuronales empleadas en sus investigaciones con él.

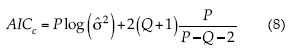

La búsqueda de la sección dorada es una técnica para encontrar el extremum de una función unimodal, que consiste en reducir sucesivamente el rango de valores, entre los cuales se encuentra la solución. El AIC aplicado a las redes neuronales según Ren et al. (2002) para el conjunto de datos de entrenamiento es un valor calculado a partir de la ecuación (7) si P/(Q + 1) ≤ 40 o la ecuación (8) si P/(Q + 1) > 40:

]]>

siendo P el número de patrones de entrenamiento;  = ∑s2/P, el error cuadrático medio entre las salidas objetivo y las calculadas por la red y Q, el número de pesos y sesgos de la red, esto es, de parámetros. El valor del AIC permite seleccionar la red óptima entre diferentes arquitecturas, considerando que a menor valor mejor será la red.

= ∑s2/P, el error cuadrático medio entre las salidas objetivo y las calculadas por la red y Q, el número de pesos y sesgos de la red, esto es, de parámetros. El valor del AIC permite seleccionar la red óptima entre diferentes arquitecturas, considerando que a menor valor mejor será la red.

Dado un problema, el número de datos de entrenamiento P y el de entradas y salidas de la red neuronal es fijo. Entonces el primer sumando de la expresión del AIC dada por la ecuación (7) o la ecuación (8) depende únicamente del error cuadrático medio del modelo y el segundo término del número de parámetros, con el objetivo de penalizar el sobreajuste.

Algoritmo de Ren de optimización de la arquitectura neuronal

La aplicación del método de la sección dorada para minimizar el valor del AIC de varias redes candidatas requiere que la función que rige su valor sea unimodal, lo cual es comprobable al finalizar el proceso. Para un conjunto dado de P datos de entrenamiento, el número mínimo de neuronas ocultas es uno y el máximo ha de ser inferior a P.

Considerando una red neuronal con una capa oculta, N entradas, L neuronas ocultas y M salidas, el algoritmo de optimización de su arquitectura consta de los siguientes pasos (Ren y Zhao, 2002):

1. Fijar el número mínimo de neuronas ocultas N0 = 1 y el máximo número posible N1 = (P - M)/(N + M + 1).

2. Calcular los puntos de la sección dorada N2 = N0 + j(N1 - N0) y N3 = N1 - j(N1 - N0), siendo j = (√5 - 1)/2 el radio de la sección dorada. N2 y N3 se redondean al entero más próximo.

]]> 3. Construir dos redes neuronales. Ambas tendrán N neuronas de entrada y M neuronas de salida, pero la primera N2 neuronas ocultas y la segunda N3.4. Entrenar cada arquitectura de red del punto anterior varias veces con diferentes pesos y sesgos iniciales y obtener de entre todas las redes resultantes aquella con el mínimo error cuadrático medio al predecir los datos de entrenamiento.

5. Calcular el valor del AIC o AICc, según corresponda, de ambas redes, obteniéndose AIC(N2) y AIC(N3). A continuación:

a) Si N0 = N1, se detiene el algoritmo.

b) Si AIC(N2) ≤ AIC(N3), se toma N0 = N0, N1 = N3 y el algoritmo continúa en el paso 2.

c) Si AIC(N2) > AIC(N3), entonces N0 = N2, N1 = N1, y el algoritmo continúa en el paso 2.

Metodología

Caso piloto

]]> La presa de La Baells fue elegida como caso piloto. Se trata de una presa bóveda de arcos de tres centros y doble curvatura, con una altura sobre cimientos de 102 metros, construida entre los años 1974 y 1975. Está situada en el río Llobregat, en el Término Municipal de Cercs i Vilada (Bergueda) de Barcelona (España).La cerrada de la presa está situada en terrenos terciarios del Oligoceno y constituida por alternancias de conglomerados y areniscas de grano medio, con algunas intercalaciones en capas delgadas de arenisca arcillosa y argilita, predominando el conglomerado sobre la arenisca. Ambas alternancias suponen aproximadamente el 85% de la formación, constituyendo el resto alternancias cementadas. Los bancos son planos, con disposición prácticamente vertical y perpendicular al cauce, con una ligera tendencia hacia el sur, siendo su dirección aproximada E-W. Esta disposición de los bancos garantiza la impermeabilidad y es favorable al apoyo de la presa.

Los conglomerados están formados por cantos de caliza, granito y cuarcita, que tienen forma redondeada, con tamaños predominantes cercanos a los 10 cm y matriz de arenisca calcárea. Son muy duros y cementados, aunque en alguna zona localizada están alterados. Las areniscas de grano grueso poseen un cemento calcáreo bastante basto, presentándose generalmente en forma de lentejones. El conjunto de argilitas y areniscas de grano fino, según su mayor o menor contenido de arenas, está constituido por rocas duras y compactas de origen arcillo-arenoso, que son bastante resistentes a la erosión.

En la presa se realiza un control de las filtraciones internas con aforadores, midiendo el caudal filtrado a través del hormigón y del cimiento. El aforador seleccionado para ser modelado mide el caudal de agua recogida en una de las galerías laterales excavadas en el cimiento.

Variables de las que depende el caudal filtrado

La filtración a través de un macizo rocoso está influida por el gradiente hidráulico, por la conductividad hidráulica del medio a través del que discurre el fluido y por el estado tensional del macizo rocoso. A su vez, el estado tensional dependerá de los esfuerzos transmitidos por la presa debido a la carga hidráulica generada por el embalse y del campo de temperaturas del hormigón de la presa y de la roca del macizo.

Debido a los fenómenos de fluencia y relajación del hormigón, y en menor medida de la roca, el caudal filtrado también resulta influenciado por la historia de cargas pasadas. Consecuentemente, existe una inercia térmica y tenso-deformacional que ralentiza los cambios.

El gradiente hidráulico depende de la cota de la lámina de agua en el embalse. El campo de temperaturas depende de la temperatura del macizo rocoso y del agua, y ambas a su vez dependerán de la temperatura ambiental. Así, la caracterización del campo de temperaturas se puede llevar a cabo con la variable temperatura diaria ambiental, T. El dato de la temperatura disponible es el medido en el emplazamiento de la presa y que aproximadamente puede considerarse representativo de la temperatura a lo largo de ese día. El campo de tensiones depende de la carga hidráulica y del campo de temperaturas. En consecuencia, se podrá caracterizar con las variables nivel de agua en el embalse H y temperatura diaria ambiental T.

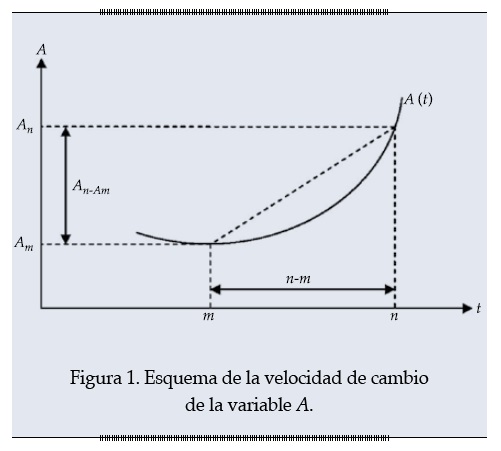

La información acerca de los estados pasados del campo de temperaturas y de tensiones se suministra a la red neuronal, cuantificando la velocidad a la que cambia la temperatura diaria ambiental y el nivel de agua en el embalse en periodos pasados. La velocidad de cambio de la variable A en el periodo (n,m), An,m, se calcula con la ecuación (9), que en términos matemáticos se corresponde con la expresión de la tasa de cambio de la función A(t):

Datos disponibles

Extrayendo los datos de las lecturas de la instrumentación instalada en la presa de La Baells, se dispone de 1 021 días en los que se midió el caudal en el aforador objeto de la investigación, comprendidos entre el 15/02/1980 y 24/10/2008. La temperatura media ambiental se registró en 8 964 días, entre el 1/10/1979 y 29/10/2008, y el nivel de agua en el embalse en 9 271 ocasiones, entre el 3/08/1979 y 29/10/2008. La elevada frecuencia de lectura de la temperatura y el nivel permite estimar las lecturas ausentes mediante interpolación lineal.

En la figura 2 se han representado, en orden descendente, los datos originales e interpolados del nivel de agua y la temperatura ambiental y las lecturas de los caudales del aforador. La matriz de coeficientes de correlación indica un grado de correlación aceptablemente bajo entre los datos, mostrándose los resultados en el cuadro 1. Los datos empleados en el entrenamiento de las redes se normalizan mediante una transformación lineal tal que sus máximos y mínimos pasaron a ser 1 y -1, respectivamente.

Diseño de la red neuronal

La metodología para definir la arquitectura neuronal se compone de los pasos representados gráficamente en el diagrama de flujo de la figura 3. En el primero se calculan los valores de las variables de entrada a la red neuronal, que son la temperatura diaria ambiental, el nivel de agua en el embalse y la velocidad de cambio de ambas variables en los periodos (0,10), (10,20) y (20,30) días. Posteriormente se seleccionan aquellas fechas en las que se dispone de registros del caudal filtrado. En total se dispone de 1 021 registros completos de valores de las variables de entrada y salida a la red neuronal.

Seguidamente, los 1 021 registros se dividen en cuatro subconjuntos denominados D1, D2, D3 y D4. El primero de ellos (D1) se usa para entrenar las redes neuronales; el segundo (D2), junto con el primero, para seleccionar redes neuronales y variables de entrada, según se explica en los sucesivos párrafos; el tercero (D3), para escoger de entre cada una de las redes obtenidas en cada iteración aquella que modelará el fenómeno objeto de estudio, y el cuarto (D4), para evaluar la capacidad predictiva de la red escogida anteriormente.

Los 1 021 registros se dividen aleatoriamente en los cuatro subconjuntos antes explicados. El primero de ellos, D1, contiene 608 registros (el 59.7% de los totales); el segundo, 207 registros (20.3%); el tercero, 103 registros (10.1%); y el cuarto, 103 registros también. Se comprueba que las cuatro muestras anteriores provienen de la misma población por medio de un test de homogeneidad.

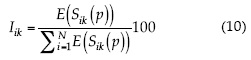

]]> Posteriormente se determina el número de neuronas ocultas para unas variables de entrada dadas con el algoritmo de Ren. Cada arquitectura de red se entrena 200 veces con el algoritmo de Levenberg-Marquardt, con pesos y sesgos iniciales diferentes, usando el subconjunto de datos D1 normalizado. De esas 200 redes con la misma arquitectura, se selecciona aquella con menor valor del AIC determinado con los subconjuntos D1 y D2, y que cumpla además que la relación entre las raíces cuadráticas medias del error, al predecir ambos subconjuntos, esté comprendida entre 0.8 y 1.2. Esta última condición busca garantizar la capacidad de generalización de la red y evitar posibles sobre-entrenamientos.El siguiente paso es el análisis de importancia de cada una de las variables de entrada a la red resultante del algoritmo de Ren. Para ello, mediante los valores de la esperanza matemática de la sensibilidad, E(Sik(p)), estimados con la ecuación (6), se define la matriz de importancia I. El elemento Iik cuantifica el efecto relativo de la variable de entrada i sobre la de salida k, en relación con el resto de variables de entrada. Los elementos de la matriz se calculan mediante la expresión:

Una vez calculada la matriz de importancia con los subconjuntos de datos D1 y D2 de forma independiente, se elimina la variable menos importante y se repite el proceso descrito en los dos párrafos anteriores con las nuevas variables de entrada. Denominaremos iteración al proceso de determinación de la mejor arquitectura de red, según el algoritmo de Ren para unas variables de entrada fijas y de evaluación de la importancia de dichas variables.

El proceso termina cuando sólo hay una variable de entrada a la red, teniéndose al final de él i redes neuronales, siendo i el número de variables de entrada iniciales.

De esas redes se escoge aquella con menor valor del AIC, calculado con el subconjunto D3, y se determina su capacidad de predicción con el subconjunto D4, en términos del valor de la raíz cuadrática media del error.

Resultados y discusión

Primera iteración

Las variables de entrada a la red neuronal en la primera iteración fueron la temperatura diaria ambiental, el nivel de agua en el embalse y la velocidad de cambio de ambas variables en los periodos (0,10), (10,20) y (20,30) días.

]]> Fijadas las variables de entrada, se determina el número de neuronas ocultas con el algoritmo de Ren. Inicialmente, el número mínimo de neuronas ocultas, N0, es 1 y el máximo posible N1, 61. Se calculan los puntos de la sección dorada, que en este primer paso son N2 = 24 y N3 = 38. A continuación se entrenan 200 redes neuronales con 24 neuronas ocultas y otras 200 con 38, cada una de ellas con diferentes pesos y sesgos. Finalizado el entrenamiento se escoge de cada arquitectura aquella red con menor raíz cuadrática media del error (RMSE), al predecir los subconjuntos D1 y D2, y que cumpla además que la relación entre las raíces cuadráticas medias del error al predecir ambos subconjuntos esté comprendida entre 0.8 y 1.2. Una vez seleccionadas se calcula el valor del AIC de ambas redes, en este caso AICc(N2) = 1 860 y AICc(N3) = 3 155. Como AICc(N2) < AICc(N3), se toma N0 = 1 y N1 = 38. Se calculan los nuevos puntos de la sección dorada, repitiéndose el proceso explicado. Los resultados de los pasos hasta alcanzar el número de neuronas óptimo se tabulan en el cuadro 2. Obsérvese en la sexta columna de dicha tabla que la forma de la función que rige los valores del AIC es unimodal, con un valor mínimo de 1 113.La arquitectura óptima tiene cinco neuronas ocultas, con valores de la raíz cuadrática media del error al predecir el subconjunto D1 y D2 de 2.28 y 2.58 l/min, respectivamente. La variable con menor valor de la importancia es la velocidad de variación de la temperatura en el intervalo (0,10), T0,10, y por consiguiente es eliminada y no se tendrá en cuenta en las sucesivas iteraciones. Obsérvese que los valores de la importancia son idénticos para ambos subconjuntos, hecho que se repite en el resto de las iteraciones.

Proceso iterativo y modelo final

El proceso se repite sucesivamente hasta que sólo hay una entrada a la red. Las raíces cuadráticas medias del error al predecir los diversos subconjuntos de datos y sus respectivos valores del AIC, al igual que el número de neuronas ocultas de las redes resultantes de cada iteración, se tabulan en el cuadro 3. El proceso continúa hasta que sólo queda una variable de entrada. El orden de eliminación de las variables es el siguiente: T0,10, T20,30, T10,20, T, H10,20, H20,30, H0,10 y H. Posteriormente se elige aquella red con el número de entradas y de neuronas ocultas que haya proporcionado el menor valor del AIC al predecir el subconjunto D3. En el caso en estudio, la red seleccionada es la de la iteración 5, cuyas variables de entrada son el nivel de agua en el embalse y sus tres velocidades de periodos (0,10), (10,20) y (20,30) días. La arquitectura de la red está compuesta por tres neuronas ocultas, con un valor de las raíces cuadráticas medias del error al predecir los subconjuntos de datos D1, D2, D3 y D4 de 2.41, 2.65, 1.96 y 1.84 l/min, respectivamente. La figura 4 muestra la predicción realizada por la red frente a la lectura del aforador.

Comportamiento de las redes neuronales

Se han determinado las variables más adecuadas para modelar el caudal aforado, a partir de un conjunto de partida. Destaca que entre ellas no se encuentra la temperatura. El aforador en cuestión recoge el agua filtrada entre las cotas 590 y 550 metros, la denominada zona de estudio. La cota más baja del pie de presa se sitúa a la 535, y la coronación a la 632. La parte superior de la zona de estudio de la filtración está 42 metros por debajo de la superficie del terreno. La parte más sensible a las variaciones térmicas coincide con los primeros metros superiores del estrato rocoso (Guidicini y De Andrade, 1988). Por ello, al encontrarse tan profunda la zona de estudio, parece lógico que las variaciones térmicas ambientales no tengan una influencia apreciable en la filtración. Por otra parte, en una presa tipo bóveda, la carga se transmite al terreno principalmente por efecto arco en la parte superior de la cerrada y esto afecta la permeabilidad de dicha zona, pero difícilmente esta afección será apreciable en el área de cimiento, cuya filtración recoge el aforador analizado.

Otro aspecto a analizar son los valores de las raíces cuadráticas medias del error, al predecir los cuatro subconjuntos de datos. Los valores de los errores en los cuatro subconjuntos son muy parecidos entre sí en cada una de las ocho iteraciones, lo cual es un indicio de ausencia de sobre-entrenamiento y capacidad de generalización de las diferentes redes. Además, en casi todos los casos, los valores del error de los subconjuntos D3 y D4 son menores que los alcanzados con los subconjuntos D1 y D2, lo que es otro indicio de capacidad de generalización. Recuérdese que el subconjunto D3 sólo se emplea al escoger una red entre las determinadas en cada iteración, no interviniendo en los cálculos ejecutados en las iteraciones.

La comparación entre redes de diferentes iteraciones, esto es, con diferentes arquitecturas, se realiza con el AIC, cuyo valor depende tanto de la raíz cuadrática media del error como de la estructura de la red. El criterio de información también depende del número de datos de cada conjunto; por ello, para una misma estructura de red existe una diferencia apreciable entre los valores del criterio calculados con los cuatro conjuntos de datos. Se observa en el cuadro 3 que en la quinta iteración se alcanza su valor mínimo para el subconjunto de datos D3, ocurriendo lo mismo para los subconjuntos D4 y D2. No pasa lo mismo para el subconjunto D1, aunque se ha de indicar que la diferencia entre el valor del criterio en la iteración quinta y en la sexta (donde se encuentra el mínimo) es tan sólo de un 2.2%.

Conclusiones

]]> La predicción de los caudales filtrados a través del cimiento registrados en un aforador de una presa bóveda elegida como caso piloto se ha realizado con un modelo de redes neuronales. El caudal de agua discurre a través de un medio, el macizo rocoso, que generalmente es muy difícil de caracterizar debido al gran número de diaclasas presentes y por el carácter heterogéneo de la masa rocosa. Además, el propio fenómeno de la filtración se rige por unas leyes físicas complejas. Frente a esta situación, las redes neuronales han sido capaces de generar un modelo de predicción de caudales filtrados que cumple con las expectativas de simplicidad y capacidad de generalización y predicción. Los resultados obtenidos abren la posibilidad de incorporar estos modelos al conjunto de herramientas disponibles para llevar a cabo las tareas de supervisión del comportamiento estructural.Además, la determinación de las variables relevantes abre la posibilidad de interpretar el fenómeno modelado. Así, por ejemplo, el fenómeno de inercia en la respuesta de la presa se puede analizar a través de las velocidades de variación de los niveles. El modelo resultante también permite estudiar la influencia de cada una de las variables exteriores sobre el caudal de agua filtrado. De este modo, si frente a una combinación de acciones exteriores en un rango habitual se produce una desviación considerable del caudal filtrado debido a una supuesta avería, ésta podría ser identificada más rápidamente. En conclusión, las características de los modelos de comportamientos de presas basados en redes neuronales artificiales las convierten en una herramienta útil para su empleo en las labores habituales de auscultación de presas. La metodología presentada se ha aplicado al caudal filtrado en un aforador, pero es fácilmente extensible a otras variables respuesta de la estructura.

Agradecimientos

Agradecemos la financiación del Ministerio de Medio Ambiente y Medio Rural y Marino del Gobierno de España a través del proyecto de investigación ``Estudio de la Seguridad de Presas e Identificación de Escenarios de Riesgo mediante Sistemas Inteligentes'' (SEPRISIS) con código 048/RN08/04.5.

Los autores también quieren expresar su agradecimiento a la empresa Ofiteco y a la Agencia Catalana del Agua por los datos proporcionados de la presa de La Baells.

Referencias

AHMADI-NEDUSHAN, B. and CHOUINARD, L.E. Use of artificial neural networks for real time analysis of dam monitoring data. Proceedings of the Annual Conference of the Canadian Society for Civil Engineering, Moncton, Nouveau-Brunswick, Canada, June, 2003. [ Links ]

]]>ARTIS-ORTUÑO, M., SURIÑACH-CARALT, J. y LÓPEZ-BAZO, E. Análisis económico regional. Nociones de la cointegración. Barcelona: Antoni Bosch, 2009, pp. 192. [ Links ]

ASCE. Guidelines for instrumentation and measurements for monitoring dam performance. Reston, Virginia: American Society of Civil Engineers, 2000, 712 pp. [ Links ]

BEALE, M. and HAGAN, M. Neural network toolbox 7. User's Guide. Natick, MA, USA: The MathWorks, 2012, 422 pp. [ Links ]

CAMPOS, P.L., GADEA, J., SORIANO, J., MARTÍN, A. y CALDERÓN, V. Reactividad álcali-sílice y álcali-silicato en pizarras. Estudios Geológicos. Vol. 66, núm. 1, enero-julio, 2010, pp. 91-98. [ Links ]

COMI, C., FEDELE, R., and PEREGO, U. A chemo-thermo-damage model for the analysis of concrete dams affected by alkali-silica reaction. Mechanics of Materials. Vol. 41, No. 3, March, 2009, pp. 210-230. [ Links ]

]]>FLOOD, I. Neural networks in civil engineering: a review. In Civil and structural Engineering Computing. Topping, B.H.V. (editor). Stirlingshire, UK: Saxe-Coburg Publications, 2001, pp. 185-209. [ Links ]

GALÁN-MARTÍN, D., MARTÍNEZ-MARÍN, R., MARCHAMALO-SACRISTÁN, M., and SÁNCHEZ-SOBRINO, J.A. Control of Movement for Concrete-Reinforced Dams using DGPS and Comparison with Auscultation Methods. Application at the La Aceña (Spain) dam. Water Technology and Sciences. Vol. II, No. 3, July-September, 2011, pp. 159-176. [ Links ]

GARSON, G.D. Interpreting neural-network connection weights. AI Expert. Vol. 6, No. 4, April, 1991, pp. 46-51. [ Links ]

GEDEON, T.D. Data Mining of Inputs: Analyzing Magnitude and Functional Measures. International Journal of Neural Systems. Vol. 8, No. 2, April, 1997, pp. 209-218. [ Links ]

GUIDICINI, G. and DE ANDRADE, R.M. Seasonal Oscillation of Uplift Pressures in Hydraulic Structure Foundations Due to Environmental Thermal Variations. In Rocks Mechanics and Power Plants. Romana, M. (editor), Rotterdam: Balkema, 1988, pp. 467-472. [ Links ]

]]>GUTIÉRREZ, A.J. Diseño de procesos en ingeniería química. Barcelona, España: Reverté, 2003, 272 pp. [ Links ]

HASSOUN, M. Fundamentals of artificial Neural Networks. Cambridge: The MIT Press, 1995, 511 pp. [ Links ]

HAYKIN, S. Neural Network: a comprehensive Foundation. 2nd ed. Upper Saddle River, USA: Prentice Hall PTR, 1998, 842 pp. [ Links ]

HECHT-NIELSEN, R. Neurocomputing. New York: Addison-Wesley Publishing Company, 1990, 433 pp. [ Links ]

ICOLD. Methods of Analysis for the Prediction and the Verification of Dam Behaviour. Swiss Committee on Dams, Baden, Suiza, 2003. [ Links ]

]]>JAMAL, S.H., HUSSAIN, M.A., AROUA, M.K., and YAAKOP, D. Artificial Neural Network Models Applied to Chemical Engineering: a Review. Trends in Chemical Engineering. Vol. 10, 2006, pp. 1-15. [ Links ]

JOGHATAIE, A. and DIZAJI, M.S. Nonlinear Analysis of Concrete Gravity Dams by Neural Networks. Proceeding of the World Congress on Engineering. Vol. 2, July, 2009. [ Links ]

KALIN, L., ISIK, S., SCHOONOVER, J.E., and LOCKABY, B.G. Predicting Water Quality in Unmonitored Watersheds Using Artificial Neural Networks. Journal of Environmental Quality. Vol. 39, No. 4, 2010, pp. 1429-1440. [ Links ]

KALINLI, A., ACAR, M.C., and GÜNDÜZ, Z. New Approaches to Determine the Ultimate Bearing Capacity of Shallow Foundations Based on Artificial Neural Networks and Ant Colony Optimization. Engineering Geology. Vol. 117 No. 1-2, January, 2011, pp. 29-38. [ Links ]

KIM, Y.S. and KIM, B.T. Prediction of Relative Crest Settlement of Concrete-Faced Rockfill Dams Analyzed Using an Artificial Neural Network Model. Computers and Geotechnics. Vol. 35, No. 3, May, 2008, pp. 313-322. [ Links ]

]]>KUNG, G.T.C., HSIAO, E.C.L., SCHUSTER, M., and JUANG, C.H. A Neural Network Approach to Estimating Deflection of Diaphragm Walls Caused by Excavation in Clays. Computers and Geotechnics. Vol. 34, No. 5, September, 2007, pp. 385-96. [ Links ]

LI, F., WANG, Z.Z., and LIU, G. Towards an Error Correction Model for Dam Monitoring Data Analysis Based on Cointegration Theory. Structural Safety. Vol. 43, July, 2013, pp. 12-20. [ Links ]

LI, P., LU, W., LONG, Y., YANG, Z., LI, J. Seepage Analysis in a Fractured Rock Mass: The Upper Reservoir of Pushihe Pumped-Storage Power Station in China. Engineering Geology. Vol. 97, No. 1, March, 2008, pp. 53-62. [ Links ]

MARENGO-MOGOLLÓN, H. Análisis de riesgo de falla en presas, estadísticas y parámetros de referencia. Hydraulic Engineering in Mexico. Vol. II, No. 6, May-August, 1996. [ Links ]

MARTÍN DEL BRÍO, B. y SANZ-MOLINA, A. Redes neuronales y sistemas borrosos: introducción teórica y práctica. Zaragona, España: Ra-ma, 1997, 387 pp. [ Links ]

]]>MARTÍN, A., GADEA, J., CAMPOS, P.L., CALDERÓN, V., GARCÍA-CALLEJA, M.A., and RODRÍGUEZ, A. Evaluación de la reactividad árido-álcali en diversos áridos silicatados. Alternativas para minimizar esta reacción. Estudios Geológicos. Vol. 66, No. 1, 2010, pp. 99-103. [ Links ]

MATA, J. Interpretation of Concrete Dam Behavior with Artificial Neural Network and Multiple Linear Regression Models. Engineering Structures. Vol. 33, No. 3, March, 2011, pp. 903-910. [ Links ]

MEIRELES, M.R.G., ALMEIDA, P.E.M., and SIMOES, M.G.A. Comprehensive Review for Industrial Applicability of Artificial Neural Networks. IEEE Transactions on Industrial Electronics. Vol. 50, No. 3, June, 2003, pp. 585-601. [ Links ]

MUSTAFA, M., REZAUR, R., RAHARDJO, H., and ISA, M. Prediction of Pore-Water Pressure Using Radial Basis Function Neural Network. Engineering Geology. Vol. 135-136, May, 2012, pp. 40-47. [ Links ]

PADMINI, D., ILAMPARUTHI, K., and SUDHEER, K. Ultimate Bearing Capacity Prediction of Shallow Foundations on Cohesionless Soils Using Neurofuzzy Models. Computers and Geotechnics. Vol. 35, No. 1, January, 2008, pp. 33-46. [ Links ]

]]>PRADHAN, B. and LEE, S. (2010). Landslide Susceptibility Assessment and Factor Effect Analysis: Backpropagation Artificial Neural Networks and Their Comparison with Frequency Ratio and Bivariate Logistic Regression Modelling. Environmental Modelling & Software. Vol. 25, No. 6, June, 2010, pp. 747-759. [ Links ]

RAFIQ, M.Y., BUGMANN, G., and EASTERBROOK, D.J. Neural Network Design for Engineering Applications. Computers & Structures. Vol. 79, No. 17, July, 2001, pp. 1541-1552. [ Links ]

RANKOVIC, V., GRUJOVIC, N., DIVAC, D., MILIVOJEVIC, N., and NOVAKOVIC, A. Modelling dam Behaviour Based on Neuro-Fuzzy Identification. Engineering Structures. Vol. 35, February, 2012, pp. 107-113. [ Links ]

REN, L. and ZHAO, Z. An Optimal Neural Network and Concrete Strength Modeling. Advances in Engineering Software. Vol. 33, No. 3, March, 2002, pp. 117-130. [ Links ]

SINGH, Y., BHATIA, P.K., KAUR, A., and SANGWAN, O. Application of Neural Networks in Software Engineering: A Review. In Information Systems, Technology and Management. PRASAD, S.K. et al. (editors). Berlin: Springer Berlin Heidelberg, 2009, pp. 128-137. [ Links ]

]]>STOJANOVIC, B., MILIVOJEVIC, M., IVANOVIC, M., MILIVOJEVIC, N., AND DIVAC, D. Adaptive system for dam behavior modeling based on linear regression and genetic algorithms. Advances in Engineering Software. Vol. 65, Noviembre, 2013, pp. 182-190. [ Links ]

TAYFUR, G., SWIATEK, D., WITA, A., and SINGH, V.P. Case Study: Finite Element Method and Artificial Neural Network Models for Flow through Jeziorsko Earthfill Dam in Poland. Journal of Hydraulic Engineering. Vol. 131, No. 6, June, 2005, pp. 431-440. [ Links ]

YANQING, W. Multi-Level Fracture Network Model and FE Solution for Ground Water Flow in Rock Mass. Journal of Hydraulic Research. Vol. 43, No. 2, 2005, pp. 202-207. [ Links ]

YUSUF-ERZIN, S.D., GUMASTE, S.D., GUPTA A.K., and SINGH, D.N. Artificial Neural Network (ANN) Models for Determining Hydraulic Conductivity of Compacted Fine-Grained Soils. Canadian Geotechnical Journal. Vol. 46, No. 8, 2009, pp. 955-68. [ Links ]

ZHAO, Z., ZHANG, Y., and LIAO, H. Design of Ensemble Neural Network Using the Akaike Information Criterion. Engineering Applications of Artificial Intelligence. Vol. 21, No. 8, December, 2008, pp. 1182-1188. [ Links ]

]]>