Cultura de evaluación en instituciones educativas. Comprensión de indicadores, competencias y valores subyacentes1

The culture of evaluation in educational institutions. Understanding of indicators, competencies and underlying values

Jaime Ricardo Valenzuela González*, María Soledad Ramírez Montoya** y Jorge Antonio Alfaro Rivera***

* Doctor en Psicología Educativa por la Universidad de Texas. Profesor–investigador de la Escuela de Graduados en Educación del Tecnológico de Monterrey. Miembro del Sistema Nacional de Investigadores. Entre sus publicaciones está: (2004), Evaluación de instituciones educativas, México, Trillas. CE: jrvg@itesm.mx

** Doctora en Filosofía y Ciencias de la Educación por la Universidad de Salamanca (España). Profesora–investigadora de la Escuela de Graduados en Educación del Tecnológico de Monterrey. Miembro del Sistema Nacional de Investigadores. Entre sus publicaciones está: (2001, en coautoría con A. Millán y R. Rivera), Calidad y efectividad en instituciones educativas, México, Trillas.CE: solramirez@itesm.mx

]]> *** Maestro en Pedagogía por la Escuela Normal Superior Oficial de Guanajuato (México), donde es profesor–investigador. Actualmente se encuentra realizando estudios de doctorado en Educación en la Universidad Pedagógica Nacional. Líneas de investigación: formación de profesores y evaluación educativa. CE: jalfa21@gmail.com

Recepción: 9 de julio de 2009

Aceptación: 30 de enero de 2010

Resumen:

Este artículo presenta los resultados de una investigación orientada a estudiar la cultura de evaluación en cinco instituciones públicas de educación media superior y superior. Se empleó un método de estudio de casos instrumental con información de 30 representantes de dichas instituciones. Los resultados obtenidos se presentan alrededor de tres componentes de una cultura de evaluación: 1) la forma en que los distintos actores educativos comprenden la evaluación y, en particular, el empleo de indicadores institucionales; 2) las competencias que tienen ciertas personas clave dentro de cada institución para realizar procesos de evaluación, así como la capacitación que deben recibir para que la evaluación se lleve a cabo de una forma adecuada; y 3) los valores subyacentes que determinan el uso que se le da a los resultados de la evaluación, la manera de manejar posibles conflictos éticos y el valor que se le da a la evaluación misma.

Palabras clave: Cultura de evaluación, evaluación institucional, indicadores de evaluación.

Abstract:

]]> This article presents the results of a research study of the evaluation culture in five public institutions: high schools and higher education. An instrumental case study methodology was done with data from 30 representatives institutions. The results are presented around the three components of the evaluation culture: 1) how different educational actors understand the evaluation and, especially, the use of the institutional indicators; 2) the competencies that key people need in each institution in order to participate in the evaluation process; as well as the training they must receive to make an appropriate evaluation; and, 3) the underlying values that determine the use of the evaluation results, how to handle possible ethnic conflicts and the value that is given to the evaluation itself.Keywords: Culture of evaluation, institutional evaluation, evaluation indicators.

La evaluación persuade más que

convence, argumenta más que demuestra,

es más creíble que cierta,

la aceptación que suscita es más variable

que necesaria. Esto no significa

que la evaluación se reduzca a

mera oratoria o sea completamente ]]>

arbitraria. El hecho de que no se

limite al razonamiento deductivo e

inductivo no supone que sea irracional.

La racionalidad no equivale a la lógica

House, 1994: 2

"¿Para qué nos van a evaluar si no se hace nada con los resultados?", "¡otra evaluación más!; ¡qué manera de hacernos perder el tiempo!", "¿es anónima la encuesta o tenemos que poner nombre?", "¡ahora sí me voy a vengar del profesor!", "¿en realidad sí podré decir lo que pienso del director?", "el examen contenía muchas cosas que ni vimos en clase". Éstas y muchas otras expresiones más son frecuentes en los ambientes educativos y reflejan el pensar y el sentir de los distintos actores educativos (alumnos, profesores, personal administrativo, directivos, etc.), que forman parte de una comunidad educativa. A su vez, esas formas de pensar y de sentir se traducen en valoraciones que hacemos del mismo proceso de evaluación y en acciones que tomamos al diseñar el sistema de evaluación, implementarlo y usar sus resultados. Todo esto tiene que ver con el concepto de cultura de evaluación y sobre este concepto trata el presente artículo. Su objetivo es presentar los resultados de una investigación orientada a estudiar la cultura de evaluación en cinco instituciones públicas de educación media–superior y superior, en el marco de un proyecto de evaluación institucional.

Marco conceptual

El vocablo cultura tiene diversas connotaciones. Es un concepto complejo, polisémico y multidimensional. En el contexto de grupos, Rey y Santa María (2000) definen cultura como las relaciones entre personas, los acuerdos tácitos que establecen entre ellas y los valores subyacentes que los determinan. Johnson y Nissenbaum (1995) definen una cultura como una mezcla de tradiciones, creencias, valores, pensamientos, acciones y procesos cooperativos comunes de participación, para la creación de significados que conllevan a la caracterización de modos de vida y costumbres donde se valorizan el conocimiento y el desarrollo de un grupo social en determinada época y situación. Los elementos que abarca el concepto de cultura varían en número según el autor que se consulte, y en muchos casos, éstos se traslapan entre sí. Para los propósitos de este artículo, el término cultura puede quedar definido en términos de los elementos siguientes: formas de pensar y de sentir de los individuos que conforman al grupo, las relaciones que éstos mantienen entre sí, los acuerdos explícitos e implícitos que existen entre los miembros del grupo, aquellos factores de identidad (historia y tradiciones) que permiten que una persona se sienta identificada con el grupo, los valores subyacentes que definen las prioridades del grupo y el comportamiento individual y colectivo que se manifiesta en cada una de sus acciones.

]]> Muchas veces pensamos en el concepto de cultura en términos "macro": la cultura de un país, la cultura de un grupo indígena, la cultura de una región. El concepto, sin embargo, también se aplica en el contexto de grupos pequeños como pueden ser la cultura de un equipo de fútbol, la cultura dentro de un restaurante de comida rápida o la cultura dentro de una empresa. El tema de cultura organizacional ha sido abundantemente estudiado desde los enfoques de la administración de empresas y el comportamiento de las organizaciones (e.g., Chiavenato, 2004; y Morgan, 1998). Las instituciones educativas, como organizaciones que son, también han sido estudiadas desde distintas perspectivas, pero es claro que existen diferencias importantes entre una institución educativa y una organización con fines de lucro (Laval, 2004).En el marco de una organización escolar, la cultura se refiere a las creencias y convicciones básicas que mantienen los miembros de la comunidad educativa en relación con la enseñanza, el aprendizaje, la evaluación y, en general, con el funcionamiento institucional. Marchesi y Martín (1998) definen cultura como las relaciones (formales e informales) entre grupos, sus normas, procesos de enseñanza y aprendizaje, sistemas de comunicación y tipo de colaboración que se producen entre los actores del sistema educativo. Por su parte, Pérez Gómez (1998) señala que la institución educativa es un encuentro de culturas, una encrucijada que provoca tensiones, restricciones y contrastes en la construcción de significados.

Dentro de las muchas actividades que se realizan en una institución educativa, una que ocupa un lugar central (tanto para la institución como para este artículo) es la relativa a la evaluación educativa. Hay muchos tipos de evaluación educativa y se usa este término como el gran "paraguas" que cubre o incluye la evaluación del aprendizaje, la evaluación del proceso de enseñanza–aprendizaje, la evaluación curricular y la evaluación de las institución educativas, entre otras.

El concepto de evaluación puede estudiarse desde dos perspectivas. Una de ellas, atomista o analítica, considera que la evaluación debe realizarse a través del estudio de objetos concretos, como pueden ser el aprendizaje de los alumnos, los programas educativos, el currículo y las instituciones educativas (Elola y Toranzos, 2000). La otra de ellas, holística o sintética, parte del principio Gestalt de que el todo es más que la suma de las partes, y que un verdadero entendimiento de un sistema educativo ocurre cuando consideramos a todos los elementos que lo conforman de una manera integral (Valenzuela, 2004). Esta visión dual de la evaluación tiene implicaciones en cómo asumen este proceso los diferentes sujetos en una institución educativa. Por ejemplo, un profesor puede centrarse en la evaluación de los aprendizajes de sus estudiantes y un director de programa puede enfocarse al trabajo de una evaluación curricular; ambos sin considerar el trabajo que otros puedan estar realizando en el ámbito institucional (visión atomista). Cuando en la institución educativa priva una conciencia de lo que implica una visión holística de la evaluación, esa conciencia es el preludio de una cultura de evaluación.

Al respecto, Reyes (2006) señala que la evaluación no debe permanecer anclada en una concepción tradicional que persiga tan sólo la evaluación de resultados de los estudiantes y que se aísle del resto de los elementos del proceso de enseñanza–aprendizaje, para quedar relegada al momento final de dicho proceso. En el mismo sentido, Díaz Barriga y Pacheco (2007) apuntan que los sistemas educativos, las prácticas institucionales, las organizaciones y los procesos de aprendizaje constituyen algunos de los posibles referentes desde los cuales la problemática de la evaluación puede ser abordada. Por su parte, Dochy, Segers y Dierick (2002) destacan que las nuevas formas de concebir la educación exigen también nuevos criterios de evaluación, y la innovación educativa no es posible sin plantear importantes cambios en la evaluación.

El presente artículo se enfoca a la evaluación institucional, entendida ésta como aquella en la cual se determina la efectividad y eficiencia de una institución educativa, como centro de trabajo y como prestadora de servicios a la sociedad (Valenzuela, 2004). Son muchos los actores que intervienen en una evaluación institucional. Normalmente pensamos en el director como el principal responsable de la evaluación interna de la institución. Cuando de acreditación se habla, los procesos de autoevaluación con frecuencia son acompañados por una evaluación externa hecha por evaluadores de otras instituciones educativas (Gago, 2002). Y, dentro de cada institución también pensamos en distintas dependencias que generan información para procesos de evaluación y toma de decisiones: los responsables de los programas académicos, las áreas de registro escolar, las áreas administrativas y de finanzas, etc. Estos actores determinan la manera en que se conforma una cultura de evaluación en la institución.

No sólo en los alumnos, sino en cualquier persona, los procesos de evaluación generan temores. Más allá de verse expuestos por el resultado de una evaluación, los miedos se refieren también al impacto que puedan tener esas evaluaciones. Los profesores, personal administrativo, directivos y otros actores no son la excepción, y en más de una ocasión podemos apreciar ejemplos de situaciones en que ciertas iniciativas de evaluación son frenadas por dichos miedos (Conley y Glasman, 2008). La falta de control de estas emociones determina, en buena medida, la forma en que se constituye una cultura de evaluación en la institución.

Desde luego, en este proceso intervienen muchos más factores que meros temores personales. La cultura de evaluación se va conformando con la suma de experiencias pasadas, el uso de buenos y malos instrumentos de evaluación, las competencias e incompetencias de quienes realizan los procesos evaluativos, la madurez y formación que tengan los evaluadores y evaluados, y qué tan explícitos o implícitos son los criterios que se emplearán para generar juicios de valor y tomar decisiones. Esta cultura evaluativa es construida por cada actor en lo individual y en lo colectivo, ya que cada persona crea y recrea, a través de interpretaciones de situaciones específicas y a través de su comportamiento, el mundo en el que vive (Schein, 1992).

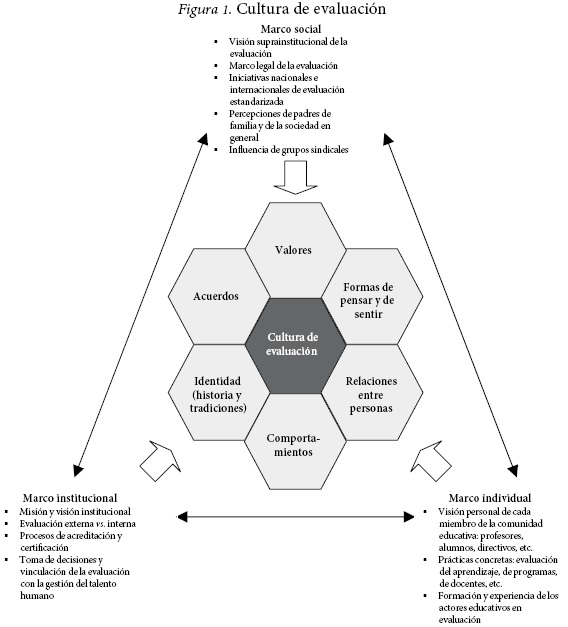

Una cultura de evaluación podría definirse, entonces, como el conjunto de valores, acuerdos, tradiciones, creencias y pensamientos que una comunidad educativa asigna a la acción de evaluación. Bolseguí y Fuguet (2006) señalan que la cultura de evaluación es un concepto en desarrollo que alude a la necesidad de evaluar de manera permanente. Para ellos, la evaluación es un proceso complejo y multidimensional que comprende distintos componentes: visión, valores, comportamientos, rutinas, contexto organizacional y social, experiencias pasadas y presentes, aspectos epistemológicos, teóricos y metodológicos. Desde luego, no siempre es fácil encontrar una visión unificada de lo que significa cultura de evaluación; los marcos sociales, institucionales y personales tienen una fuerte influencia en su configuración y en las concepciones sobre qué es la evaluación, cómo se lleva a cabo, qué usos se le puede dar, etc. A manera de representación gráfica de estos conceptos, la Fig. 1 muestra distintos elementos vinculados con el concepto de cultura de evaluación en contextos educativos.

]]>

Al hablar de cultura de evaluación es preciso distinguir entre una cultura existente y una cultura deseable (Bustelo, 2006). Cuando pensamos que en una institución se aprecia a la evaluación como "un mal necesario" o como "una carga burocrática", y cuando los comentarios que se escuchan entre los actores educativos tienden a menospreciar (justificada o injustificadamente) distintas iniciativas de evaluación interna o externa, todo esto nos refleja una cultura de evaluación que no necesariamente coincide con lo que muchos consideraríamos "ideal".

Por otra parte, al abordar el término cultura de evaluación es preciso también distinguir entre lo que sería una cultura explícita vs. una implícita de evaluación (Neirotti y Brown, 2001). En forma explícita, la cultura evaluativa se expresa a partir de elementos estructurales y formales (normas, reglamentos y procesos establecidos) que definen la libertad y la racionalidad de las acciones que ejecutan las personas en relación con la evaluación, pero a la vez los diferentes sujetos actuamos en una arena de poder signada por nuestros propios intereses (acción individual) y los de la institución (acción colectiva) (Vargas–Porras, 2001). Más aún, en ciertos casos la cultura se impone desde el currículo oficial, estableciendo en forma más o menos explícita las relaciones de poder dentro de la educación (Aboites, 1999). En contraste, aunque se reconozca la existencia de estos elementos, no siempre es posible inferir, a partir de conductas observadas, aquellos valores subyacentes en el grupo social que constituye a la comunidad educativa. Esas creencias, tradiciones y prácticas no siempre son homogéneas y es difícil identificar comunes denominadores que nos permitan precisar las características de una cultura de evaluación predominante en la organización. El hacer explícita una cultura de evaluación deseable para una institución no necesariamente garantiza que la cultura se vaya a desarrollar "por decreto". Reyes (2006) afirma que desarrollar una cultura de la evaluación no supone, exclusivamente, cambiar los métodos o instrumentos de evaluación sino, lo que es más importante, la filosofía que subyace en la misma.

El tema de cultura de evaluación ha sido estudiado empíricamente por diversos autores (e.g., Bolseguí y Fuguet, 2006; Rutty, 2003; y Vargas–Porras, 2001). A nivel "macro", destaca el trabajo de McAnally–Salas (2006), quien compara lo que ocurre en las instituciones de educación superior de los países desarrollados con lo que sucede en las naciones emergentes. En este mismo nivel, resulta interesante un estudio de la Dirección Nacional de Información y Evaluación de la Calidad Educativa del Ministerio de Educación (2009) de Argentina, que recupera la visión de funcionarios, supervisores y directores de escuelas de educación media sobre el tema de la evaluación con la intención de contribuir, por un lado, a enriquecer los marcos teóricos y metodológicos sobre el tema, y por otro, a presentar los debates más significativos que se están dando en el ámbito internacional en torno a la necesidad de generar una nueva cultura de la evaluación.

En el ámbito mexicano, en torno al Programa Integral de Fortalecimiento Institucional (PIFI), Nieto–Caraveo (2006) señala las dificultades, los riesgos y la complejidad de un proceso de cambio en donde las instituciones asuman una nueva cultura de planeación y evaluación institucional. El autor comenta que no es fácil cambiar el papel meramente instrumental que tiene la evaluación de premiar o castigar el logro de metas o de controlar el financiamiento. La relación entre la planeación, la evaluación y el financiamiento debe ser muy clara. Las dos primeras tienen un valor intrínseco en sí mismas, como procesos de construcción social y aprendizaje, además de sus funciones orientadoras sobre el quehacer universitario y de seguimiento de logros.

El tema de cultura de evaluación ha estado intrínsecamente vinculado con el de evaluación del desempeño docente (Ibarra, 2000; Tirado, 2003; Tirado, Miranda y Sánchez, 2007). Por ejemplo, Tirado (2003) afirma que existe una natural resistencia de la mayoría de los docentes hacia la evaluación, lo cual resulta comprensible, dado que es más cómodo y tranquilo no tener que rendir cuentas. El problema no es la creación o el actuar de ciertos organismos evaluadores, sino la evaluación y sus posibles consecuencias. Ante ello, hace falta generar una nueva cultura de la evaluación, lo que implica tener valores socialmente compartidos, dar cuenta de nuestras responsabilidades y afrontarlas; es decir, estar abiertos y promover que se evalúe el producto de nuestros compromisos. Por otra parte, en un estudio donde se recopilaron 26 mil 010 cuestionarios de evaluación de 1 mil 011 docentes, Tirado, Miranda y Sánchez (2007) destacan la importancia de legitimar la gestión institucional en las organizaciones educativas, tomando en cuenta que uno de los elementos estriba en el derecho de los alumnos a opinar sobre el desempeño docente de sus profesores. Los autores discuten el problema para trasparentar de manera continua y sistemática la expresión social de comunidades amplias, contribuyendo así a una cultura de la legitimidad en cuanto a la evaluación.

Dentro de este universo complejo al que se refiere la cultura de evaluación, este artículo tiene como objetivo explorar tres elementos de dicha cultura: 1) la forma en que los distintos actores educativos comprenden la evaluación y, en particular, el empleo de indicadores institucionales; 2) las competencias (muchas o pocas) que tienen ciertas personas clave dentro de cada institución para realizar procesos de evaluación, así como la capacitación que deben recibir para que la evaluación se lleve a cabo de una forma adecuada; y 3) los valores subyacentes que determinan el uso que se le da a los resultados de la evaluación, la manera de manejar posibles conflictos éticos y el valor que se le da a la evaluación misma.

Marco contextual

El estudio cuyos resultados se presentan en este artículo se circunscribe en el contexto de un proyecto más amplio que se llevó a cabo en el estado de Guanajuato. El nombre del proyecto fue "Modelo sistémico de evaluación institucional para el mejoramiento de la calidad educativa", el cual fue financiado por el Fondo Mixto de Fomento a la Investigación Científica y Tecnológica del Consejo Nacional de Ciencia y Tecnología (CONACyT) y del Gobierno del Estado de Guanajuato. Dicho proyecto partió del problema de identificar cuáles son las características que debe tener un modelo de evaluación que proporcione información a los cuadros directivos de una institución educativa para mejorar los procesos de toma de decisiones, la gestión de la institución y, eventualmente, la calidad del servicio educativo que ofrece. El problema así planteado llevó a los investigadores a proponer un proyecto consistente en tres etapas: 1) un diagnóstico de necesidades de evaluación institucional; 2) la propuesta y validación del modelo de evaluación institucional; y 3) la transferencia del modelo a través de procesos de formación de evaluadores. Como resultado fundamental de este proyecto se desarrolló un modelo de evaluación institucional compuesto por 54 indicadores agrupados en 10 categorías: formación integral y calidad, capital humano, capital social, investigación, consultoría, servicio social, promoción cultural, patrimonio físico, prestigio social y sustentabilidad económica.2 El presente artículo se desprende concretamente de la Etapa 3 del proyecto antes descrito, cuyo propósito fue promover la transferencia del modelo de evaluación institucional por medio de procesos de formación de evaluadores. Esto se hizo con cinco instituciones de educación media–superior y superior localizadas en cuatro localidades del estado de Guanajuato: Silao, León, Guanajuato y San Luis de la Paz.

]]> El título del curso fue "Competencias básicas para el evaluador institucional". Se impartió en la modalidad de e–learning, e implicó a los participantes una dedicación total de 40 horas. La oferta de este curso fue una forma de dar un valor agregado al proyecto, respondiendo a una necesidad manifestada por muchas instituciones: formar evaluadores institucionales en lo que implica la correcta aplicación del modelo propuesto.Para los investigadores, el objetivo del curso iba más allá de la mera formación de evaluadores; la idea era aprovechar la experiencia formativa para explorar el concepto de cultura de evaluación a través de poner en contacto a profesores y directivos en un ambiente distinto al institucional y que resultara menos "amenazador", como ocurrió en el curso de capacitación ofrecido.

El curso tuvo dos grandes grupos de actividades: uno orientado a ejecutar un proyecto de evaluación en la propia institución educativa a través de un conjunto de indicadores; y otro orientado a socializar las experiencias o vivencias que, como evaluadores institucionales, tuvieron en el proceso de evaluación.

En relación con la ejecución del proyecto de evaluación, los participantes tuvieron que responder a un conjunto de preguntas asociadas con algunos de los 54 indicadores que habían sido generados en el modelo de evaluación institucional. Las preguntas fueron: 1) ¿cuál es el valor del indicador en su institución educativa y cómo lo está calculando?; 2) ¿de qué otra forma se puede calcular este indicador? O, dicho de otra manera, ¿qué otra definición de ese indicador tendría mejor sentido para la situación particular de esta institución educativa que se está evaluando?; 3) ¿podría describir paso a paso el mecanismo (proceso) que seguiría usted en esta institución para generar el indicador solicitado?; 4) ¿qué dificultades (o posibilidades) vería usted para calcular este indicador de manera periódica? (pensando en el tiempo de obtención de datos, el costo de obtenerlos o la falta de personal que haga el trabajo, como posibles dificultades); 5) ¿qué tanto este indicador ha sido tomado en cuenta anteriormente en esta institución educativa y qué han hecho con él?; 6) ¿con qué frecuencia se debería calcular este indicador? O, dicho de otra manera, ¿cuál frecuencia sería la óptima?; 7) ¿qué personas o instancias (departamentos, áreas) dentro de la institución serían las indicadas para pasarle al director el valor de este indicador y qué tanto dichas personas o instancias ven actualmente esta tarea como parte de sus obligaciones?; 8) teniendo usted este indicador, ¿qué cosas cree que podría hacer para mejorar la institución a su cargo?; 9) ¿qué tanto considera que este indicador es importante y útil para el trabajo que desempeña como director?; y 10) ¿hay alguna observación adicional acerca de este indicador? Estas preguntas tuvieron el propósito de poner a prueba el modelo y validar su uso a partir de cuatro criterios: precisión, utilidad, factibilidad y ética. Los resultados de este proceso de validación se presentan en otras publicaciones, pero se menciona aquí el proceso porque fue la base para la actividad de aprendizaje cuyos resultados competen a este artículo.

En relación con las actividades de socialización de las experiencias o vivencias que, como evaluadores institucionales, tuvieron en el proceso de evaluación, los participantes trabajaron en tres foros de discusión asincrónica. No es posible hablar de cultura de evaluación en lo abstracto; es preciso haber vivido una experiencia de evaluación para comprender mejor los obstáculos y opiniones de las personas ante acciones evaluativas. Los participantes en este estudio tuvieron que determinar diversos indicadores institucionales y ello les permitió compartir sus vivencias en experiencias estructuradas que se diseñaron para tal fin. Las participaciones fueron agrupadas en tres temas congruentes con el propósito de este estudio: comprensión del uso de indicadores institucionales, competencias que los evaluadores deben tener y valores subyacentes en los distintos procesos evaluativos. Cada tema fue abordado por los participantes en el curso a lo largo de un periodo de una semana. La discusión se llevó a cabo en la modalidad de educación a distancia usando las herramientas para discusión asincrónica de que dispone la plataforma tecnológica Blackboard. A través de estos foros de discusión, los participantes tenían la oportunidad de compartir con sus compañeros sus propias experiencias durante el proceso de evaluación, así como aprender de las vivencias que los compañeros tuvieron.

Para fines de la investigación, toda la discusión giró en torno al tema de cultura de evaluación. Los mensajes en cada uno de los foros se convirtieron en un rico repositorio de información por ser analizada. La Fig. 2 muestra, en forma esquemática, las actividades que los participantes realizaron, así como los espacios que se tomaron como fuente de información para los propósitos de esta investigación.

Método

]]> Esta investigación fue realizada con un enfoque de estudio de casos instrumental (Stake, 1998). Por lo general, la investigación con estudio de casos consiste en referir una situación real tomada en su contexto y analizarla para ver cómo se manifiestan y evolucionan los fenómenos de un sistema social que tiene sus propias dinámicas. Yin (2002) la define como una investigación empírica que estudia un fenómeno contemporáneo en su contexto de vida real, en el que los límites entre el fenómeno y el contexto no son claramente evidentes y en el que se utilizan múltiples fuentes de información. Por su parte, Stake (1998) hace una distinción entre dos tipos de investigación de estudio de casos: intrínsecos e instrumentales. En un estudio intrínseco "El caso viene dado. No nos interesa porque con su estudio aprendamos sobre otros casos o sobre algún problema general, sino porque necesitamos aprender sobre ese caso particular. Tenemos un interés intrínseco en el caso" (Stake, 1998: 16). En un estudio instrumental...nos encontramos con una cuestión que

se debe investigar, una situación paradójica,

una necesidad de comprensión general,

y consideramos que podemos entender la

cuestión mediante el estudio de un caso

particular... Aquí el estudio de casos es un

instrumento para conseguir algo diferente

a la comprensión [de un caso] concreto

(Stake, 1998: 16–17).

Participantes. En este estudio podemos hablar de tres niveles de participantes. En un primer nivel se encuentran cinco instituciones educativas participantes en el curso de formación de evaluadores que se diseñó como parte de la Etapa 3 del proyecto. La selección de estas instituciones corresponde a un muestreo intencional hecho a partir del contacto que los investigadores tuvieron, en etapas previas, con 31 instituciones educativas del estado de Guanajuato. La elección de las cinco instituciones para la Etapa 3 se llevó a cabo con base en los criterios siguientes: diversidad geográfica, representación de los dos niveles educativos (educación media–superior y superior), interés de las instituciones por participar en cada una de las tres etapas del proyecto, y que tuvieran un tamaño superior a los 500 estudiantes.

En un segundo nivel se encuentran los representantes de las instituciones educativas que participaron en el curso al que se les convocó. Fueron seis personas invitadas por cada institución: un director y cinco personas clave dentro de la institución educativa. La designación de esas personas clave no estuvo bajo el control de los investigadores, sino que dependió de los directores. La sugerencia que se le hizo a estos últimos fue que eligieran a personas comprometidas con sus instituciones, que actualmente realizaran procesos de evaluación (o potencialmente los fueran a realizar) y que tuvieran disponibilidad para llevar a cabo las 40 horas de capacitación que duraba el curso.

En un tercer nivel se encuentran las contribuciones que fueron generadas en las actividades de socialización de vivencias mediante tres foros de discusión sobre el tema de cultura de evaluación. En este punto, los "participantes" no son instituciones o personas, sino todos aquellos mensajes que fueron colocados en los foros de discusión, y que constituyen la unidad de análisis del presente proyecto.

Instrumentos. El proceso de colección de datos estuvo alineado con las actividades del curso de capacitación, en particular aquéllas vinculadas a los foros de discusión que se abrieron en torno a la cultura de evaluación. Cada foro sirvió para que los participantes compartieran sus experiencias en procesos de evaluación, a la vez que permitieron que los facilitadores del curso (e investigadores en este estudio) intervinieran solicitando explicaciones adicionales que clarificaran cada vivencia y que permitieran recabar información rica para su análisis posterior. Congruente con los objetivos de investigación (y del curso de capacitación mismo), fueron tres los temas que se abordaron:

1. Comprensión de los indicadores: su propósito fue discutir sobre las dificultades que los evaluadores encontraron en las instituciones educativas respecto a la forma en que los directivos encuestados comprendían los indicadores. Las preguntas detonadoras para este foro fueron: a) ¿qué dificultades tienen las personas entrevistadas para comprender los indicadores?; ¿ustedes, como evaluadores, tratan de clarificar el significado de los indicadores?; y ¿creen que las personas a cargo de la institución tienen claridad al momento de definir los indicadores?

2. Competencias del evaluador: su propósito fue hacer una autoevaluación sobre el tipo de competencias que esta tarea requiere y sobre el grado en que los evaluadores (los alumnos participantes en el curso) poseían esas competencias. Las preguntas detonadoras para este foro fueron:¿cuáles competencias se ponen en juego para el trabajo de campo que están realizando?; ¿cómo se siente usted en esas competencias?; ¿en cuáles se siente fuerte y en cuáles cree que no está capacitado?; y ¿qué capacitación cree que les hace falta a los responsables de la evaluación en la institución para que, como parte de su diario quehacer, puedan ellos cumplir con este tipo de funciones?

3. Valores subyacentes en los procesos de evaluación: muchas veces se observa en las instituciones educativas que la evaluación es, para algunos, algo "secundario", al mismo tiempo que otras personas desconfían sobre el uso que se le pueda dar a los resultados de la evaluación; por ello, el propósito de este foro fue hacer una reflexión sobre los valores subyacentes en la cultura de evaluación existente (o inexistente) en las instituciones que los participantes estaban evaluando. Las preguntas de–tonadoras para este foro fueron: ¿por qué cree que hay, o no, una cultura de evaluación en la institución que está evaluando?; ¿qué valor se le da a las acciones de evaluación dentro de la institución?; ¿estos valores se hacen explícitos o están implícitos en las acciones del personal dentro de la institución?; en la determinación de los indicadores ¿se ha enfrentado a algún dilema ético o a un conflicto de intereses?; y ¿cree que hay algún indicador que por su naturaleza puede llegar a tener implicaciones "polémicas" en cuanto a su uso y/o interpretación?

Los instrumentos, entendidos como los medios que usa un investigador para colectar datos, fueron en este caso los foros de discusión asincrónica descritos previamente. Aunque las preguntas detonadoras sirvieron de base para motivar la discusión inicial, conviene señalar que la discusión que se dio en cada foro sucedió de manera natural y espontánea. Congruente con una metodología cualitativa, los investigadores tomaron la decisión de que esto ocurriera así con el fin de que los datos fueran fluyendo libremente sin mayor influencia por parte de los investigadores. Sólo en aquellos casos en que alguna participación ameritaba una mejor explicación, los investigadores, en su papel de facilitadores del curso, recurrieron a un conjunto de preguntas que sirvieran para validar la información recabada y asegurar que realmente se estaba entendiendo el pensar y sentir de los participantes en su papel de evaluadores.

]]> Análisis de datos. Para llevar a cabo el análisis de los datos que aportaron los participantes en los foros de discusión, se empleó la técnica de análisis de contenido, con dos tipos de elementos estructurales: referencias y rasgos (Bardín, 2004). Las referencias se dieron a partir de las opiniones, respuestas y relatos que los participantes hicieron sobre el sentido que ha tenido y tiene para ellos la cultura de evaluación; en tanto que, como rasgos, se consideraron las incidencias o frecuencias que resultaron significativas en dichos relatos.Por otra parte, el análisis de contenido establece un vínculo entre tres tipos de lenguaje: descriptivo, analítico e interpretativo (Krippendorf, 1990). En este estudio, el nivel descriptivo incluyó la información aportada por los informantes en los tres foros de discusión; el nivel analítico ordenó dichos aportes a partir de criterios de afinidad o diferenciación, constituyendo categorías para clasificar y organizar la información; y el nivel interpretativo generó juicios de valor sobre el fenómeno de interés para su mejor comprensión.

Resultados

Los resultados se presentan en esta sección a partir de un análisis de contenido de los mensajes plasmados en los foros de discusión, agrupados en tres categorías: comprensión de los indicadores, competencias del evaluador y valores subyacentes en los procesos de evaluación.

Comprensión de los indicadores. El primer foro trató sobre las dificultades que los evaluadores encontraron en las instituciones educativas respecto a la forma en que los distintos actores comprenden el concepto de indicador. Uno de los puntos de discusión estuvo en referencia al entendimiento de los indicadores por parte de los informantes, como una función de la formación académica de éstos, pero también de la terminología empleada por los encargados de recabar la información. Las experiencias compartidas apuntan a que a mayor nivel académico del informante, mayor entendimiento del indicador; y a mayor claridad por parte de los evaluadores para comunicar la información que querían colectar, mayor facilidad para determinar el valor del indicador.

Complementando lo anterior, otro punto que se abordó tuvo que ver con el perfil de informantes y evaluadores, no sólo en términos de su experiencia en temas de evaluación institucional, sino también en términos de su perfil profesional. En educación media–superior y superior (niveles en que se llevó a cabo el estudio), muchos de los docentes y directivos carecen de formación pedagógica y, por consiguiente, de una capacitación específica sobre evaluación institucional. No es inusual encontrar en cargos directivos a ingenieros, administradores, médicos o abogados con competencias pedagógicas más de naturaleza empírica (por la experiencia), que de naturaleza teórica. Desde luego, el concepto de indicador no es del todo ajeno a estas profesiones, y en muchos casos se apreciaba el ejercicio de procesos de transferencia para tratar de entender a qué se refería un indicador de evaluación institucional, desde la perspectiva desde la cual cada quien lo había manejado en su esfera profesional.

Aunque capacitación y competencias fue un tema discutido en otro foro posterior a éste que aquí se discute, se comentaron ampliamente el pensar y sentir de los participantes sobre sus competencias como evaluadores y como responsables de colectar información. Recuérdese que previo a la discusión en foros asincrónicos, los participantes debieron acudir con distintos informantes de la institución en que trabajaban para recabar información sobre un conjunto de indicadores dado por un modelo propuesto por los autores de este artículo. Al asumir esta tarea, los participantes reconocieron ciertas limitaciones en sus habilidades para entrevistar a los informantes, para entender ellos mismos el significado de cada indicador y, por consiguiente, para comunicarles a los informantes el tipo de datos que el indicador requería. Por ello, un punto recurrente en esta discusión fue el de destacar la importancia de la formación de evaluadores para ellos mismos y para personas clave dentro de cada institución.

Una cosa es la competencia que pueda traer de entrada un evaluador, y otra muy distinta es la preparación que haya hecho para realizar el estudio. Uno de los puntos que fueron abordados en este foro se orientó a la importancia de planear adecuadamente cada entrevista o proceso de colección de datos. Los participantes en el curso pronto se dieron cuenta de que no podían llegar con la máxima autoridad de una institución educativa para que ésta proporcionara todos y cada uno de los datos que requería cada uno de los 54 indicadores del modelo de evaluación: mientras que algunas preguntas podían ser respondidas con mayor precisión por directores de escuela, otras correspondían más a jefes de departamento. De igual forma, los responsables de servicios escolares podían proporcionar ciertos datos, así como lo hacían los encargados de las áreas administrativas. Cada una de estas personas tiene un perfil distinto y era fundamental que los evaluadores realizaran una preparación previa de sus entrevistas para seleccionar, en primer lugar, qué persona respondería a qué indicador; y en segundo lugar, para adecuar el lenguaje al perfil de cada informante. Sin importar qué tan competente es un evaluador, la adecuada planeación del proceso de colección de datos pareció ser un factor clave para asegurar un entendimiento común del concepto de cada indicador y para colectar los datos que permitieran determinarlo.

No es posible generalizar acerca del mucho o poco entendimiento que cada persona (informante o evaluador) o institución tuvo sobre el concepto de indicador. En muchos casos, ciertos indicadores les eran muy familiares a los informantes porque son frecuentemente solicitados por instancias superiores. Así, reportar un índice de deserción o un promedio de la evaluación del desempeño de los profesores son tareas frecuentes en las instituciones educativas. A pesar de ello, los participantes (evaluadores) observaron cierta dificultad al plantear preguntas que buscaran justificar el cálculo de ciertos indicadores. Algo tan "simple" como un índice de deserción podía resultar tremendamente complejo si se cuestionaban aspectos tales como su determinación a través del seguimiento de cohortes o a través de cortes transversales en cada semestre (entre muchos otros procedimientos que se podrían citar). Los participantes reportaron que una supuesta comprensión de algún indicador no era tal cuando se realizaba este tipo de cuestionamientos. Ni qué decir cuando se planteaban indicadores que jamás habían sido siquiera considerados por los informantes; ejemplo de ello eran aquéllos sobre capital social y sobre la importancia que tienen las redes en el trabajo académico de los profesores. En esos casos, muchos informantes reconocieron que jamás habían recibido solicitudes para reportar dichos indicadores, y mostraron interés por tratar de comprenderlos mejor.

]]> Otra línea de discusión se dio en el caso de algunos participantes que, además de trabajar en escuelas públicas, llegaron a colaborar también en instituciones privadas. Se señalaba, por ejemplo, que ciertos tipos de indicadores eran más frecuentemente empleados en instituciones privadas, dada una práctica habitual de rendición de cuentas. Aunado a lo anterior, muchas de estas instituciones buscan ser acreditadas como una forma de posicionarse en el mercado educativo y, por consiguiente, se ven sujetas a la determinación de aquellos indicadores solicitados por los organismos acredita–dores. Estas prácticas aparentemente facilitan la comprensión de ciertos indicadores. El contraste entre instituciones públicas y privadas puede explicarse, de acuerdo con Cardozo (2009), por el limitado desarrollo de la cultura evaluativa en la administración pública mexicana durante el siglo pasado, y los pocos trabajos publicados para analizar dicha situación.Capacitación de los evaluadores. El segundo foro trató sobre el tipo de competencias que un proceso de evaluación institucional requiere y sobre el grado en que los evaluadores (los alumnos participantes en el curso) y los informantes en cada institución poseen esas competencias.

En primera instancia, los participantes en el foro reflexionaron acerca del concepto mismo de competencia. Mientras que algunos mencionaron que no estaban seguros del significado de este término, otros lo definieron desde su punto de vista y otros más incluyeron citas de autores diversos. Tal como ocurre siempre que se habla de competencias, el término elude una definición precisa y lo mismo puede abarcar un conjunto de conocimientos, habilidades y actitudes (lo que sería una definición amplia del término), hasta acotarlo simplemente a aquellas habilidades que le permiten a alguien hacer algo (definición restringida del término). Asimismo, al hablar de competencias surgió en el foro el contraste entre demostrar competencias a través del desempeño diario vs. ver a la competencia como un "potencial" para hacer algo. Quienes apuntaban a la segunda idea argumentaban que no hay que confundir competencia con desempeño, y que no siempre una persona competente quiere o cuenta con un contexto tal que le permita llevar al terreno de la práctica aquello que sabe hacer. Esta línea de discusión fue relevante para entender el concepto de cultura de evaluación, ya que en muchas ocasiones se atribuye la "poca" cultura de evaluación a malas experiencias previas debidas a la supuesta incompetencia de los evaluadores.

En relación con la experiencia que los participantes tuvieron como evaluadores, se comentó que las competencias para realizar este tipo de trabajo se ponen en juego en todas y cada una de las actividades que tuvieron que realizar en el trabajo de campo: planeación de actividades, procesos de recolección de datos, análisis de información y comunicación de los resultados, entre otras. Los listados sobre situaciones de evaluación fueron variados, y en no pocas ocasiones se entraba a cierto detalle para profundizar sobre competencias muy concretas que algunos tuvieron que emplear; por ejemplo, en la selección adecuada de las fuentes de información, en la logística involucrada para programar las entrevistas, en el empleo de algún paquete estadístico para procesar datos o hasta en la elaboración de un informe ejecutivo o de una presentación en Power Point para comunicar los resultados. Procurando un ejercicio de síntesis, hay quienes identificaron al menos tres dimensiones o categorías de competencias que son indispensables para poder conducir un buen trabajo de evaluación institucional: 1) competencias del área teórica y conceptual (planeación, métodos de recolección de datos, desarrollo de instrumentos, análisis de información, etc.); 2) competencias del área de habilidades interpersonales y de comunicación oral y escrita; y 3) competencias del área de ética (para realizar evaluaciones con apego al respeto absoluto de las personas y para el manejo de conflictos de intereses).

Un aspecto que a los participantes les pareció importante, y que incluso generó un cuestionamiento acerca de si pudiera o no considerarse como una competencia, fue el conocimiento previo de los evaluadores acerca de aquello que se quiere evaluar. Se comentó que si un evaluador no está familiarizado con el objeto de la evaluación, el mismo evaluador tiende a divagar y puede incluso generar dificultades para conseguir el valor de un indicador o para ayudar a personas clave de la institución para determinarlo. Esto se hizo patente cuando los participantes, muchos de ellos profesores en ejercicio, solicitaban información sobre cuestiones que les eran ajenas, como podría ser un informe contable o un inventario de recursos materiales de la institución. La evaluación institucional es algo complejo y exige conocimientos de muy diversas áreas disciplinares, razón por la que es difícil para un evaluador llegar a dominar cada una de ellas.

Otra línea de discusión fue la de ver el proceso de evaluación como algo más que un mero acto mecánico. Teoría y experiencia práctica son dos requisitos importantes que con frecuencia se vinculan con las competencias del evaluador; pero también se habló de la importancia de ser creativo en la realización de cada tarea, al grado de ver el proceso de evaluación como un arte y no sólo como una técnica. En este sentido, mucho se habló sobre la conciencia que debe tener el evaluador del entorno donde realiza la evaluación, de la sensibilidad requerida para conseguir cierta información dependiendo de la forma de ser de cada informante, y hasta de la intuición que el evaluador debe poseer para identificar situaciones atípicas que pudieran pasar desapercibidas. Mientras que algunos afirmaban que todo esto caracteriza al evaluador competente, otros opinaban que las competencias se quedaban cortas respecto de lo que significa ser un evaluador eficaz.

El contenido de las aportaciones de los participantes se refirió en no pocas ocasiones hacia el reconocimiento de que los procesos de evaluación son indispensables y deben llevarse a cabo como una práctica continua dentro de las instituciones educativas. Esto llevó también a destacar la necesidad del desarrollo del talento humano en las instituciones educativas, para llevar a cabo procesos de evaluación al interior de éstas. Las competencias son algo que tarda en desarrollarse, y más que dejar que éstas se desarrollen en forma "espontánea", se habló mucho de la importancia de contar con cursos de capacitación que permitieran el desarrollo de esas competencias en forma sistemática.

Muchos profesores, y otros actores dentro de las instituciones educativas, reconocen que pocas veces (o tal vez nunca) llevaron cursos sobre evaluación institucional. A pesar de reconocer esta carencia, los participantes argumentaron que ellos anticiparían ciertas reticencias por parte del personal a ser capacitados, por lo que pudiera implicarles más adelante, en sus trabajos, tener que realizar procesos de evaluación dentro de sus áreas de influencia.

Al realizar una autoevaluación sobre sus propias competencias, varios patrones fueron identificados. Un patrón recurrente fue el de señalar el desconocimiento de herramientas estadísticas para el manejo cuantitativo de datos. Aunado a esto, algunos señalaban también un gran desconocimiento de herramientas tecnológicas que les permitieran procesar datos o, incluso, facilitar los procesos de difusión de los resultados. Hay quienes han oído hablar de herramientas como SPSS, pero ignoran totalmente su funcionamiento; hay quienes ni siquiera conocen el nombre de software especializado para el análisis cualitativo de datos; y hay quienes conocen un poco de herramientas tales como Power Point, pero que al mismo tiempo reconocen que las subu–tilizan. Otro caso recurrente fue el relativo al desarrollo de instrumentos de medición: mientras que a algunos les puede parecer relativamente "simple" desarrollar un cuestionario con las preguntas que les puedan venir a su mente, otros reconocen que requieren mucho más sustento teórico para proponer instrumentos que realmente aporten información que sea válida y confiable en el cálculo de indicadores institucionales.

En contraste, en esta autoevaluación de competencias muchos coincidieron en que su formación como docentes constituía un factor fundamental al momento de entablar relaciones con autoridades e informantes de las instituciones educativas. Hay cierto tipo de inteligencia interpersonal que les facilita comunicarse con personas clave y obtener información de ellas. De igual manera, aun cuando pudieran tener limitaciones para generar informes con el uso de recursos tecnológicos, muchos de los participantes afirmaban sentirse competentes para procesos de comunicación de resultados.

]]> En este ejercicio de autoevaluación, un tipo de competencia que generó debate entre los participantes fue el relativo al manejo de los tiempos. Mientras que algunos sintieron que llevaban buen control del tiempo en el manejo de entrevistas, otros reportaron deficiencias en esta área. Y lo mismo ocurría en un nivel logístico, cuando los participantes debían compaginar las agendas propias con las de los directivos que iban a entrevistar o las de los informantes a quienes les aplicarían instrumentos. Experiencias como cambios en la agenda y cancelaciones de citas por parte de los directivos generaron, en no pocas ocasiones, cierto estrés en los participantes, que tenían fechas límite que cumplir para reportar avances en el curso.Si bien la discusión sobre competencias y capacitación giró primordialmente en torno a cuestiones técnicas u operacionales de la evaluación, en algunos momentos también se sugirió que la formación de los evaluadores abarcara el desarrollo de competencias de otra índole. Por ejemplo, se dijo que un evaluador competente debe ser capaz de: comprender la relevancia del contexto de cada institución en los procesos de evaluación; tener un entendimiento profundo de los marcos teóricos que rigen a la evaluación institucional desde distintas perspectivas; y tener una conciencia clara acerca de las virtudes y defectos, y alcances y limitaciones, de distintas perspectivas metodológicas.

Tal como se anticipaba, el tema de las competencias de un evaluador desembocó en el tema de una cultura de evaluación. Un tema abordado en este foro fue el de los miedos que genera una evaluación institucional entre los distintos actores educativos y cómo esos miedos no son más que el producto de un enorme desconocimiento sobre la evaluación misma y sobre el impacto que ésta puede tener para mejorar a la institución. De nada sirve que evaluadores expertos traten de "convencer" al personal de una institución acerca del valor de una evaluación; si no se comprenden los procesos vinculados a una evaluación, difícilmente se valorará ésta. Incluso, la reacción que a veces se anticipa es la de sabotear los trabajos de evaluación en aras de evitar "persecuciones" y consecuencias indeseables que se deriven de los resultados de esas evaluaciones. El argumento que prevaleció en esta discusión fue que una cultura que realmente propicie una evaluación sana de las instituciones educativas se lograría capacitando a todos los actores al parejo: lo mismo a aquellos a cargo de un proceso de evaluación, que a quienes simplemente actúan como informantes.

Finalmente, para los participantes en el curso el trabajo desarrollado en la plataforma electrónica evidenció el hecho de que compartir experiencias con sus compañeros les significó un enorme aprendizaje. Al estar viviendo ellos un proceso de capacitación, podían valorar más la importancia de ésta y destacar el impacto que tendría en la institución el que este esfuerzo de capacitación se extendiera a todos los niveles. Estos hallazgos coinciden con los de Rutty (2003), cuando señala que un discurso recurrente de agentes capacitadores es la falta de una "cultura de la evaluación" como requisito previo para el establecimiento de prácticas de evaluación de impacto de programa de capacitación.

Valores subyacentes en los procesos de evaluación. El tercer foro tuvo por objetivo reflexionar sobre los valores subyacentes en la cultura de evaluación existente (o inexistente) en las instituciones que los participantes estaban evaluando.

El tema de la evaluación, en sí mismo, sigue resultando polémico entre los actores educativos. Su sola mención genera tensiones y desconfianza. Este sentir se manifestó en los datos que emergieron del análisis de las respuestas en este foro, donde los participantes comentaron que muchas personas son recelosas sobre el uso que se le pueda dar a los resultados de la evaluación. El temor de que una persona ajena a nuestro diario quehacer pueda emitir un juicio de valor acerca de nuestro propio desempeño, en una labor cualquiera, fue considerado por la mayoría de los participantes como el gran obstáculo a vencer para lograr implantar una cultura de evaluación a nivel institucional y nacional.

Sin embargo, los participantes también coincidieron en la idea de que, para trabajar en pro de una cultura de evaluación, se deberían vencer los intereses de todo tipo que se oponen a la implementación de los sistemas de evaluación. Se comentó que la cultura de la evaluación va más allá de los exámenes que presentan los alumnos para obtener una calificación, de las encuestas que se llevan a cabo para determinar el clima laboral o de los instrumentos para valorar el desempeño de los profesores. Se trata de trabajar en procesos sistemáticos que lleven a elevar el nivel educativo de los estudiantes. Cuando la evaluación se aprecia como un medio y no como un fin, se está realmente promoviendo una cultura de evaluación. El valor subyacente de la evaluación no está tanto en la calidad de los procesos (que es importante, sin duda), sino en verla como un medio para mejorar la calidad académica de los estudiantes.

Aun reconociendo el valor que tiene la evaluación en los procesos institucionales, se comentó que para muchas escuelas públicas (salvo contadas excepciones), la cultura de evaluación simplemente es inexistente. Una razón de esto radica en la "seguridad" que el personal tiene de la permanencia en su puesto. El puesto de trabajo no se siente "amenazado" porque buen número de profesores, personal administrativo y directivos tiene un nombramiento "de planta" (de base) que establece una relativa permanencia de la persona dentro de la institución. Otra razón radica en que los directivos de dichas instituciones en muchos casos no consideran necesario llevar a cabo procesos propios de evaluación porque existen instancias superiores que los realizan en forma independiente de la institución (por ejemplo, la aplicación de las pruebas del Centro Nacional de Evaluación, CENEVAL, como una forma de política generalizada para distintas instituciones).

Situación contraria se pudo apreciar cuando los participantes citaban sus experiencias dentro de instituciones privadas. En éstas, los procesos de evaluación son cuestiones casi de rutina. Se valora la competencia entre los distintos centros educativos, en especial cuando se refieren a cuestiones académicas. El hecho de contar con el visto bueno de un organismo acreditador, o el hecho de que los egresados logren un puntaje alto en las pruebas del CENEVAL, son elementos de juicio que las instituciones emplean para promoverse y para captar una mayor cantidad de alumnos de cierto nivel. A través de este tipo de evaluaciones, las instituciones demuestran que pueden ofrecer un mejor servicio educativo para sus "clientes", quienes están en posición de buscar la mejor opción que responda por el dinero que están pagando.

Por otra parte, cuando se abordó la temática sobre posibles dilemas éticos o conflictos de intereses en prácticas evaluativas, hubo una clara manifestación de dos posturas. Por una parte, algunos participantes llegaron a la conclusión de que el simple hecho de llevar a cabo una evaluación conlleva una responsabilidad ética, que debe estar presente tanto en los juicios de valor que se emiten, en el manejo confidencial de información, o en las consecuencias que se derivan de sus resultados. En contraste, muchos de estos mismos participantes también manifestaron que la determinación de indicadores no les implicó, en realidad, mayor conflicto ético. Cuando el evaluador es visto como un profesional técnico, encargado de recabar información y ordenarla, sin emitir juicios de valor sobre ésta, los conflictos éticos son prácticamente inexistentes y se "transfieren" más bien a quienes deben interpretar los resultados de la evaluación y tomar decisiones a partir de ellos.

]]> Adicionalmente, en este foro se discutió sobre la naturaleza "polémica" que pueden tener ciertos indicadores, dada la forma en que se les puede interpretar o el uso que se les puede dar. Numerosos ejemplos fueron comentados sobre este tema.Un ejemplo de un indicador que resultó polémico por su interpretación fue el que calculaba el "índice de mejora del nivel de calidad de vida de los trabajadores en función de su retribución económica". El consenso general fue que se trataba de un indicador difícil de medir. Se cuestionó quién debería ser el informante: el profesor o los directivos. Se discutió también el significado de "calidad de vida", sus implicaciones, la forma de medirlo y sus repercusiones, para poder llegar a una conclusión.

Ejemplos de indicadores que resultaron polémicos por el uso que se les puede dar fueron los de naturaleza económico–administrativa. Siempre resulta delicado el manejo de los recursos con que cuenta la institución y la asignación de partidas presupuestales a las distintas áreas; por ello, para muchos evaluadores fue difícil encontrar datos vinculados a este tipo de indicadores. Un común denominador que se mencionó es el relativo al recelo y desconfianza de ciertos directivos (informantes) sobre las razones por las que se les solicitó este tipo de información.

El tema del currículo generó también una serie de comentarios polémicos entre los participantes. Un indicador, por ejemplo, señalaba el "grado de cumplimiento de lo establecido en los currículos, en términos del número de temas que se abordaron y que se debieron haber abordado en clase". Partiendo del hecho de que los profesores tienen libertad de cátedra, la discusión se centró en cuestionar la relativa flexibilidad que los profesores pueden tener al poner mayor énfasis en ciertos temas y no en otros; y ello llevó a cuestionar la forma de determinar dicho indicador y el hecho de que un mayor "grado" de cumplimiento significara realmente algo "positivo" en términos educativos.

Otro indicador discutido fue el de las calificaciones de los alumnos. Una idea que generó amplia discusión en el foro se refirió a las estadísticas de calificaciones obtenidas por los alumnos, como una supuesta forma de medir la calidad de la institución o el desempeño de los profesores: ¿calificaciones más altas significan mayor aprendizaje o profesores más laxos? La polémica también se dirigió hacia la diferencia entre calificar y evaluar, dado que los indicadores solicitados ponían más énfasis en generar estadísticas de calificaciones que en interpretaciones más profundas sobre el significado que tiene cada número. Se comentó que las calificaciones de los alumnos, desde el punto de vista de la mayoría de los participantes, son un parámetro cuestionable para determinar el nivel de mejora de la calidad en una institución.

En contraste con los ejemplos anteriores, los participantes encontraron consensos en el valor de otros indicadores aparentemente libres de polémica. Los indicadores referidos a presupuesto fueron considerados como fundamentales, puesto que el manejo y disposición de recursos destinados a infraestructura posibilita un trabajo apto en la institución para garantizar el servicio de calidad requerido por los estudiantes. Igualmente, los indicadores referidos a capital humano, formación integral y capacitación representan un referente de la calidad del servicio que presta una institución educativa. El indicador de egresados insertos en los sectores laborales también fue tema de discusión dentro del foro, ya que se consideró que si un alumno obtenía una educación de calidad al estudiar en cierta institución, el ingreso rápido y permanencia, con herramientas necesarias para la vida económicamente productiva, podría considerarse como un indicador de las competencias adquiridas como parte de su formación profesional y, por tanto, de un nivel de calidad de la institución donde desarrolló dicha formación.

Conclusiones

Acorde con el objetivo de la investigación, tres han sido los temas vinculados al de cultura de evaluación que fueron explorados en este estudio: 1) la forma en que los distintos actores educativos comprenden la evaluación y, en particular, el empleo de indicadores institucionales; 2) las competencias (muchas o pocas) que tienen ciertas personas clave dentro de cada institución para realizar procesos de evaluación, así como la capacitación que deben recibir para que la evaluación se lleve a cabo de una forma adecuada; y 3) los valores subyacentes que determinan el uso que se le da a los resultados de la evaluación, la manera de manejar posibles conflictos éticos y el valor que se le da a la evaluación misma.

Una de las características fundamentales de una cultura radica en el entendimiento común que guardan todos los miembros de una comunidad sobre cuestiones que son de su interés. La discusión del primer punto nos ha llevado a observar cierta heterogeneidad que existe entre los miembros de las comunidades educativas para entender conceptos tales como evaluación institucional o indicadores de evaluación. De esta investigación se aprendió que, aparentemente, a mayor nivel académico del informante, mayor entendimiento del indicador; y a mayor claridad por parte de los evaluadores para comunicar la información que querían recolectar, mayor facilidad para determinar el valor del indicador. Sin duda, para algunos indicadores hay una idea clara sobre su significado, pero para muchos otros hay múltiples interpretaciones sobre la forma de determinarlos y sobre el uso que se le puede dar a la información que generan. Lo anterior no es fortuito. La ausencia de una cultura de evaluación es el resultado de prácticas evaluativas dispersas que ponen más énfasis en la práctica misma que en el entendimiento común de lo que se quiere hacer. Un cambio en la cultura de evaluación de las instituciones debe iniciar buscando un entendimiento común y un significado compartido (Pérez Gómez, 1998; y Tirado, 2003). La pluralidad no está reñida con esto. Siempre pueden existir cuestionamientos sobre la mejor forma de medir tal o cual indicador. Lo importante es que, una vez que se determine esa mejor forma, los miembros de la comunidad se apropien de ésta para avanzar juntos en una misma dirección.

]]> Otra de las características de una cultura radica en la manera en que las generaciones adultas transmiten a las jóvenes las creencias, prácticas y todo aquello que es valorado por la comunidad a la que pertenecen para operar y vivir en armonía dentro de ella. Esa transmisión a veces ocurre de manera inconsciente y a veces se da a través de procesos formales de formación. Al hablar de cultura de evaluación en instituciones educativas, los procesos de formación parecen estar ausentes. Desde luego que las evaluaciones se realizan y los mandos superiores dan instrucciones al personal operativo sobre cómo determinar ciertos indicadores o cómo aplicar diversos instrumentos; pero el hecho de dar esas instrucciones está lejos de lo que implica un auténtico proceso formativo. Con esta investigación se aprendió que es raro encontrar en las instituciones educativas cursos orientados a formar evaluadores y a desarrollar las competencias que un trabajo de evaluación institucional requiere. Un cambio en la cultura de evaluación de las instituciones debe contemplar la implementación de cursos de evaluación en todos los niveles, involucrando no sólo a los evaluadores, sino también a los informantes. La formación de evaluadores debe abarcar desde conceptos y marcos teóricos para comprender los alcances y limitaciones de cada metodología, hasta el desarrollo de cierta inteligencia interpersonal para tratar con los informantes; desde el conocimiento de normas éticas para realizar evaluaciones con apego al respeto absoluto de las personas, hasta el desarrollo de un pensamiento lateral que permita realizar evaluaciones apropiadas a cada contexto; desde estrategias para la eficaz gestión de proyectos, hasta el uso de toda una variedad de recursos informáticos para el análisis de datos cuantitativos y cualitativos. El conocimiento de todo esto reduce los miedos que genera la incertidumbre, y un mejor conocimiento de los procesos de evaluación lleva como consecuencia menores miedos y menores objeciones al realizarla (Conley y Glasman, 2008).En toda cultura hay valores subyacentes. Los miembros de la comunidad comparten preferencias que les permiten distinguir aquello que es relevante para el grupo respecto de lo que no lo es. Al hablar de cultura de evaluación en instituciones educativas no es fácil identificar los valores subyacentes; por lo general, el discurso destaca la importancia de la evaluación, pero las prácticas y las actitudes de las personas no siempre son congruentes con ese discurso. La evaluación provoca miedos y reticencias. Un ambiente de incertidumbre parece privar siempre que se realiza una evaluación donde no siempre se hace explícito el uso que se le va a dar a los resultados. Por ello, el anonimato se puede valorar, aunque posteriormente se le critique por la falta de transparencia. De esta investigación se aprendió que una buena forma de identificar valores subyacentes es estudiando las razones por las que los conflictos surgen al momento de evaluar. Un conflicto contrapone el sistema axiológico de una persona con el de la otra, y esto se manifiesta por el énfasis que cada quien le da a ciertas cosas. Puede haber polémica sobre la forma de construir ciertos indicadores (cómo se calculan), sobre el uso que se le va a dar a la información que resulte de calcular esos indicadores (qué consecuencias se desprenden de la evaluación) o sobre la forma de interpretarlos (qué es bueno y qué es malo). Si bien la polémica surge de "defender" aquello en lo que creemos (aquello que valoramos), otro aprendizaje que resultó de esta investigación fue que muchas de esas creencias provienen del contexto en donde nos movemos. Es por ello que estereotipos acerca de las universidades públicas versus las privadas generan situaciones de conflicto cuando de evaluación se habla (Laval, 2004). Un cambio en la cultura de evaluación de las instituciones debe reconocer los valores subyacentes en la organización, de tal forma que se logren entender las actitudes de las personas como una manifestación de sus preferencias por dichos valores (House, 1994; y Johnson y Nissenbaum, 1995). Al igual que todo en la vida, las actitudes se aprenden y se pueden desaprender también. Un cambio en la cultura de evaluación es, en esencia, un cambio de actitudes.

Los tres temas explorados en esta investigación no excluyen otros componentes de lo que hemos denominado cultura de evaluación. El término es complejo y son muchas las formas en que puede abordarse. La Fig. 1 al inicio de este artículo muestra diversos elementos y perspectivas desde las que se puede estudiar este fenómeno, frecuentemente soslayado. Esta misma figura es un referente de los alcances y limitaciones del presente estudio en cuanto a los temas que fueron abordados. Otras limitaciones giran en torno al aspecto metodológico que plantea la obtención de información a partir de las percepciones de los evaluadores en formación y no a través de observación directa de las prácticas de evaluación en las instituciones educativas.

La evaluación institucional es una condición necesaria, no suficiente, para mejorar la calidad de nuestras instituciones educativas. Desde una perspectiva técnica se dan muchas recomendaciones valiosas para promover prácticas de evaluación cuyos resultados arrojen información válida, confiable y útil para la mejora educativa; pero la evaluación institucional va más allá de cuestiones técnicas. De nada sirve contar sólo con la información que arroje un estudio de evaluación, si no se promueven otras condiciones que aseguren la suficiencia en la consecución de la calidad educativa.

La evaluación institucional es una actividad que involucra a personas... con sus miedos, sus expectativas, sus motivaciones. A través de estudiar la cultura de evaluación pretendimos aportar conocimiento sobre cómo los distintos actores educativos viven el proceso de evaluación, a manera de preámbulo de futuros estudios que exploren la forma en que ellos traduzcan los resultados de evaluación en acciones concretas orientadas a la mejora educativa. Desde un análisis de buenas prácticas de evaluación institucional (para inferir de ellas la cultura existente), hasta estudios de educación comparada que contrasten, a nivel internacional, distintas culturas de evaluación, muchos otros estudios adicionales pueden ser sugeridos para seguir explorando este fenómeno.

Referencias

Aboites, H. (1999), "La cultura de la evaluación en México y la evaluación de los académicos", en M. Rueda y M. Landesmann (coords.), ¿Hacia una nueva cultura de la evaluación de los académicos?, México, UNAM–CESU, Pensamiento Universitario, Tercera época, núm. 88, pp. 34–55. [ Links ]

Bardín, L. (2004), El análisis de contenido, Madrid, Akal. [ Links ]

Bolseguí, M. y A. Fuguet (2006), "Cultura de evaluación: una aproximación conceptual", Investigación y Postgrado, vol. 21, núm. 1, pp. 77–98, en: http://dialnet.unirioja.es/servlet/articulo?codigo=2309843 (consulta: 5 de enero de 2010). [ Links ]

Bustelo, M. (2006), "The Potential Role of Standards and Guidelines in the Development of an Evaluation Culture in Spain", Evaluation, núm. 12, pp. 437–453. [ Links ]

Cardozo, M. (2009), "La institucionalización de una cultura de la evaluación en la administración pública mexicana: avances y desafíos pendientes", Convergencia, vol. 16, núm. 49, pp. 175–198, en: http://redalyc.uaemex.mx/src/inicio/ArtPdfRed.jsp?iCve=10504907 (consulta: 7 de enero de 2010). [ Links ]

Chiavenato, I. (2004), Comportamiento organizacional, México, Thomson. [ Links ]

Conley, S. y N.S. Glasman (2008), "Fear, the School Organization, and Teacher Evaluation", Educational Policy, vol. 22, núm. 1, pp. 63–85. [ Links ]

Díaz Barriga, A. y T. Pacheco (2007), Evaluación y cambio institucional, México, Paidós. [ Links ]

Dochy, F., M. Segers y S.Dierick (2002), "Nuevas vías de enseñanza y aprendizaje y sus consecuencias: una nueva era de la evaluación", Revista de Docencia Universitaria, vol. 2, núm. 2, pp. 13–30, en: http://revistas.um.es/red_u/article/view/20051/19411 (consulta: 8 de enero de 2009). [ Links ]

Elola, N. y L. Toranzos (2000), "Evaluación educativa: una aproximación conceptual", en: http://www.oei.es/calidad2/luis2.pdf (consulta: 15 de marzo de 2008). [ Links ]

Gago, A. (2002), Apuntes acerca de la evaluación educativa, México, Secretaría de Educación Pública, en: http://cosdac.sems.gob.mx/descarga_archivo.php?b=3 & documento=doc__29.pdf (consulta: 24 de diciembre de 2009). [ Links ]

House, E. (1994), Evaluación, ética y poder, Madrid, Morata. [ Links ]

Ibarra, E. (2000), "Claroscuros de la evaluación de los académicos: ¿qué sabemos?, ¿qué nos falta?", Revista Mexicana de Investigación Educativa, vol. V, núm. 10, pp. 377–386. [ Links ]

Johnson, D. y H. Nissenbaum (1995), Computer, Ethics, and Social Values, Englewood Cliffs, NJ, Prentice–Hall. [ Links ]

Krippendorf, K. (1990), Metodología del análisis de contenido: teoría y práctica, Barcelona, Paidós. [ Links ]

Laval, C. (2004), La escuela no es una empresa. El ataque neoliberal a la enseñanza pública, Barcelona, Paidós. [ Links ]

Marchesi, A. y E. Martín (1998), Calidad de la enseñanza en tiempos de cambio, Madrid, Alianza. [ Links ]

McAnally–Salas, L. (2006), "Madurez paradigmática y algunas repercusiones en las instituciones de educación superior", Acción Educativa, núm. 6, pp. 27–32, en: http://red–academica.net/mcanally/wp–content/uploads/2007/03/rae–06–mcanally.pdf (consulta: 15 de diciembre de 2009). [ Links ]

Morgan, G. (1998), Imágenes de la organización, México, Alfaomega. [ Links ]

Neirotti, N. y D.R. Brown (2001), La evaluación de políticas y programas en la región del Caribe de habla inglesa: problemas conceptuales y prácticos, Santiago de Chile, CEPAL. [ Links ]

Nieto–Caraveo, L.M. (2006), "El PIFI y la planeación y evaluación estratégicas en la UASLP", Revista Universitarios Potosinos, vol. 2, núm. 2, pp. 56–60, en: http://revista.uaslp.mx/Default.htm (consulta: 4 de enero de 2010). [ Links ]

Pérez Gómez, A. (1998), La cultura escolar en la sociedad neoliberal, Madrid, Morata. [ Links ]

República Argentina, Ministerio de Educación–Dirección Nacional de Información y Evaluación de la Calidad Educativa (2009), Hacia una cultura de la evaluación, Buenos Aires, Ministerio de Educación, en: http://www.oei.es/pdf2/hacia_una_cultura_evaluacion_argentina.pdf (consulta: 10 de diciembre de 2009). [ Links ]

Rey, R. y J. Santa María (2000), La educación en un contrato de calidad, Barcelona, Cisspraxis. [ Links ]

Reyes, C.I. (2006), "La nueva cultura de la evaluación en educación superior", IV Congreso Internacional de Docencia Universitaria e Innovación, Barcelona, 30 de junio, 1 y 2 de julio de 2010, en: http://www.epsevg.upc.edu/fdv/docs/doc74.pdf (consulta: 7 de enero de 2010). [ Links ]

Rutty, M.G. (2003), "La cultura de la evaluación y las prácticas de evaluación de impacto en capacitación en la administración pública y privada", Segundo Congreso Argentino de Administración Pública, Sociedad, Estado y Administración, Córdoba, Argentina, 27 al 29 de noviembre de 2003, en: http://www.aaeap.org.ar/ponencias/congreso2/Rutty_Maria.pdf (consulta: 3 de enero de 2010). [ Links ]

Schein, E. (1992), Organizational Culture and Leadership, San Francisco, CA, Jossey–Bass. [ Links ]

Stake, R. (1998), Investigación con estudio de casos, Madrid, Morata. [ Links ]

Tirado, F. (2003), "La evaluación en polémica", Revista Educación 2001, núm. 94, pp. 47–50. [ Links ]

Tirado, F., A. Miranda y A. Sánchez (2007), "La evaluación como proceso de legitimidad: la opinión de los alumnos. Reporte de una experiencia", Perfiles Educativos, vol. XXIX, núm. 118, pp. 7–24. [ Links ]

Valenzuela, J.R. (2004), Evaluación de instituciones educativas, México, Trillas. [ Links ]

Vargas–Porras, A.E. (2001), "La cultura evaluativa: su construcción desde la evaluación docente", Congreso Internacional de Investigación Educativa IIMEC–INIE "25 años en Pro de la Educación", Costa Rica, en: http://www.inie.ucr.ac.cr/congreso/memoria/archivos/ ponencias/aliciavargas.pdf (consulta: 3 de enero de 2010). [ Links ]

Yin, R.K. (2002), Case Study Research, Thousand Oaks, CA, Sage. [ Links ]

1 El artículo que aquí se presenta fue parte de un proyecto titulado: "Modelo sistémico de evaluación institucional para el mejoramiento de la calidad educativa", el cual fue financiado por el Fondo Mixto de Fomento a la Investigación Científica y Tecnológica del CONACyT y el Gobierno del Estado de Guanajuato. Los investigadores agradecen el apoyo brindado para el desarrollo de esta investigación.

2 Para mayor información del modelo y del proyecto en general, véase: http://www.ruv.itesm.mx/convenio/modelo/homedoc.htm

]]>