Servicios Personalizados

Revista

Articulo

Indicadores

-

Citado por SciELO

Citado por SciELO -

Accesos

Accesos

Links relacionados

-

Similares en

SciELO

Similares en

SciELO

Compartir

Terra Latinoamericana

versión On-line ISSN 2395-8030versión impresa ISSN 0187-5779

Terra Latinoam vol.28 no.1 Chapingo ene./mar. 2010

División I

Clasificador genérico de objetos en imágenes AVHRR

Generic object classificator in AVHRR images

Fermín Pascual Ramírez1, Fernando Paz Pellat1‡, Mario Martínez Menes1, Enrique Palacios Vélez1, Enrique Mejía Sáenz1 y Erasmo Rubio Granados1

1 Colegio de Postgraduados, Campus Montecillo. 56230 Montecillo, estado de México. *Autor responsable: (pellat@colpos.mx).

Recibido: noviembre de 2006.

Aceptado: abril de 2009.

RESUMEN

El presente artículo describe un algoritmo para llevar a cabo una clasificación genérica de objetos utilizando imágenes del sensor advanced very high resolution radiometer (AVHRR), basado en la firma espectral de los objetos genéricos (suelo, mezcla suelo–vegetación, cuerpos de agua, nubes, etc.). Debido a las particularidades de las bandas disponibles en el sensor AVHRR, se presenta un algoritmo específico utilizando la banda 3a (B3a) y otro utilizando la banda 3b (B3b) de este sensor. Los algoritmos, se basan en árboles de decisión, que no requieren de campos de entrenamiento para llevar a cabo la clasificación. Los algoritmos han sido probados utilizando bases de datos espectrales internacionales con resultados satisfactorios en todos los casos, obteniéndose precisiones de clasificación superiores a noventa por ciento.

Palabras clave: clasificación de objetos genéricos, AVHRR, firmas espectrales, sensores remotos.

SUMMARY

This paper describes an algorithm for generic classification of objects contained in advanced very high resolution radiometer (AVHRR) sensor images, based on the spectral signature of the generic objects (soil, soil–vegetation mixture, bodies of water, clouds, etc.). Due to the particularities of the available bands in the AVHRR sensor, we present a specific algorithm using the 3a band (B3a) and another using the 3b band (B3b) of this sensor. The algorithms are based on decision trees that do not require training fields to carry out the classification. The algorithms have been tested using international spectral data bases with satisfactory results in all the cases, obtaining classification precision above ninety percent.

Keywords: generic objects classification, AVHRR, spectral signatures, remote sensing.

INTRODUCCIÓN

Uno de los métodos eficaces para distinguir diferentes tipos de objetos presentes en una imagen obtenida por un sensor a bordo de alguna plataforma satelital, consiste en el estudio de su firma espectral. La mayor parte de los algoritmos existentes para distinguir diferentes tipos de objetos, requiere para su funcionamiento una gran cantidad de información espectral, por lo que se dificulta la generalización hacia imágenes tomadas por la mayoría de los sensores, siendo este resultado, una solución particular a la clasificación de objetos genéricos (suelo, mezcla suelo–vegetación, cuerpos de agua, nubes, etc.). La clasificación de objetos genéricos permite el desarrollo jerárquico de segmentación en el análisis de imágenes satelitales, definiendo máscaras de objetos que pueden ser analizadas a mayor detalle dependiendo de intereses, sin necesidad de incluir los objetos no requeridos. Asimismo, una máscara de objetos como suelo/ vegetación, agua y nubes permite delimitar interfaces mar–tierra para ser usadas en esquemas de georeferenciación automatizada de imágenes. Algunos trabajos (Richardson y Wiegand, 1977; Lambeck et al., 1978; Palacios et al., 2006), permitieron desarrollar algoritmos confiables para la clasificación de elementos contenidos en una imagen en grupos genéricos.

La mayor parte de las clasificaciones de objetos, se llevan a cabo utilizando dos métodos con sus diferentes variantes, a saber: la clasificación supervisada y la clasificación no supervisada (Jensen, 2000). Generalmente, la mayoría de los resultados obtenidos con estos métodos conducen a errores de asignación de las clases de los píxeles. Para mejorar el desempeño de los clasificadores, se han diseñado algoritmos que implican el uso de redes neuronales (Key et al., 1989), sus resultados proporcionan altos niveles de confiabilidad al emplearlas en imágenes satelitales. Sin embargo, su potencialidad, depende de la elección de sitios de entrenamiento, lo que dificulta su aplicación masiva. Los resultados pueden mejorar considerablemente, aplicándola posterior a la clasificación genérica de elementos contenidos en una imagen.

En el año 1979 se lanzó el primer satélite de la NOAA (National Oceanic and Atmospheric Administration del Gobierno de los Estados Unidos de América), llevando a bordo el sensor AVHRR (advanced very high resolution radiometer) con capacidad de monitoreo global de la superficie terrestre con tiempos de revisita de un día y resolución espacial a nadir de 1.1 km x 1.1 km. A partir del lanzamiento del primer satélite (TIROS–NOAA–6) hasta la actualidad (NOAA–19) hay tres versiones del sensor AVHRR (NOAA, 1998; NOAA, 2006). En la versión 3, actual, las bandas espectrales son las siguientes: B1 (rojo o R, de 580 a 680 nm), B2 (infrarojo cercano o IRC, de 725 a 1100 nm), B3a (infrarojo medio 1 o IRM1, de 1580 a 1640 nm), B3b (infrarojo térmico–reflectivo o IRTR, de 3550 a 3930 nm), B4 (infrarojo térmico 1 o IRT1, de 10300 a 11300) y B5 (infrarojo térmico 2 o IRT2, de 11500 a 12400 nm). En las versiones 1 y 2 la banda B3a no estuvo disponible y en la versión 3 es configurable; sólo una de las bandas B3a o B3b se usa. Esto implica la necesidad de considerar algoritmos de clasificación de objetos genéricos para cada una de estas bandas en forma independiente. Las funciones espectrales entre las bandas de las versiones 1, 2 y 3 son diferentes; aunque tiene la misma estructura. En lo siguiente, la discusión se orienta a la versión 3 del sensor AVHRR con las reflectancias expresadas en porcentajes.

La necesidad de aprovechar el amplio rango de imágenes históricas disponibles de este sensor, obligó al desarrollo de una algoritmo específico para los casos en que se utiliza la banda B3a o bien la banda B3b. De esta manera, se garantiza contar con elementos suficientes para llevar a cabo la clasificación en cualquiera de las imágenes del sensor AVHRR, de cualquier versión.

El antecedente más reciente relacionado con este trabajo, es el desarrollado por Palacios et al. (2006), que propone un algoritmo de clasificación genérica de objetos aplicados a la información contenida en las imágenes del sensor enhanced thematic mapper plus (ETM+).

Patrones espectrales de objetos genéricos

La ley de conservación de la energía establece que para los objetos terrestres, en el espectro de onda corta:

donde: R = reflectancia, T = transmitancia, A = absorbancia y el subíndice λ = se refiera a una banda espectral específica.

En el caso del espectro electromagnético de onda larga (térmico), la transmitancia puede considerarse como nula, por lo que si aplicamos la ley de Kirchhoff tenemos que la absorbancia es igual a la emitancia (ε), por lo que bajo condiciones de equilibrio termodinámico tenemos que:

Para el caso de la banda térmica–reflectiva del sensor AVHRR, la reflectancia es producto de la contribución de la reflectancia solar (subíndice R) y de la emitancia térmica (subíndice ε):

Así, para evitar los problemas asociados a la determinación de las temperaturas radiativas en las bandas térmicas o térmico–reflectivas, podemos estimar directamente su reflectancia (emisividad) y analizar las firmas espectrales de los objetos terrestres en el espectro del visible al infrarrojo térmico (400 a 14,000 nm).

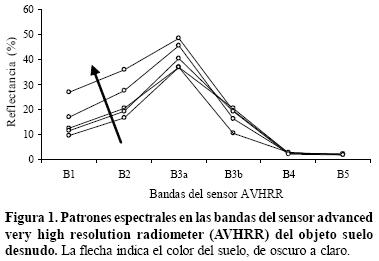

Las Figuras 1 a 11, (2, 3, 4, 5, 6, 7, 8, 9, 10) fueron generadas usando la librería espectral de la Jhons Hopkins University o JHU (Salisbury y D'Aria, 1992 y 1994; Salisbury et al., 1994), integrada a la librería espectral del sensor ASTER (JPL, 1999). En caso contrario, se especifica la referencia de los espectros electromagnéticos usados.

Objeto suelo desnudo y mezcla suelo–vegetación

La Figura 1 muestra los patrones espectrales de los suelos desnudos y la Figura 2 la de vegetación densa (prácticamente pura vegetación). En el caso de material vegetal senescente, en contraste con material verde de la vegetación, la Figura 3 muestra los patrones espectrales de un pasto verde y uno seco. Se observa de esta figura que el pasto seco tiene un patrón espectral similar al del suelo desnudo, por lo que resulta muy difícil discriminar estos dos objetos.

En la Figura 4 se muestran los patrones espectrales de las bandas B1, B2 y B3a de simulaciones radiativas de mezclas suelo–vegetación con diferentes índices de área foliar o IAF, con suelos de fondo con diferentes propiedades ópticas. Paz et al. (2005) describen a detalle estas simulaciones para las bandas del sensor ETM+ del satélite LANDSAT. Esas mismas simulaciones fueron utilizadas, pero con las funciones de respuesta del sensor AVHRR.

Objeto agua

La Figura 5 muestra los patrones espectrales para el caso de agua "de la llave". La Figura 6 muestra estos patrones para el caso de agua con diferentes niveles turbiedad (Lodhi et al., 1997 para agua con sedimentos y Han, 1997 para agua con algas y sedimentos; además de la base de JPL, 1999).

Objeto nieve y escarcha

La Figura 7 muestra los patrones espectrales para el caso de la nieve y la escarcha.

Objeto nube

La Figura 8 muestra los patrones espectrales de nubes con diferentes espesores ópticos (grosores de las nubes) (Watts et al., 1998). La Figura 9 muestra los patrones espectrales de las bandas B1, B2 y B3a para el caso de nubes cirrus (Gao et al., 1998), muy problemáticas de discriminar.

Objeto materiales de construcción

En las partes urbanas y semi–urbanas, los materiales de construcción son el concreto y el asfalto. Aunque no consideradas en el algoritmo mostrado mas adelante, la Figura 10 muestra los patrones espectrales típicos de concretos de construcción y la Figura 11 de asfaltos.

El análisis de los diferentes patrones espectrales de los objetos analizados permite el desarrollo de discriminación entre ellos, con algunos traslapes sujetos a confusión.

MATERIALES Y MÉTODOS

Usando una base de firmas espectrales de diferentes objetos genéricos (y subclases), se desarrollaron algoritmos para su clasificación. Los valores de reflectancias en todos los casos analizados se refieren a mediciones sobre la superficie terrestre. Para el uso de los algoritmos desarrollados, la información espectral del sensor AVHRR requiere correcciones atmosféricas.

A continuación se presentan valores umbrales (implicando razones o diferencias entre bandas) que fueron optimizados para la base de firmas espectrales utilizada. Estos valores se comportan bien en las aplicaciones operacionales de los algoritmos desarrollados (datos no mostrados), después de la corrección atmosférica de las imágenes del sensor AVHRR.

Condiciones generales para B3a y B3b

Después de analizar el comportamiento de los patrones espectrales, se encontró que las siguientes consideraciones son comunes al uso de B3a o B3b para la clasificación de los objetos genéricos suelo, vegetación y la mezcla suelo–vegetación:

Todos los patrones analizados cumplen con la condición B1 < B2, por lo que este rasgo puede usarse en términos generales para separar grupos de patrones espectrales.

La separación del suelo en relación al objeto suelo–vegetación (verde y seca), puede basarse en el patrón convexo–cóncavo de las bandas B1–B2–B3a (Palacios et al., 2006) y B2–B3b–B4.

Para la clasificación de los objetos genéricos agua, nubes, nieve/escarcha, luego del análisis de los espectros correspondientes, se consideró lo siguiente:

La discriminación general nubes–agua y nieve–escarcha puede realizarse usando el contraste entre las bandas B2 y B3a o con B1 y B3b. Con B2/B3a > 2, o bien B1/B3b > 6 nieve y escarcha, son separables.

Para separar nieve de escarcha, se usa la relación B2/B3a > 4 para clasificar nieve. La escarcha puede confundirse con la nube gruesa, por lo que se aplica la prueba B3a/B4 > 30 para distinguir escarcha de nube gruesa. Por otro lado, B3b/B4 > 6 permite clasificar escarcha.

Las nubes se clasificaron, de acuerdo con su espesor óptico, en gruesas, delgadas y medias. La discriminación de nubes gruesas se hizo usando B2 > 60.

El objeto más difícil de clasificar fue nube media. Un primer discriminador es separarla de la nube delgada usando B2 • 20. Otras condiciones son B2/B1 > 0.9 y, B3a/B4 > 4 o B3b/B2 > 1.05, para evitar confusiones con nubes cirrus o delgadas o agua con diferentes niveles de turbiedad.

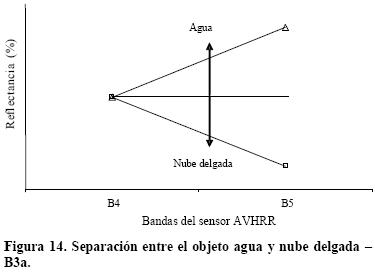

La última parte de la clasificación es discriminar entre agua y nubes delgadas. La solución consiste en aplicar la siguiente relación B4 > B5.

Objetos genéricos B3a y algoritmo de clasificación

La banda B3a del sensor AVHRR define estrategias de clasificación genérica de objetos con énfasis en la parte reflectiva del espectro electromagnético. Así, del análisis de los patrones espectrales, se llega a las siguientes consideraciones:

Los suelos cumplen la condición B2 • 0.5 (B1+B3a); son convexos (vistos de arriba). La mezcla suelo–vegetación muestra un patrón cóncavo (vistos de arriba). La Figura 12 muestra los patrones discutidos.

Para separar los niveles de cobertura (fracción de vegetación e índice de área foliar o IAF) de la vegetación, podemos usar dos criterios generales: relación entre B3a y B2 o que un índice de vegetación basado en la banda del rojo (R) e infrarrojo cercano (IRC) sea menor o mayor que un valor umbral. Para vegetación de baja cobertura (generalmente IAF < 1), se tiene que B3a • B2, Figura 13.

La reflectancia del suelo del fondo puede hacer que B3a sea ligeramente menor que B2, por lo que el patrón se clasificaría como de mayor cobertura a baja. Para reducir los problemas de la reflectancia del suelo, se usa un índice de vegetación que reduzca estos efectos. El índice de vegetación NDVIcp (Ecuación 4), desarrollado por Paz et al. (2007), puede ser usado para ese fin.

donde:

c y d = constantes empíricas.

a0 y b0 = constantes aditivas y multiplicativas respectivamente, de las líneas de igual vegetación en el espacio R–IRC.

Usando el NDVIcp, se definen las clases de cobertura de la vegetación como: cobertura baja (NDVIcp • 0.3), cobertura media (0.3 < NDVIcp < 0.5; representando 1.0 < IAF < 2.0, aproximadamente) y cobertura alta o vegetación densa (NDVIcp • 0.5; representando IAF > 2.0, aproximadamente).

En vegetación de baja cobertura o vegetación seca/ residuo, su separación es problemática, por lo que no fue tratada en esta versión del clasificador. La discriminación entre nube delgada y agua se realiza usando la relación B4 > B5, Figura 14.

Para la clasificación de los objetos genéricos agua, nube y nieve/escarcha, cuando las bandas B1 o B2 están saturadas no se pueden utilizar, por lo que es necesario usar las relaciones entre las bandas B3a, B4 y B5, así que se procede de la siguiente forma:

Se usa la banda B3a para discriminar nubes gruesas (B3a > 50).

Para definir el objeto escarcha se usa B3a/B4 > 40.

El objeto nieve confundible con el de nube gruesa, requiere aplicar el criterio B2/B3a > 4.

Usando los criterios definidos previamente para los objetos genéricos analizados, y sus subclases, la Figura 15 muestra el algoritmo completo propuesto para el caso de contar solo con la banda B3a del sensor AVHRR. Mientras que los valores iniciales de los umbrales del algoritmo de clasificación genérica de objetos están mostrados en el Cuadro 1 y su significado definido en el algoritmo de la Figura 15.

Objetos genéricos y algoritmo de clasificación B3b

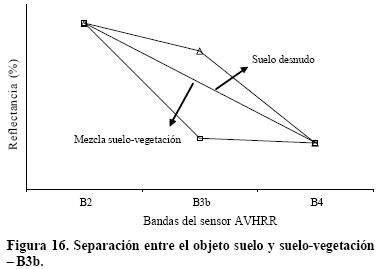

La banda B3b (infrarrojo térmico reflectivo o IRTR) del sensor AVHRR define estrategias de clasificación genérica de objetos con énfasis en la parte reflectiva y térmica del espectro electromagnético. De manera similar al caso de la banda B3a, del análisis del comportamiento de las firmas espectrales de los objetos genéricos, para el caso de clasificación de los objetos genéricos, suelo, vegetación y suelo–vegetación, se obtuvieron las siguientes consideraciones:

Todos los patrones analizados cumplen con la condición B1 < B2, por lo que este rasgo puede usarse en términos generales para separar grupos de patrones espectrales.

La separación del suelo con relación al objeto suelo–vegetación (verde y seca), puede basarse en el patrón convexo–cóncavo de las bandas B2–B3b–B4. Los suelos cumplen la condición B3b > 0.45 (B2+B4); esto es, son cóncavos o ligeramente convexos. La mezcla suelo–vegetación muestra un patrón convexo. La Figura 16 muestra los patrones discutidos.

Un rasgo para caracterizar suelos es la razón B3b/ B4 > 3, típico en suelos.

Para separar los niveles de cobertura de la vegetación (fracción de vegetación e IAF), se usan dos criterios generales: relación entre B3b y B4 (Snyder et al., 1998 y Wilber et al., 1999) o el índice de vegetación NDVIcp. Para la vegetación de baja cobertura (generalmente IAF < 1), se utiliza B3b/B4 > 1.5 o NDVIcp • 0.3.

La relación B3b/B4 se usa en forma similar al NDVIcp para discriminar diferentes niveles de cobertura de la mezcla suelo–vegetación, Figura 17.

En esta versión del algoritmo no se usó este criterio para vegetación de media y alta cobertura.

El NDVIcp, se usa para definir las clases de cobertura de la vegetación como: cobertura baja (NDVIcp • 0.3), cobertura media (0.3 < NDVIcp < 0.5; representando 1.0 < IAF < 2.0, aproximadamente) y cobertura alta o vegetación densa (NDVIcp • 0.5; representando IAF > 2.0, aproximadamente).

En el caso de la vegetación de baja cobertura o vegetación seca/residuo, su separación es problemática, por lo que no fue intentada en esta versión del clasificador.

Los patrones entre las bandas B4 y B5 son difíciles de usar, ya que presentan relaciones menores, iguales o mayores entre estas bandas, para un mismo objeto suelo–vegetación.

Cuando la clasificación se refiere a los objetos genéricos agua, nube y nieve/escarcha, en caso de la saturación de las bandas B1 o B2, éstas no se pueden utilizar por lo que es necesario basarse en las relaciones entre las bandas B3b, B4 y B5, de tal forma que para la clasificación se procede como sigue:

El objeto nieve es discriminado usando B3b/B4 < 10.

Para definir el objeto nube gruesa podemos usar B3b > 20, para separarlo de escarcha.

Usando los criterios definidos previamente para los objetos genéricos analizados, y sus subclases, la Figura 18 muestra el algoritmo completo propuesto para el caso de contar únicamente con la B3b del sensor AVHRR. Por otro lado, los valores iniciales de los umbrales del algoritmo de clasificación genérica de objetos están mostrados en el Cuadro 2 y sus significados definidos en el algoritmo de la Figura 18.

RESULTADOS Y DISCUSIÓN

Los algoritmos de clasificación genérica de objetos para las bandas B3a y B3b del sensor AVHRR fueron desarrollados bajo las siguientes condiciones de aplicación:

Todas las bandas espectrales del sensor AVHRR están en reflectancias.

Las reflectancias en todas las bandas están corregidas por los efectos atmosféricos.

Las reflectancias están normalizadas a nadir y ángulo cenital solar estándar de 30–45°.

Las imágenes del sensor AVHRR son diurnas.

Para validar el algoritmo desarrollado para el sensor AVHRR, se utilizó una base de datos de 337 firmas espectrales. En el caso de los suelos desnudos y las mezclas suelo–vegetación, se utilizaron firmas espectrales en el espectro electromagnético de onda corta; a excepción de tres espectros con información en todas las bandas.

Las clases utilizadas en el clasificador genérico de objetos están mostradas en el Cuadro 3; con algunas clases adicionales agregadas para su análisis mas detallado. Asimismo, en el Cuadro 3 se muestra el número de firmas espectrales en cada clase codificada de la base de datos.

En el Cuadro 4 se muestran las fuentes de la base de datos de firmas espectrales utilizada. En el caso de la fuente COLPOS, estas son firmas medidas en diferentes objetos en el Campus Montecillo del Colegio de Postgraduados (COLPOS), México.

Los resultados de la clasificación de los objetos suelo–vegetación, banda B3a, están mostrados en el Cuadro 5, donde también se indica la precisión obtenida.

En el caso del suelo desnudo (SD), este fue clasificado correctamente. El residuo de vegetación (RE), muestra confusión con suelo desnudo.

El Cuadro 6, muestra los resultados de la clasificación de los objetos suelo–vegetación, usando la banda B3b.

Es importante enfatizar que los resultados obtenidos en la clasificación de la mezcla suelo–vegetación tuvieron una precisión menor al 100%, debido al uso de firmas espectrales de simulaciones radiactivas que utilizan la hipótesis de medio homogéneo ("turbio"). En el caso de mediciones de campo, la clasificación fue 100% precisa. Para los objetos residuo y vegetación senescente (no incluidos en el algoritmo), estos se clasificaron generalmente como suelo desnudo (residuo y vegetación con senescencia avanzada), lo cual es correcto.

CONCLUSIONES

– La clasificación genérica de objetos utilizando imágenes del sensor advanced very high resolution radiometer (AVHRR), representa un reto mayor que las clasificaciones genéricas utilizadas en imágenes thematic mapper (TM) y las del sensor enhanced thematic mapper plus (ETM+), debido al reducido número de bandas con las que se cuenta como soporte para la discriminación de los diferentes tipos de objetos presentes en las imágenes satelitales.

– Los resultados de la validación de los algoritmos, usando una base de datos de firmas espectrales de objetos genéricos muestran que el esquema desarrollado es confiable y preciso, a grado tal, que la mayoría de las precisiones obtenidas fueron superiores al 90% (cuando se eliminan las confusiones de los residuos/ vegetación seca o senescente).

– Los objetos suelo, suelo–vegetación y vegetación, son claramente discriminados utilizando las bandas b3a o b3b, a pesar de abordar algoritmos diferentes.

– Los resultados mostraron que ambos algoritmos, que parten de bases comunes, tienen altos grados de precisión similares entre sí, salvo pequeñas variaciones, tomando en cuenta que la información utilizada para llevar a cabo la clasificación, a partir del contenido de banda B3a o B3b son diferentes.

– Finalmente, es importante implementar los algoritmos desarrollados en un sistema de proceso de imágenes AVHRR y evaluar los resultados de las clasificaciones usando imágenes AVHRR de la base histórica en archivo, trabajo en proceso que será presentado en otra publicación.

LITERATURA CITADA

Bausch, W. C. 1993. Soil background effects on reflectance–based crop coefficients for corn. Remote Sens. Environ. 46: 213–222. [ Links ]

Gao, B. C., W. Han, S. C. Tsay, and N. F. Larsen. 1998. Cloud detection over the Artic region using airborne imaging spectrometer data during the daytime. J. Appl. Meteorol. 37: 1421–1429. [ Links ]

Han, L. 1997. Spectral reflectance with varying suspended sediment concentrations in clear and algae–laden waters. Photogramm. Eng. Remote Sens. 63: 701–705. [ Links ]

Huete, A. R., R. D. Jackson, and D. F. Post. 1985. Spectral response of a plant canopy with different soil backgrounds. Remote Sens. Environ. 17: 35–53. [ Links ]

Jensen, J. R. 2000. Remote sensing of the environment: an earth resource perspective. 2nd edition. Prentice Hall. Upper Saddle River, NJ, USA. [ Links ]

JPL (Jet Propulsion Laboratory). 1999. ASTER spectral library, Jet Propulsion Laboratory, California Institute of Technology, Pasadena, California (http://speclib.jpl.nasa.gov/). (Consultado: septiembre 19, 2008). [ Links ]

Key, J., J. A. Maslanik, and A. J. Schweiger. 1989. Classification of merged AVHRR and SMMR arctic data with neural network. Photogramm. Eng. Remote Sens. 55: 1331–1338. [ Links ]

Lambeck, P. F., R. J. Kauth, and G. S. Thomas. 1978. Data screening and preprocessing for Landsat MSS data. Proceedings 12th International Symposium on Remote Sensing of Environmental. University of Michigan, Ann Arbor, MI, USA. [ Links ]

Lodhi, M. A., D. C. Rundquist, L. Han, and M. S. Kuzila. 1997. The potential of remote sensing of loess soils suspended in surface waters. Water Resour. Bull. 33: 111–127. [ Links ]

NOAA (National Oceanic and Atmospheric Administration). 1998. NOAA Polar orbiter data user's guide. U. S. Department of Commerce. National Environmental Satellite, Data, and Information Service. (http://www.ncdc.noaa.gov/oa/pod–guide/ncdc/docs/podug/cover.htm). (Consultado: septiembre 19, 2008). [ Links ]

NOAA (National Oceanic and Atmospheric Administration). 2006. NOAA KLM User's guide with NOAA–N, –N' Supplement. U. S. Department of Commerce. National Environmental Satellite, Data, and Information Service. (http://www.ncdc.noaa.gov/oa/pod–guide/ncdc/docs/klm/cover.htm).(Consultado: septiembre 19, 2008). [ Links ]

Palacios–Sánchez, L. A., F. Paz–Pellat, J. L. Oropeza–Mota, B. Figueroa–Sandoval, M. Martínez–Menes, C. A. Ortiz–Solorio y A. Exebio–García. 2006. Clasificador genérico de objetos en imágenes ETM+. Agrociencia 40: 613–626. [ Links ]

Paz–Pellat, F. E. Palacios–Vélez, M. Bolaños–González, L. A. Palacios–Sánchez, M. Martínez–Menes, E. Mejía–Sáenz y A. Huete. 2007. Diseño de un índice espectral de la vegetación: NDVIcp. Agrociencia 41: 539–554. [ Links ]

Paz–Pellat, F., E. Palacios–Vélez, E. Mejía–Sáenz, M. Martínez–Menes y L. A. Palacios–Sánchez. 2005. Análisis de los espacios espectrales de la reflectividad del follaje de los cultivos. Agrociencia 39: 293–301. [ Links ]

Purdue University. 1974. Laboratory for applications of remote sensing vegetation and soils research data summary. (http://cobweb.ecn.purdue.edu/~frdata/FRData/data/74data/1974ExperimentSummaries.html#741209). (Consultado: septiembre 19, 2008). [ Links ]

Purdue University. 1982. Laboratory for applications of remote sensing vegetation and soils research data summary. (http://cobweb.ecn.purdue.edu/~frdata/FRData/data/82data/1982ExperimentSummaries.html#821901). (Consultado: septiembre 19, 2008). [ Links ]

Richardson, A. J. and C. L. Wiegand. 1977. A table look–up procedure for rapidly mapping vegetation cover and crop development. pp. 284–296. In: LARS Symposia. Purdue University. West Lafayette, IN, USA. [ Links ]

Salisbury, J. W. and D. M. D'Aria. 1992. Emissivity of terrestrial materials in the 8–14 μm atmospheric window. Remote Sens. Environ. 42: 83–106. [ Links ]

Salisbury, J. W. and D. M. D'Aria. 1994. Emissivity of terrestrial materials in the 3–5 μm atmospheric window. Remote Sens. Environ. 47: 345–361. [ Links ]

Salisbury, J. W., D. M. D'Aria, and A. Wald. 1994. Measurements of thermal infrared spectral reflectance of frost, snow, and ice. J. Geophys. Res. 99: 24235–24240. [ Links ]

Snyder, W. C., Z. Wan, Y. Zhang, and Y.–Z. Feng. 1998. Classification–based emissivity for land surface temperature measurement from space. Int. J. Remote Sens. 19: 2753–2774. [ Links ]

Tsay, S. C., K. Stamnes, and K. Jayaweera. 1989. Radiative energy budget in the cloudy and hazy artic. J. Atmos. Sci. 46: 1002–1018. [ Links ]

Watts, P. D., C. T. Mutlow, A. J. Baran, and A. M. Zavody. 1998. Study on cloud properties derived from Meteosat second generation observations. Final Rep., EUMETSAT ITT no. 97/181, Rutherford Appleton Laboratory. Oxfordshire, UK. [ Links ]

Wilber, A. C., D. P. Kratz, and S. K. Gupta. 1999. Surface emissivity maps for use in satellite retrievals of longwave radiation. NASA/TP–1999–209362. Hanover, MD, USA. [ Links ]