Servicios Personalizados

Revista

Articulo

Indicadores

-

Citado por SciELO

Citado por SciELO -

Accesos

Accesos

Links relacionados

-

Similares en

SciELO

Similares en

SciELO

Compartir

Agrociencia

versión On-line ISSN 2521-9766versión impresa ISSN 1405-3195

Agrociencia vol.44 no.6 Texcoco ago./sep. 2010

Recursos naturales renovables

Clasificación no supervisada con imágenes a color de cobertura terrestre

Unsupervised classification with ground cover color images

Antonia Macedo–Cruz1*, Gonzalo Pajares–Martinsanz2, Matilde Santos–Peñas2

1 Hidrociencias. Campus Montecillo, Colegio de Postgraduados. 56230. Montecillo, Estado de México. * Autor responsable: (macedoan@colpos.mx).

2 Universidad Complutense de Madrid. Ciudad Universitaria, 28040, Madrid, España.

Recibido: Julio, 2009.

Aprobado: Julio, 2010.

RESUMEN

La cobertura terrestre es un elemento geográfico que constituye la base de referencia para diversas aplicaciones relacionadas con la planificación del uso de los recursos naturales, la biodiversidad y la deforestación, como indicador del cambio climático y la desertificación. Hay diversos métodos para clasificar imágenes, pero no todos son aplicables a la clasificación de la cubierta terrestre. Por tanto, el objetivo de esta investigación fue generar y evaluar un modelo de clasificación no supervisada aplicable a imágenes de cobertura terrestre en modelo de color RGB (Red, Green, Blue; o Rojo, Verde, Azul [RVA]), que clasifique automáticamente las diferentes cubiertas y usos del suelo. La metodología desarrollada corresponde al grupo de procedimientos de clasificación no supervisada y se derivó del criterio de umbralización sugerido por el método de Otsu, basado en la varianza entre clases y dentro de clases. Para aplicarla se usaron fotografías aéreas con resolución espacial de 1:19 500, resolución espectral de tres bandas visibles RVA, y resolución radiométrica de 0 a 255 niveles. Los resultados se compararon con los reportados por un experto conocedor de la zona de estudio. El aporte principal de esta investigación fue generar y evaluar un método de clasificación de imágenes no supervisado de alta precisión y bajo costo computacional; como es el uso alternativo del método de Otsu, utilizado en la segmentación y la clasificación de imágenes a color. Por tanto, el resultado fue un clasificador por agrupamiento no supervisado que reconoce y clasifica hasta 95% de los elementos identificados en campo por el experto.

Palabras clave: clasificación, modelo de color RGB, método de Otsu, segmentación, umbralización, visión artificial.

ABSTRACT

Ground cover is a geographic element that constitutes the reference base for diverse applications related with planning the use of natural resources, biodiversity and deforestation, as an indicator of climatic change and desertification. There are diverse methods for image classification, but not all of them are applicable to the classification of ground cover. Therefore, the objective of this investigation was to generate and evaluate an unsupervised classification model applicable to ground cover images in color model RGB (Red, Green and Blue), which automatically classifies the different covers and soil uses. The developed methodology corresponds to the group of unsupervised classification procedures and was derived from the thresholding criterion suggested by the Otsu method, based on the variance among and within classes. For its application, aerial photographs were used with spatial resolution of 1:19 500, spectral resolution of three visible RGB bands, and radiometric resolution of 0 to 255 levels. The results were compared with those reported by an expert with knowledge of the zone of study. The principal contribution of this investigation was to generate and evaluate a method of unsupervised image classification of high precision and low computational cost, such as the alternative use of the Otsu method, utilized in the segmentation and classification of color images. Therefore, the result was a classifier by unsupervised clustering which recognizes and classifies up to 95% of the elements identified in the field by the expert.

Key words: classification, RGB color model, Otsu method, segmentation, thresholding, artificial vision.

INTRODUCCIÓN

Los avances en informática y tecnología de sensores remotos cambian la forma de recoger, procesar y usar la información geoespacial. La teledetección y la visión artificial son herramientas eficientes para procesar este tipo de información y facilitar el análisis de los datos, permitiendo el seguimiento de los cambios en la superficie terrestre (Chen y Stow, 2003).

Se realizan esfuerzos para desarrollar métodos avanzados de clasificación y segmentación de imágenes y técnicas para mejorar la precisión, pero clasificar datos obtenidos por teledetección es un tema complejo (Chen et al., 2004; Lu y Weng, 2007; Tseng et al., 2008). Esto se debe a que en una imagen de cobertura terrestre se deben considerar objetos con propiedades heterogéneas (Chen et al., 2003).

De acuerdo con el proceso de construcción, los métodos de clasificación de imágenes se dividen en dos grupos (Duda et al., 2001; Bow, 2002; Chuvieco, 2008): 1) supervisado: método de reconocimiento de patrones basado en la existencia de un conjunto de prototipos predefinidos; 2) no supervisado; no requiere conocimiento previo de la zona de estudio y desarrolla la clasificación en forma automática, aprovechando las características espectrales de la imagen para definir las agrupaciones con valores similares.

Los algoritmos de clasificación no supervisada se subdividen en dos grupos: con número de clases conocido y desconocido. El primer grupo incluye el método de las K–medias, el algoritmo de agrupamiento secuencial y el algoritmo ISODATA. En los métodos con número de clases desconocidas se encuentran el adaptativo y el de Batchelor y Wilkins, conocido como de máxima distancia (Bow, 2002).

La clasificación no supervisada aplicada a imágenes de cobertura terrestre la realizaron Du (2007) utilizando el análisis discriminante lineal, y Shah et al. (2004) quienes usaron el análisis de componentes independientes, mezclado con modelos como el de las k–medias. La presente investigación está dentro de los métodos de clasificación no supervisada y dentro de los algoritmos de agrupamiento con número de clases desconocidas.

El método de Otsu (1979) en su origen no es un método de clasificación (Pajares y Cruz, 2001) sino de umbralización, aplicable a imágenes en escala de gris; un método no paramétrico que, con base a la varianza de la intensidad del píxel entre dos clases, calcula el umbral óptimo. Ha sido mejorado y usado con objetivos especiales para el pre–procesamiento de imágenes por Liao et al. (2001) y Chen y Fang (2008), quienes mejoraron el tiempo de cómputo; Du et al. (2004) lo aplicaron a imágenes de video a color para extraer texto, mientras que Buxton et al. (2007) segmentaron imágenes médicas.

El objetivo de esta investigación fue desarrollar un clasificador no supervisado para imágenes de cobertura terrestre a color y clasificar agua, suelo y vegetación, lo cual se logró. Como aporte se obtuvo la expansión del principio de Otsu para la clasificación de imágenes útiles en el inventario de los recursos naturales.

MATERIALES Y MÉTODOS

La zona de estudio corresponde a la cuenca del río La Sabana, estado de Guerrero, México. Los materiales fueron 16 fotografías aéreas a color y en formato digital de octubre de 1997; escala 1:19 500 y resolución radiométrica de 0 a 255 niveles (Figura 1), las cuales se pre–procesaron, clasificaron y evaluaron.

Pre–procesamiento

Para el pre–procesamiento de las imágenes se utilizó el método Otsu (1979), buscando el umbral óptimo (simple o múltiple) para cada una de las bandas de la imagen a color, usando el algoritmo descrito en la Figura 2.

Clasificación no supervisada de imágenes en color

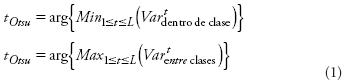

El objetivo del método de clasificación consiste en minimizar las desviaciones entre las observaciones que pertenecen al mismo grupo y maximizar las distancias entre los centros de los grupos, lo cual se representa por la función objetivo de la Ecuación 1.

Los umbrales obtenidos por cada una de las bandas espectrales, rojo, verde y azul, son identificados por tr, tg y tb.

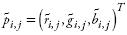

Cada pixel de la imagen se representa por: pi,j (ri,j, gi,j, bi,j)T siendo (i, j) la coordenada espacial y usando tr, tg, y tb para representar el valor preliminar del umbral de cada dominio de color. Por tanto, un pixel pi,j= (ri,j, gi,j, bi,j)T puede ser umbralizado como  .

.

Como producto, cada píxel de la fotografía aérea en color puede codificarse por tres bits (c1, c2, c3), donde los valores de ci (1 <= i <= 3) pueden ser entre 0 y n, siendo n el número de umbrales obtenidos. El total de píxeles de la imagen se agrupa en (n+1)3 clases, etiquetando cada grupo con un número consecutivo obtenido por la Ecuación 3, donde cada etiqueta representa un grupo de clases:

Considerando la k–esima clase como ck, para denotar el promedio de cada grupo de clase de una imagen RVA se usa la siguiente expresión: μk=(rk, gk, bk)T, cuyos componentes se obtienen con la Ecuación 4:

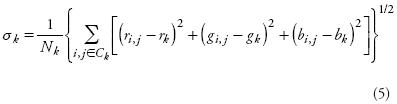

La varianza dentro de clases (σk) proporcionada por el método de Otsu (1979) se calcula para cada clase  por la Ecuación 5:

por la Ecuación 5:

donde, Nk es el número de píxeles de la clase Ck.

La varianza entre dos clases (σk,j), denotadas por Ck y Cj con k diferente de j:

donde, (rk, gk, bk), (rj, gj, bj) son definidos por la Ecuación 4 y los promedios espectrales de la clase Ck y Cj corresponden al dominio de color RVA.

Con base en las varianzas obtenidas con las ecuaciones (5) y (6), se pueden fusionar algunas agrupaciones debido a sus similitudes espectrales. Considerando que las clases Ck y Cj para k≠j, se fusionan si σk > σkj o σj >σk. Esto se debe a que la varianza entre dos clases σkj debe ser superior a la varianza dentro de las clases individuales σk y σj.

Este proceso de reagrupamiento se repite hasta que todas las varianzas entre clases sean mayores que sus correspondientes varianzas dentro de clase, en cuyo caso el resultado podría ser no reclasificar.

Si no hubo reclasificación y el número de clases totales es igual a (n+1)3, entonces el clasificador repite todo el proceso, y se incrementa en uno el número de umbrales a calcular; de lo contrario, se etiquetan las clases reagrupadas como clases definitivas.

Evaluación de la precisión

La precisión de un proceso de clasificación se refiere al grado de concordancia entre las clases de la imagen y un conjunto de datos de referencia (Congalton y Green, 1999). Para hacer una estimación cuantitativa se construyó una matriz de error difusa (Congalton y Green, 2009; Lunetta y Lyon, 2004), la cual es un arreglo cuadrado de números ordenados en columnas e hileras. Las columnas corresponden al conjunto de referencia, y las hileras a las clases generadas en el proceso de clasificación. Cada celda contiene dos valores: el primero representa las etiquetas aceptables; el segundo indica las etiquetas inaceptables y la diagonal principal sólo contiene las etiquetas consideradas absolutamente correctas.

Los valores de la diagonal principal de la matriz de error, donde coinciden las etiquetas de referencia y clasificación, corresponden a los aciertos del proceso. La precisión global de la clasificación se obtiene dividiendo la suma de los valores de la diagonal principal entre el tamaño de la muestra.

La precisión del usuario es un indicador de errores de omisión y se calcula dividiendo el número de aciertos por el total de muestras en la hilera correspondiente.

La precisión del productor del mapa es un indicador de errores de inclusión y se calcula dividiendo el número de aciertos entre el número total de muestras en la columna. La matriz de error difusa cuenta con dos valores por celda: el valor izquierdo significa aceptable (polígonos en los cuales más del 50% de los píxeles corresponden a dicha clase); los de la derecha son los píxeles clasificados como una clase de cobertura a la que no pertenece.

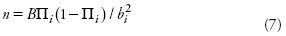

La matriz de error se construyó a partir de los resultados de la clasificación y los datos tomados del muestreo de campo se consideraron como datos de referencias, con la participación de un experto conocedor de la zona de estudio (Villegas et al., 2009) y la experiencia de los autores. También se consideró la clasificación de uso de suelos hecha por Villegas (2006), tomando polígonos como unidad de muestreo, seleccionados de manera aleatoria estratificada. El tamaño de la muestra se estimó de acuerdo con Congalton y Green (2009), mediante una distribución multinomial (95% y 5% de nivel de confianza y precisión), la cual tiene la siguiente expresión:

donde, la variable Πi es la fracción de superficie correspondiente a la clase i; B es el coeficiente determinado mediante una tabla de chi–cuadrada, con un grado de libertad y 1–α/k , dado que k es el número de clases o categorías; y b es la precisión deseada (b=0.05).

RESULTADOS Y DISCUSIÓN

Los resultados se relacionan con el pre–procesamiento, clasificación y evaluación de la precisión del clasificador aplicado a las imágenes de la Figura 1. De acuerdo con la información mostrada en la Figura 1 (A) se desarrolló el pre–procesamiento de imágenes permitiendo segmentar la información de cada banda en dos grupos (Figura 3), cuyo contenido por grupo se reporta en el Cuadro 1. De la segmentación resultó una imagen RVA constituida por ocho grupos de información (Figura 4 A), permitiendo continuar con su clasificación.

La clasificación se logró mediante el análisis exhaustivo de las varianzas entre clases y dentro de clases, para reagrupar y clasificar los objetos presentes. Con este proceso se obtuvo seis clases de objetos identificados con distinto color (Figura 4 B), cuyo porcentaje de cobertura se muestra en el Cuadro 2.

La imagen de la Figura 1(B), con 375 452 píxeles y mayor diversidad de objetos fue procesada por el mismo método que la Figura 1 (A), pero en este caso al no presentarse reagrupación, el clasificador recurrió automáticamente a la multi–umbralización. Se obtuvieron dos umbrales por banda lo que genera un modelo de agrupación de 33 grupos, los cuales al ser clasificados se convierten en nueve clases de objetos (Figura 5 b), cuyo color y porcentaje de cobertura se muestra en el Cuadro 3.

La precisión global obtenida en la clasificación de las imágenes de la Figura 1 (A) y (B) varió de 83% a 84% como exactitud determinista y de 93% a 95% como exactitud difusa. En el Cuadro 4 y 5 se presenta la precisión del productor y del usuario para cada una de las clases, calculadas por el método determinista y difuso, mediante la matriz de error difuso, para los cuales el tamaño de la muestra fue de 354 y 274 polígonos. La ventaja del enfoque de la matriz de error difuso es que combina toda la potencia de la matriz de error, para calcular tanto la exactitud determinista como la exactitud difusa.

El clasificador usado confunde los cuerpos de agua poco profundos con los pastos, debido a que las firmas espectrales son muy parecidas. No es un problema exclusivo de este algoritmo de clasificación, ya que Zhu et al. (2000) señalan dificultades para clasificar cuerpos de agua y bosque usando imágenes aéreas. Polidório et al. (2003) y Rowe and Grewe (2001) reportan el mismo problema al separar los cuerpos de agua y las sombras, y Saeed (2006) lo indica al clasificar los cuerpos de agua poco profundos.

CONCLUSIONES

El método de Otsu mejorado y las modificaciones implementadas en esta investigación permiten obtener el valor de umbral óptimo como base para segmentar y clasificar imágenes en modelo a color, mediante el método de clasificación no supervisada.

Bajo el principio de varianza ente clases y dentro de clases, es posible reagrupar y fusionar automáticamente diferentes valores de las agrupaciones obtenidas a partir de la imagen en dominio de color Rojo, Verde, Azul. El resultado del proceso de reagrupación permite al clasificador extender la técnica de umbralización simple a multi–umbralización de imágenes a color.

Las imágenes procesadas en esta investigación permiten identificar hasta nueve clases de cobertura terrestre, con una precisión global del 95% calculada mediante la matriz de error difuso. Además, la metodología evaluada clasifica las imágenes a color con 5% de incertidumbre, con respecto a los cuerpos de agua someros y los pastos.

AGRADECIMIENTOS

Los autores agradecen el apoyo de la Fundación Carolina (España) y la Secretaría de Relaciones Exteriores–(México), por el co–financiamiento de beca para estudios doctorales en la Universidad Complutense de Madrid, España, así como al Colegio de Postgraduados por el apoyo brindado a través del Subprograma de Formación de Profesores Investigadores; además al Instituto de Geografía de la Universidad Autónoma de México por permitir el uso de las fotografías aéreas. Al Dr. Isidro Villegas Romero por permitir utilizar sus resultados del muestreo de campo para la validación del clasificador.

LITERATURA CITADA

Bow, S. T. 2002. Pattern Recognition and Image Preprocessing. 2nd ed. Marcel Dekker. New York, NY, USA. 698 p. [ Links ]

Buxton, B. F., H. Abdallahi, D. Fernandez–Reyes, and W. Jarra. 2007. Development of an extension of the Otsu algorithm for multidimensional image segmentation of thin–film blood slides. In: International Conference on Computing: Theory and Applications (ICCTA'07). Washington, DC, USA. IEEE computer society. pp:552–562. [ Links ]

Chen, D., and D.A. Stow. 2003, Strategies for integrating information from multiple spatial resolutions into land–use/ land–cover classification routines. Photogrammetric Eng. and Remote Sensing 69:1279–1287. [ Links ]

Chen, D., D.A. Stow, and P. Gong, P., 2004, Examining the effect of spatial resolution and texture window size on classification accuracy: an urban environment case. Int. J. Remote Sensing 25:2177–2192. [ Links ]

Chen, Q., J. Luo, and C. Zhou. 2003. A geostatistic based segmentation approach for remotely sensed images. In: 24th Asian Conference on Remote Sensing, Busan, South Korea. pp:3. [ Links ]

Chen, W., and K. Fang. 2008. Multilevel thresholding algorithm based on particle swarm optimization for image segmentation. In: Control Conference, 27th Chinese. Kunming, Yunnan, China, pp:348–351. [ Links ]

Congalton, R. G., and K. Green, 1999. Assessing the Accuracy of Remotely Sensed Data: Principles and Practices. Lewis Publishers, Boca Raton, FL. 160 p. [ Links ]

Congalton, R. G., and K. Green, 2009. Assessing the Accuracy of Remotely Sensed Data: Principles and Practices. 2d ed. CRC/Taylor & Francis, Boca Raton, FL. 178 p. [ Links ]

Chuvieco, E. 2008. Teledetección Ambiental. 3a ed. Ariel. Barcelona, España. 592 p. [ Links ]

Du, Q. 2007. Unsupervised real–time constrained linear discriminant analysis to hyperspectral image classification. Pattern Recognition 40(5):1510–1519. [ Links ]

Du, Y., C. I. Chang, and P.D. Thouin. 2004. Unsupervised approach to color video thresholding. Optical Eng. 43(2):282–289. [ Links ]

Duda,R.O., P.E.Hard, and D.G.Stork. 2001. Pattern Classification. 2nd ed. John Wiley. New York, NY, USA. 654 p. [ Links ]

Liao, P.S., T.S. Chen, and P.C. Chung. 2001. A fast algorithm for multilevel thresholding. J. Comput. Information Sci. Eng. 17:713–727. [ Links ]

Lu, D., and Q. Weng. 2007. A survey of image classification methods and techniques for improving classification performance. Int. J. Remote Sensing 28(5):823–870. [ Links ]

Lunetta, R. S., and J. G. Lyon. 2004. Remote Sensing and GIS Accuracy Assessment. Lewis Publishers, Boca Raton, FL. 292 p. [ Links ]

Otsu, N. 1979. A threshold selection method from gray–level histogram. IEEE Trans. on System Man Cybernetics 9(1):62–66. [ Links ]

Pajares, M, G., y M. de la Cruz. 2001. Visión por Computador, Imágenes Digitales y Aplicaciones. Rama, Madrid, España. 764 p. [ Links ]

Polidório, A M., F. C. Flores, N. N. Imai, A. M. G. Tommaselli, and C. Franco. 2003. Automatic shadow segmentation in aerial color images. Sibgrapi. XVI Brazilian Symposium on Computer Graphics and Image Processing (SIBGRAPI'03). pp: 270. [ Links ]

Rowe, N. C, and L.L. Grewe. 2001. Change detection for linear features in aerial photographs using edge–finding. IEEE Trans. Geosci. Remote Sensing 39:1608–1612. [ Links ]

Saeed, F. 2006. Digital image processing of high resolution aerial photograph of shallow marine sanctuary. Victoria, Australia. Advances in Space Technologies, International Conference. pp:179–184. [ Links ]

Shah, C. A., M. K. Arora, and P. K. Varshney. 2004. Unsupervised classification of hyperspectral data: an ICA mixture model based approach. Int. J. Remote Sensing 25:481–487. [ Links ]

Tseng, M. H., S. J. Chen, G. H. Hwang, and M. Y. Shen. 2008. A genetic algorithm rule–based approach for land–cover classification. J. Photogrammetry and Remote Sensing 63(2):202–212. [ Links ]

Villegas R, I. 2006. Degradación del suelo por impacto del huracán Paulina, en la cuenca del río La Sabana, Guerrero. Tesis doctoral. Colegio de Postgraduados. México. pp:71–96. [ Links ]

Villegas R, I., J. L. Oropeza, M. Martinez, y E. Mejía 2009. Trayectoria y relación lluvia–escurrimiento causados por el huracán Paulina en la cuenca del río La Sabana, Guerrero, México. Agrociencia 43: 345–356. [ Links ]

Zhu, B., M. Ramsey, and H. Chen. 2000. Creating a large–scale content–based airphoto image digital library. IEEE Trans Image Process 9(1):163–167. [ Links ]